What is OpenMemory?

OpenMemory 是一個模組化、自行託管的人工智慧記憶引擎,旨在解決大型語言模型(LLM)語境視窗受限的關鍵問題。它提供持久、結構化且具語義的長期記憶,使人工智慧代理人、助理及企業協作助手能夠安全地跨會話與任務,記住複雜的使用者資料、偏好和過往互動。OpenMemory 專為重視控制權、效能和透明度的開發者及組織而設計,確保您的 AI 應用程式能高效且隱私地保留語境。

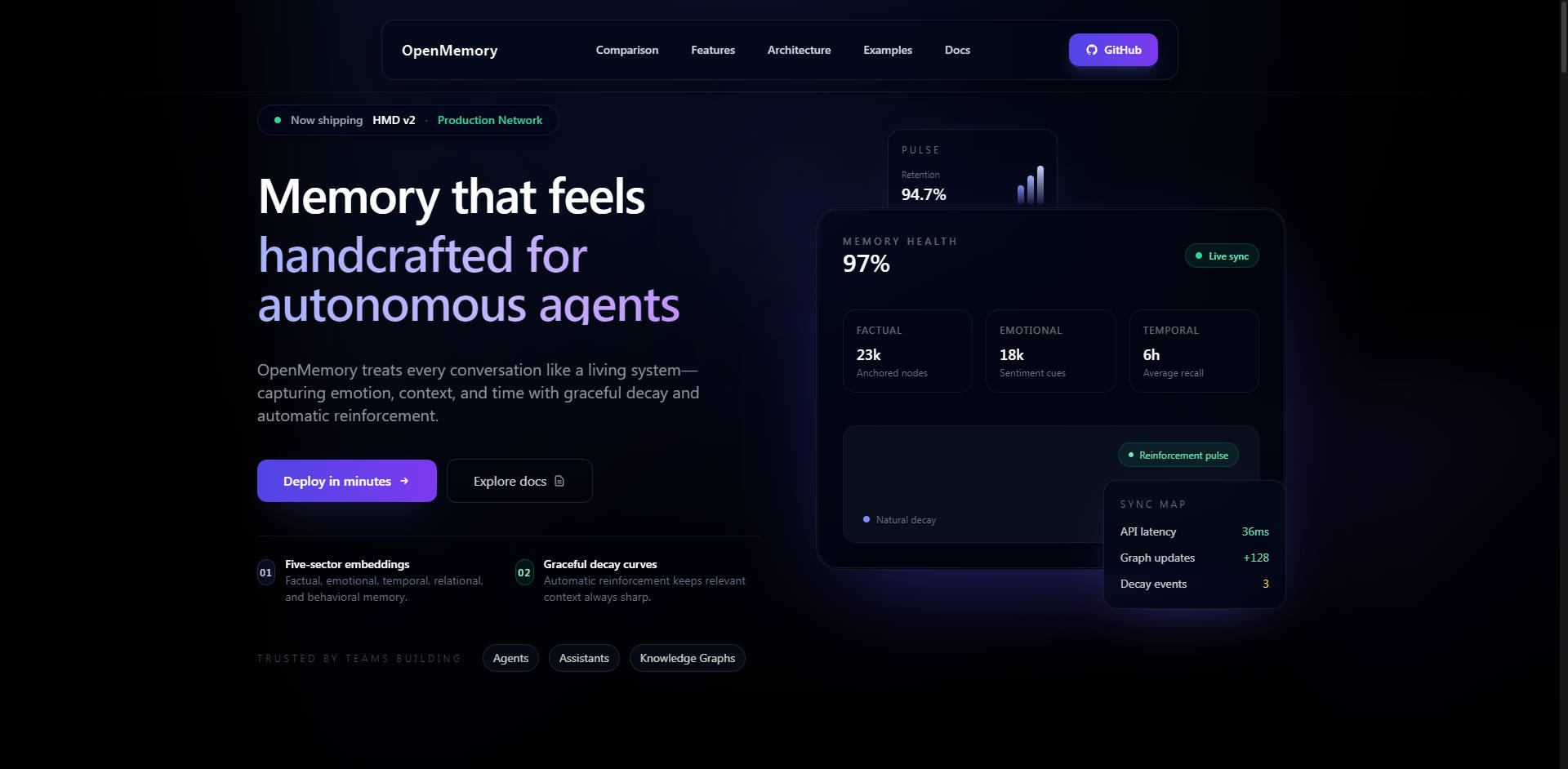

主要特色

OpenMemory 透過專業的認知模型提供真正的長期記憶能力,超越單純的向量儲存,實現細緻且可解釋的語境檢索。

🧠 階層式記憶分解(HMD)架構

HMD 是 OpenMemory 有別於傳統向量資料庫或簡易記憶層的核心創新。HMD 不再統一儲存所有語境,而是將記憶分解為多區塊嵌入(情節記憶、語義記憶、程序記憶、反思記憶、情感記憶)。這種受生物學啟發的架構採用稀疏的單一路徑連結圖,確保每個記憶只有一個規範節點,大幅減少資料重複並提升檢索精確度。此結構是實現更低延遲和可解釋推理路徑的關鍵。

🔒 自行託管安全性與資料主權

OpenMemory 從設計之初就支援自行託管,可部署於本地端、透過 Docker 或您的私有雲環境。此架構保證 100% 資料主權與隱私,消除了託管式記憶 API 固有的供應商資料外洩風險。其安全功能包括寫入 API 的 Bearer 驗證、個人識別資訊(PII)清除與匿名化掛鉤、可選的 AES-GCM 內容加密,以及多使用者部署的強大租戶隔離。

💻 VS Code Extension 實現協作助手記憶持久化

專用的 VS Code Extension 讓 AI 助理能在複雜的編碼會話中維持持久記憶。此擴充功能提供零配置整合,自動追蹤每個檔案的編輯、儲存與開啟。尤其關鍵的是,它採用 Smart Compression 智慧地減少 token 使用量達 30–70%,確保具成本效益的語境傳遞,並透過智慧快取提供 80 毫秒以下的查詢回應。

🔗 與 LangGraph 及 MCP 深度整合

OpenMemory 專為現代人工智慧協同作業而設計。它具備專用的 LangGraph Integration Mode (LGM),提供專用 REST 端點,能自動將節點輸出(例如:observe、plan、reflect)對應至對應的多區塊 HMD 儲存。此外,內建的 Model Context Protocol (MCP) HTTP Server 允許支援 MCP 的代理人(如 Claude Desktop 和自訂 SDK)無需安裝 SDK 即可立即連線,增強框架無關的互通性。

使用情境

OpenMemory 專為需要高語境保真度、安全性及長期保留能力的情境所打造。

1. 企業協作助手開發

在您安全的企業網路內部署 OpenMemory,以驅動企業級協作助手。這確保所有專有資料、操作程序和員工偏好都能被安全且隱私地記住。PII 清除和租戶隔離功能,讓符合規範的多使用者部署成為可能,其中資料完整性和控制權不容妥協。

2. 代理人長期記憶與個人化

建立能隨著時間真正演進與學習的人工智慧代理人。透過運用 HMD 架構,代理人不僅能基於語義相似度,還能根據程序歷史或反思洞察來檢索記憶。這使代理人能夠回憶特定的過往行動、理解複雜的使用者習慣,並在數週或數月內提供高度個人化、語境相關的協助。

3. 強化開發者工作流程的持久性

OpenMemory VS Code Extension 讓使用人工智慧助理(如 GitHub Copilot 或 Cursor)的開發團隊,能在重啟、程式碼分支和長期專案中維持持久記憶。助理不僅能記住目前檔案;它還能記住整個專案歷史的語境、上週的架構決策以及昨天採取的特定偵錯步驟,大幅減少重複語境並提升效率。

為何選擇 OpenMemory?獨特優勢

OpenMemory 在速度、成本和功能透明度等關鍵指標上,旨在超越傳統記憶解決方案。

| 優勢 | 效益 | 效能區別點 |

|---|---|---|

| 卓越效能與成本 | 實現更好的語境準確性和更快的檢索,同時大幅降低營運成本。 | 相較於託管式「記憶 API」,擁有 2–3 倍的語境回憶速度與 6–10 倍的成本效益。(例如:在相同規模下,比 Zep 快 2.5 倍,便宜 10–15 倍)。 |

| 可解釋的回憶 | 精確理解為何檢索某段語境,確保人工智慧推理的透明度和信任。 | 多區塊認知模型實現了基於特定記憶類型(情節、語義等)的可解釋回憶路徑。 |

| 真正的開放性與靈活性 | 針對您的特定使用情境利用最佳嵌入模型,最大限度地減少供應商鎖定。 | 框架無關設計,支援混合嵌入(OpenAI, Gemini)和零成本本地模型(Ollama, E5, BGE)。 |

| 資料掌控 | 對您的資料生命週期、安全性及儲存位置擁有完全的治理權。 | 100% 資料主權,並透過強大的 API 端點提供完全清除功能。 |

結論

OpenMemory 提供下一代智慧、語境感知型大型語言模型應用所需的關鍵基礎設施。透過提供一個自行託管、效能最佳化且架構卓越的記憶引擎,您將獲得建立真正持久且值得信賴的人工智慧體驗所需的控制權、速度與深度。