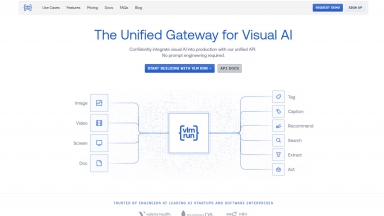

VLM Run

VLM Run

GLM-4.5V

GLM-4.5V

VLM Run

| Launched | 2024-06 |

| Pricing Model | Paid |

| Starting Price | $499 /mo |

| Tech used | Google Analytics,Google Tag Manager,Framer |

| Tag | Data Extraction,Data Integration,Data Visualization |

GLM-4.5V

| Launched | |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Code Generation,Task Automation,Document Automation |

VLM Run Rank/Visit

| Global Rank | 2061692 |

| Country | Bangladesh |

| Month Visit | 7325 |

Top 5 Countries

Traffic Sources

GLM-4.5V Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

Estimated traffic data from Similarweb

What are some alternatives?

DeepSeek-VL2 - DeepSeek-VL2, модель визуального и языкового взаимодействия от DeepSeek-AI, обрабатывает изображения высокого разрешения, обеспечивает быстрые ответы с помощью MLA и показывает превосходные результаты в различных визуальных задачах, таких как VQA и OCR. Идеальна для исследователей, разработчиков и аналитиков бизнес-интеллекта.

Vellum - Vellum упрощает переход от прототипа к производству с помощью функций быстрого экспериментирования, регрессионного тестирования, контроля версий и наблюдения.

Vero - VERO: Корпоративный фреймворк для оценки ИИ в LLM-пайплайнах. Позволяет быстро выявлять и устранять проблемы, сокращая недели контроля качества до считанных минут полной уверенности.

Runware.ai - Создавайте высококачественный медиаконтент через быстрый и доступный API. От молниеносной генерации изображений до продвинутого вывода видео – все это обеспечивается специализированным оборудованием и возобновляемыми источниками энергии. Не требуются ни собственная инфраструктура, ни экспертные знания в области машинного обучения.