vLLora

vLLora

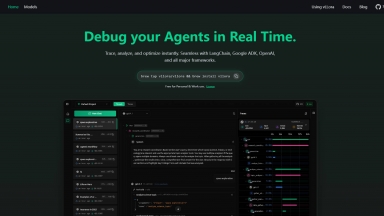

偵錯您的 AI 智能體,全面掌握每一次請求的詳細資訊。

vLLora 與 OpenAI 相容的端點無縫接軌,開箱即用,除了支援超過 300 種模型並讓您能使用自己的專屬金鑰外,它還能捕捉關於延遲、成本和模型輸出的深度追蹤資訊。

LazyLLM

LazyLLM

LazyLLM: 專為多代理式LLM應用程式打造的低程式碼平台。快速建構、疊代並部署複雜的AI解決方案,從原型開發到正式部署一氣呵成。將重心放在演算法的創新,而非繁瑣的工程細節。

vLLora

| Launched | |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Gateway |

LazyLLM

| Launched | |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Low Code,Mlops |

vLLora Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

LazyLLM Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

Estimated traffic data from Similarweb

What are some alternatives?

When comparing vLLora and LazyLLM, you can also consider the following products

Okareo - 使用 Okareo 更快速地偵錯 LLM。找出錯誤、監控效能,並進行微調以達到最佳效果。讓 AI 開發變得更輕鬆。

vLLM - LLM 的高通量及記憶體用量有效推論與服務引擎

Vizra - Bridge AI 與 Laravel 透過 Vizra ADK 串聯。運用熟悉的 Laravel 模式,建構、測試並部署生產級 AI 代理程式。開源專案。

VoltAgent - VoltAgent:用於建構強大、客製化 AI 代理程式的開源 TypeScript 框架。取得控制權與靈活性,整合 LLM、工具與資料。