Baichuan-7B

Baichuan-7B

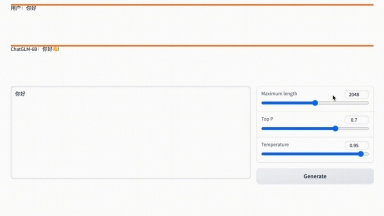

ChatGLM-6B

ChatGLM-6B

Baichuan-7B

| Launched | 2023 |

| Pricing Model | Free |

| Starting Price | |

| Tech used | Amazon AWS CloudFront,cdnjs,Google Fonts,KaTeX,RSS,Stripe |

| Tag | Chatbot Builder,Translator,Text Generators |

ChatGLM-6B

| Launched | 2023 |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Text Generators,Code Generation,Answer Generators |

Baichuan-7B Rank/Visit

| Global Rank | 0 |

| Country | |

| Month Visit | 0 |

Top 5 Countries

Traffic Sources

ChatGLM-6B Rank/Visit

| Global Rank | 0 |

| Country | |

| Month Visit | 0 |

Top 5 Countries

Traffic Sources

Estimated traffic data from Similarweb

What are some alternatives?

Hunyuan-MT-7B - Hunyuan-MT-7B : Traduction automatique par IA open-source. Maîtrise plus de 33 langues avec une précision contextuelle et culturelle inégalée. Lauréat du WMT2025, léger et efficace.

Eagle 7B - Eagle 7B : un modèle surpasse les Transformers avec 1 billion de jetons dans plus de 100 langues (RWKV-v5)

Baichuan-M2 - Baichuan-M2 : Une IA médicale de pointe pour le raisonnement clinique en conditions réelles. Elle éclaire les diagnostics, optimise les résultats pour les patients et se déploie de manière privée sur un seul GPU.

GLM-130B - GLM-130B : un modèle pré-entraîné bilingue ouvert (ICLR 2023)

BERT - TensorFlow code et modèles pré-entraînés pour BERT