Baichuan-7B

Baichuan-7B

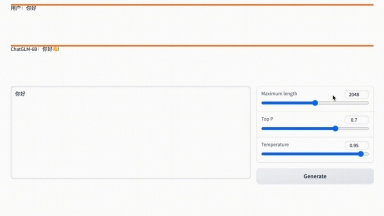

ChatGLM-6B

ChatGLM-6B

Baichuan-7B

| Launched | 2023 |

| Pricing Model | Free |

| Starting Price | |

| Tech used | Amazon AWS CloudFront,cdnjs,Google Fonts,KaTeX,RSS,Stripe |

| Tag | Chatbot Builder,Translator,Text Generators |

ChatGLM-6B

| Launched | 2023 |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Text Generators,Code Generation,Answer Generators |

Baichuan-7B Rank/Visit

| Global Rank | 0 |

| Country | |

| Month Visit | 0 |

Top 5 Countries

Traffic Sources

ChatGLM-6B Rank/Visit

| Global Rank | 0 |

| Country | |

| Month Visit | 0 |

Top 5 Countries

Traffic Sources

Estimated traffic data from Similarweb

What are some alternatives?

Hunyuan-MT-7B - Hunyuan-MT-7B: Машинный перевод на базе ИИ с открытым исходным кодом. Поддерживает более 33 языков, обеспечивая непревзойденную контекстуальную и культурную точность. Победитель WMT2025, легковесный и эффективный.

Eagle 7B - Eagle 7B: Совершая пролет над Transformers с 1 триллионом токенов более чем на 100 языках (RWKV-v5)

Baichuan-M2 - Baichuan-M2: Передовой медицинский ИИ для клинического мышления в реальных условиях. Обосновывает диагнозы, улучшает результаты лечения пациентов и развертывается конфиденциально на одном GPU.

GLM-130B - GLM-130B: открытая предварительно обученная двуязычная модель (ICLR 2023)

BERT - TensorFlow код и предварительно обученные модели для BERT