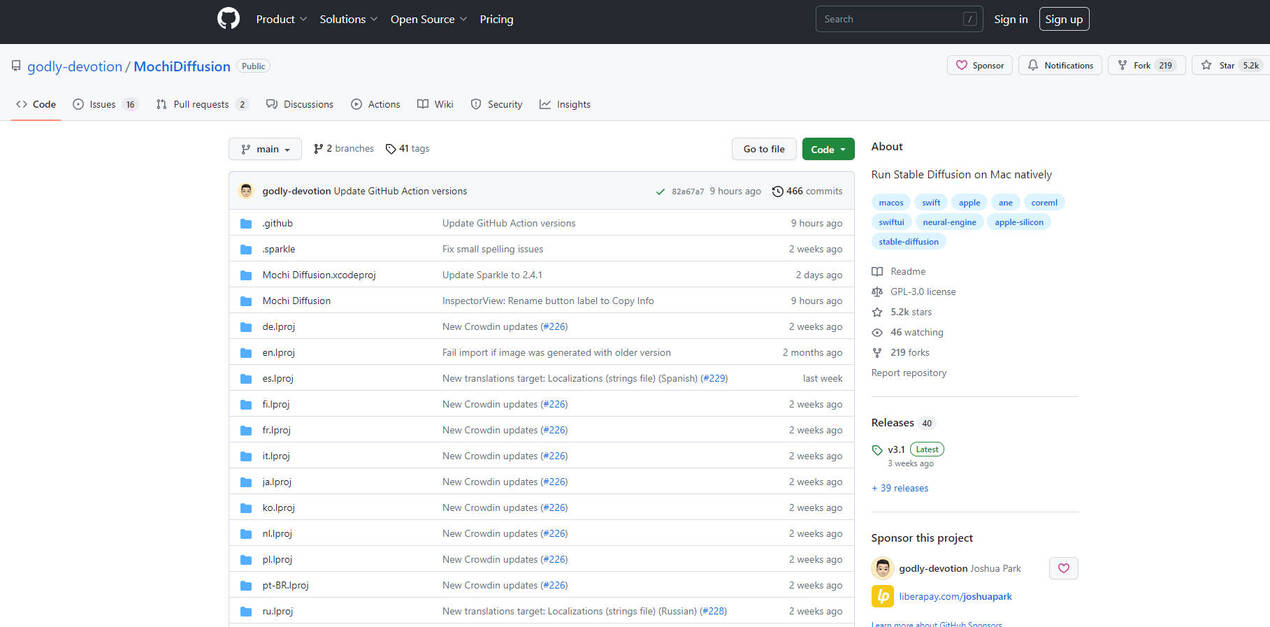

What is Mochi Diffusion?

Mochi Diffusion은 Stable Diffusion의 강력한 성능을 Apple Silicon Mac에서 직접 활용할 수 있도록 해줍니다. 웹 인터페이스나 리소스 소모가 큰 가상 환경에 의존하는 대신, Mochi Diffusion은 Apple의 Core ML 프레임워크를 활용하여 최적화된 성능과 효율성을 제공합니다. 이를 통해 고품질 이미지를 로컬에서, 비공개로, 그리고 훨씬 적은 메모리 소비로 생성할 수 있습니다. macOS에서 빠르고 네이티브하며 오프라인 솔루션을 찾고 있다면 Mochi Diffusion이 정답입니다.

주요 기능:

Core ML을 통한 성능 극대화: Apple Silicon 칩의 Neural Engine을 최대한 활용하는 Apple의 Stable Diffusion Core ML 구현을 사용합니다. 이를 통해 빠른 이미지 생성 속도와 최소한의 메모리 공간(~150MB, Neural Engine 사용 시)을 확보할 수 있습니다.

오프라인 이미지 생성: 완전한 오프라인 상태에서 이미지를 생성하여 데이터의 프라이버시와 보안을 보장합니다. 초기 모델 설정 후에는 인터넷 연결이 필요하지 않습니다.

다양한 생성 기법 지원: 기본적인 텍스트-이미지 변환 외에도 Mochi Diffusion은 다음을 지원합니다.

Image-to-Image (img2img): 기존 이미지를 기반으로 이미지를 생성합니다.

ControlNet: ControlNet 모델을 사용하여 이미지 생성을 정밀하게 제어합니다.

이미지에 메타데이터 포함: 생성된 이미지의 EXIF 메타데이터 내에 프롬프트 정보를 자동으로 저장합니다. macOS Finder의 "정보 가져오기" 창에서 이 데이터를 직접 볼 수 있습니다.

RealESRGAN을 통한 이미지 업스케일링: 통합된 RealESRGAN 업스케일링 기술을 사용하여 생성된 이미지를 더 높은 해상도로 변환합니다.

자동 이미지 관리: 내장된 자동 저장 및 복원 기능을 통해 생성된 이미지 파일을 원활하게 관리할 수 있습니다.

사용자 모델로 맞춤 설정: 자신만의 사용자 지정 Stable Diffusion Core ML 모델을 쉽게 통합할 수 있습니다. Mochi Diffusion은 적절하게 변환된 모델과 원활하게 작동하도록 설계되었으며, pickled 모델의 일반적인 문제점을 피할 수 있습니다.

네이티브 macOS 경험: SwiftUI로 구축된 Mochi Diffusion은 운영 체제의 모양과 느낌에 완벽하게 통합되어 진정한 네이티브 macOS 경험을 제공합니다.

사용 사례:

빠른 프로토타입 제작: 클라우드 서비스에 의존하거나 원격 처리를 기다리지 않고도 이미지 콘셉트를 빠르게 반복할 수 있습니다. 다양한 프롬프트와 설정을 실험하여 창의적인 비전을 실시간으로 구체화할 수 있습니다. 예: UX 디자이너는 스케치(img2img)와 설명적인 프롬프트를 기반으로 UI 요소의 여러 변형을 빠르게 생성할 수 있습니다.

오프라인 이미지 생성: 인터넷 연결이 제한적이거나 없는 환경에서 아트워크 또는 시각적 자산을 생성합니다. 예: 여행 중인 디지털 아티스트가 비행기나 외딴 장소에서 작업을 계속할 수 있습니다.

ControlNet 미세 조정: ControlNet을 사용하여 특정 예술적 또는 기술적 목적을 위해 이미지 생성을 정확하게 안내합니다. 예: 건축가는 자세한 평면도(ControlNet)와 원하는 스타일을 설명하는 텍스트 프롬프트를 기반으로 건물 디자인의 변형을 생성할 수 있습니다.

기술 세부 정보:

컴퓨트 유닛 옵션:

CPU & Neural Engine: 생성 속도와 메모리 사용량 간에 최적의 균형을 제공합니다. 대부분의 사용자에게 권장됩니다.

CPU & GPU: M1 Max, Ultra 및 이후 칩에서 잠재적으로 더 빠르지만 더 많은 메모리를 소비합니다.

모델 호환성:

split_einsum버전: Neural Engine을 포함한 모든 컴퓨트 유닛 옵션과 호환됩니다.original버전: "CPU & GPU" 컴퓨트 유닛 옵션하고만 호환됩니다.모델 관리:

기본 모델 폴더:

~/MochiDiffusion/models/(설정에서 사용자 정의 가능).각 모델에 대해

models디렉터리 내에 하위 폴더를 만들고 변환된 Core ML 모델 파일을 해당 하위 폴더 안에 넣습니다. (제공된 정보에서 예제 디렉터리 구조를 참조하십시오).처음 모델 사용 시: 모델을 처음 사용하는 경우 Neural Engine은 캐시된 버전을 컴파일하는 데 최대 2분이 걸릴 수 있습니다. 해당 모델을 사용한 후속 생성은 훨씬 빨라집니다.

결론:

Mochi Diffusion을 통해 Apple Silicon Mac에서 Stable Diffusion의 잠재력을 최대한 활용할 수 있습니다. 뛰어난 성능, 오프라인 기능 및 네이티브 macOS 경험을 제공하여 개발자, 아티스트 및 강력하고 효율적인 이미지 생성 도구를 찾는 모든 사람에게 이상적인 솔루션입니다.

More information on Mochi Diffusion

Mochi Diffusion 대안

Mochi Diffusion 대안-

Stable Diffusion 3.5는 최첨단 AI 이미지 생성 플랫폼입니다. 더욱 빠른 속도, 초고해상도, 직관적인 프롬프트 해석을 제공합니다. 창의력을 발휘하세요.

-

NMKD Stable Diffusion GUI를 사용하여 Windows GPU에서 무료로 AI 이미지를 생성하세요. 텍스트-이미지, 이미지-이미지 등을 지원합니다. 복잡한 설치가 필요하지 않습니다.

-

HappyDiffusion 은 스 테이블 디퓨 전 Automatic webUI 에 모 바 일 과 PC 에서 가장 간 단 하 고 손쉽 게 접 근 할 수 있 는 방 법 입니다

-

Diffus: 전문가용 AI 이미지 생성. 7만 개 이상의 모델과 고급 툴을 통해 브라우저에서 하드웨어 비용 없이도 타의 추종을 불허하는 정밀한 제어를 경험하세요.

-

Stable Diffusion 3 Medium은 이미지 품질, 타이포그래피, 복잡한 프롬프트 이해 및 리소스 효율성이 크게 향상된 다중 모드 확산 변환기(MMDiT) 텍스트-이미지 모델입니다.