LazyLLM

LazyLLM

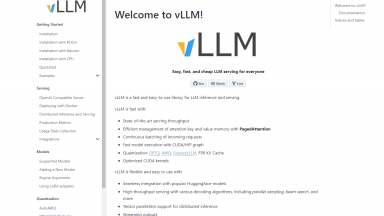

VLLM

VLLM

LazyLLM

| Launched | |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Low Code,Mlops |

VLLM

| Launched | |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Software Development,Data Science |

LazyLLM Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

VLLM Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

Estimated traffic data from Similarweb

What are some alternatives?

TaskingAI - TaskingAI привносит простоту Firebase в разработку AI-нативных приложений. Начните свой проект, выбрав модель LLM, создайте отзывчивого ассистента, поддерживаемого API с сохранением состояния, и расширяйте его возможности с помощью управляемой памяти, интеграций инструментов и системы дополненной генерации.

liteLLM - Используйте OpenAI для вызова всех API LLM. Используйте Bedrock, Azure, OpenAI, Cohere, Anthropic, Ollama, Sagemaker, HuggingFace, Replicate (свыше 100 LLM)

LM Studio - LM Studio — это удобное настольное приложение для экспериментов с локальными и открытыми большими языковыми моделями (LLM). Кроссплатформенное настольное приложение LM Studio позволяет скачивать и запускать любую ggml-совместимую модель с Hugging Face, а также предоставляет простой, но мощный пользовательский интерфейс для настройки моделей и выполнения инференса. Приложение задействует ваш GPU по возможности.

Laminar AI - Laminar - это платформа для разработчиков, которая объединяет оркестровку, оценку, данные и наблюдаемость, чтобы дать разработчикам ИИ возможность создавать надежные приложения LLM в 10 раз быстрее.

Literal AI - Literal AI: Наблюдаемость и оценка для RAG и LLM. Отладка, мониторинг, оптимизация производительности и обеспечение готовности к эксплуатации приложений AI.