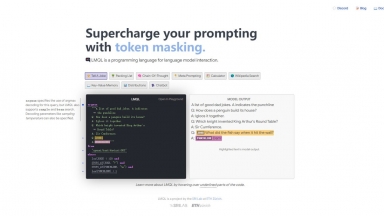

LMQL

LMQL

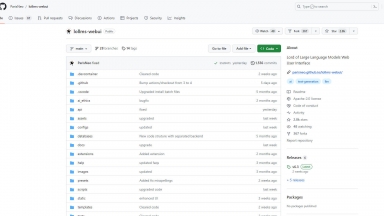

LoLLMS Web UI

LoLLMS Web UI

LMQL

| Launched | 2022-11 |

| Pricing Model | Free |

| Starting Price | |

| Tech used | Cloudflare Analytics,Fastly,Google Fonts,GitHub Pages,Highlight.js,jQuery,Varnish |

| Tag | Text Analysis |

LoLLMS Web UI

| Launched | 2023 |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Music Generators |

LMQL Rank/Visit

| Global Rank | 2509184 |

| Country | United States |

| Month Visit | 8348 |

Top 5 Countries

Traffic Sources

LoLLMS Web UI Rank/Visit

| Global Rank | 0 |

| Country | |

| Month Visit | 0 |

Top 5 Countries

Traffic Sources

Estimated traffic data from Similarweb

What are some alternatives?

LM Studio - LM Studio — это удобное настольное приложение для экспериментов с локальными и открытыми большими языковыми моделями (LLM). Кроссплатформенное настольное приложение LM Studio позволяет скачивать и запускать любую ggml-совместимую модель с Hugging Face, а также предоставляет простой, но мощный пользовательский интерфейс для настройки моделей и выполнения инференса. Приложение задействует ваш GPU по возможности.

LLMLingua - Для ускорения вывода LLMs и улучшения восприятия LLMs ключевой информации сжимаем подсказку и KV-кэш, что дает сжатие до 20x при минимальной потере производительности.

LazyLLM - LazyLLM: Low-code для мультиагентных LLM-приложений. Создавайте, итерируйте и развертывайте сложные ИИ-решения быстро — от прототипа до продакшена. Сосредоточьтесь на алгоритмах, а не на инжиниринге.

vLLM - Высокопроизводительный и экономичный по памяти механизм вывода и обслуживания для LLMs

LLM-X - Революционизируйте разработку LLM с помощью LLM-X! Интегрируйте большие языковые модели в ваш рабочий процесс с помощью безопасного API. Повысьте продуктивность и раскройте возможности языковых моделей для ваших проектов.