Megatron-LM

Megatron-LM

Megatron-LM

| Launched | |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Developer Tools,Software Development,Data Science |

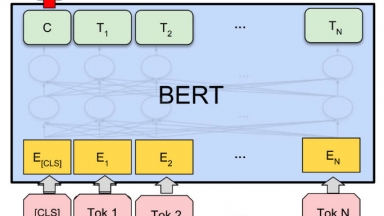

BERT

| Launched | |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Text Analysis |

Megatron-LM Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

BERT Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

Estimated traffic data from Similarweb

What are some alternatives?

ktransformers - KTransformers, un proyecto de código abierto del equipo KVCache.AI de Tsinghua y QuJing Tech, optimiza la inferencia de modelos de lenguaje grandes. Reduce los umbrales de hardware, ejecuta modelos de 671B parámetros en GPUs individuales de 24GB de VRAM, aumenta la velocidad de inferencia (hasta 286 tokens/s en pre-procesamiento, 14 tokens/s en generación) y es adecuado para uso personal, empresarial y académico.

Transformer Lab - Transformer Lab: Una plataforma de código abierto para construir, ajustar y ejecutar LLMs localmente sin necesidad de programar. Descarga cientos de modelos, ajusta finamente en diferentes hardwares, chatea, evalúa y mucho más.

Monster API - MonsterGPT: Afina y despliega modelos de IA personalizados a través de chat. Simplifica tareas complejas de LLM e IA. Accede fácilmente a más de 60 modelos de código abierto.

Nemotron-4 340B - Nemotron-4 340B, una familia de modelos optimizados para NVIDIA NeMo y NVIDIA TensorRT-LLM, incluye modelos de instrucción y recompensa de vanguardia, y un conjunto de datos para entrenamiento de IA generativa.

BERT

BERT