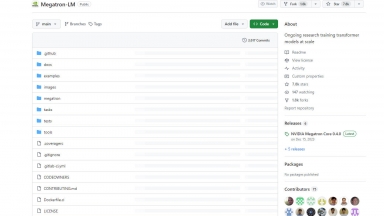

Megatron-LM

| Launched | |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Developer Tools,Software Development,Data Science |

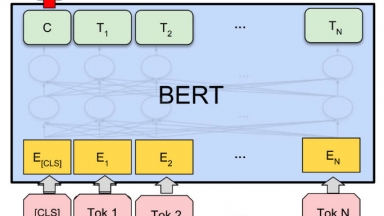

BERT

| Launched | |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Text Analysis |

Megatron-LM Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

BERT Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

Estimated traffic data from Similarweb

What are some alternatives?

When comparing Megatron-LM and BERT, you can also consider the following products

ktransformers - KTransformers 是由清華大學 KVCache.AI 團隊與 QuJing Tech 共同開發的開源專案,旨在優化大型語言模型的推論過程。它能降低硬體門檻,讓使用者僅需配備 24GB 顯示記憶體的單張 GPU,即可運行 6710 億參數的模型。此外,它還能大幅提升推論速度(預處理階段最高可達每秒 286 個 tokens,生成階段最高可達每秒 14 個 tokens),非常適合個人、企業以及學術機構使用。

Transformer Lab - Transformer Lab:一個開源平台,讓您可在本地端建構、微調和執行大型語言模型 (LLM),無需編碼。下載數百個模型,跨硬體微調,聊天、評估等等。

Monster API - MonsterGPT:透過對話輕鬆微調並部署專屬AI模型。讓複雜的大型語言模型(LLM)與人工智慧(AI)任務變得更簡單。輕鬆存取超過 60 個開源模型。

Nemotron-4 340B - Nemotron-4 340B,是一系列針對 NVIDIA NeMo 和 NVIDIA TensorRT-LLM 優化的模型,包含最先進的指令和獎勵模型,以及用於生成式 AI 訓練的數據集。

Megatron-LM

Megatron-LM

BERT

BERT