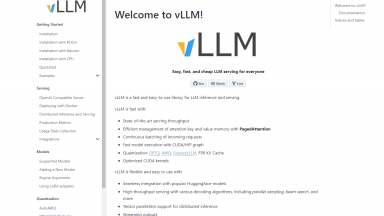

VLLM

VLLM

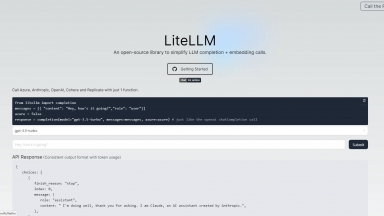

LiteLLM

LiteLLM

VLLM

| Launched | |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Software Development,Data Science |

LiteLLM

| Launched | 2023-08 |

| Pricing Model | Free |

| Starting Price | |

| Tech used | Next.js,Vercel,Webpack,HSTS |

| Tag | Gateway |

VLLM Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

LiteLLM Rank/Visit

| Global Rank | 102564 |

| Country | United States |

| Month Visit | 482337 |

Top 5 Countries

Traffic Sources

Estimated traffic data from Similarweb

What are some alternatives?

EasyLLM - EasyLLM es un proyecto de código abierto que ofrece herramientas y métodos útiles para trabajar con modelos de lenguaje grande (LLM), tanto de código abierto como de código cerrado. Ponte en marcha de inmediato o echa un vistazo a la documentación.

LLMLingua - Para acelerar la inferencia de los LLM y mejorar la percepción de los LLM de información clave, comprime el indicador y KV-Cache, que logra una compresión de hasta 20 veces con una pérdida de rendimiento mínima.

MegaLLM - Ship AI features faster with MegaLLM's unified gateway. Access Claude, GPT-5, Gemini, Llama, and 70+ models through a single API. Built-in analytics, smart fallbacks, and usage tracking included.

StreamingLLM - Presentamos StreamingLLM: Un marco eficiente para implementar LLM en aplicaciones en tiempo real. Controla secuencias de longitud infinita sin sacrificar el rendimiento y disfruta de optimizaciones de velocidad de hasta 22,2x. Ideal para diálogos multironda y asistentes diarios.

LazyLLM - LazyLLM: Bajo código para aplicaciones LLM multiagente. Desarrolle, itere y despliegue soluciones de IA complejas con rapidez, desde el prototipo hasta la producción. Céntrese en los algoritmos, no en la ingeniería.