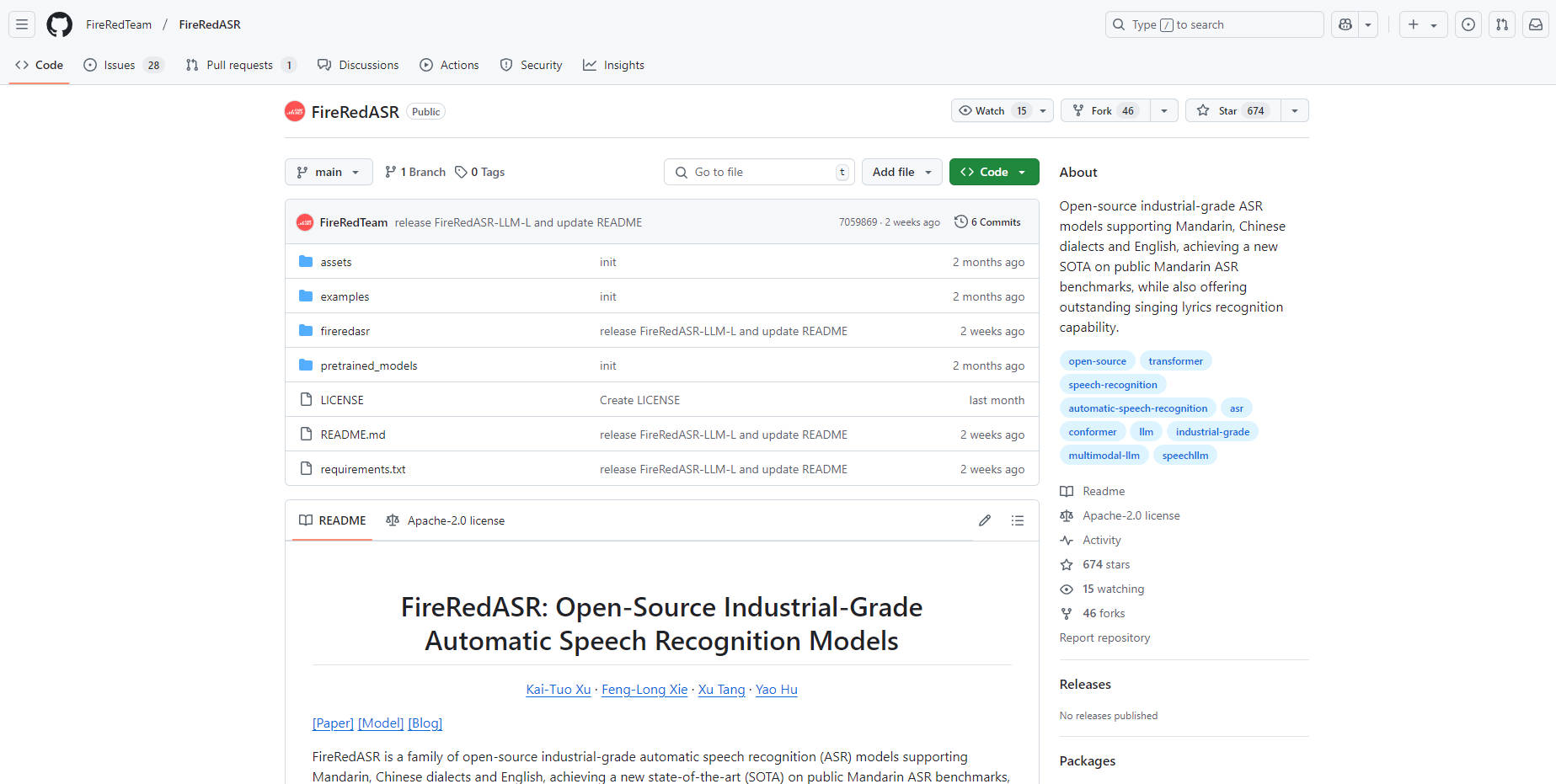

What is FireRedASR?

FireRedASR es una familia de modelos de reconocimiento automático del habla (ASR, por sus siglas en inglés) de código abierto diseñados para aplicaciones del mundo real. Si necesita capacidades de conversión de voz a texto precisas y eficientes en mandarín, dialectos chinos o inglés, FireRedASR ofrece una solución potente. Aborda la necesidad crítica de un ASR robusto que funcione excepcionalmente bien en diversas condiciones acústicas, incluso extendiéndose a tareas especializadas como el reconocimiento de letras de canciones.

Características principales:

🗣️ Obtenga una precisión de última generación: FireRedASR ofrece un rendimiento de primer nivel, alcanzando un nuevo estado del arte (SOTA) en los puntos de referencia públicos de ASR en mandarín. Esto se traduce en menos errores y transcripciones más fiables para sus aplicaciones.

⚙️ Elija su arquitectura: Seleccione entre dos variantes de modelo para adaptarlas a sus necesidades específicas:

FireRedASR-LLM: Emplea un marco Encoder-Adapter-LLM, aprovechando la potencia de los grandes modelos lingüísticos (LLM) para un rendimiento superior y una interacción de voz integral y fluida.

FireRedASR-AED: Utiliza una arquitectura Encoder-Decoder basada en la atención (AED), que equilibra el alto rendimiento con la eficiencia computacional. Ideal como módulo de representación de voz en modelos de voz basados en LLM.

🌐 Compatibilidad con múltiples idiomas y dialectos: Transcriba audio en mandarín, varios dialectos chinos e inglés con gran precisión. Esta amplia cobertura lingüística abre un abanico más amplio de posibilidades de aplicación.

🎤 Reconozca las letras de las canciones: FireRedASR destaca en el difícil campo del reconocimiento de letras de canciones, ofreciendo capacidades únicas para aplicaciones relacionadas con la música.

💻 Fácil de usar: Cree un entorno Python, descargue y coloque los archivos del modelo e instale las dependencias mediante comandos sencillos.

Detalles técnicos:

Variantes del modelo: FireRedASR-LLM (8,3B parámetros) y FireRedASR-AED (1,1B parámetros).

Métricas de evaluación: Tasa de error de caracteres (CER%) para chino y tasa de error de palabras (WER%) para inglés.

Puntos de referencia: Probado rigurosamente en aishell1, aishell2, WenetSpeech (ws_net, ws_meeting), KeSpeech y LibriSpeech (test-clean, test-other).

Arquitectura:

FireRedASR-LLM: Marco Encoder-Adapter-LLM.

FireRedASR-AED: Arquitectura Encoder-Decoder (AED) basada en la atención.

Dependencias: Python 3.10, requirements.txt.

Casos de uso:

Integración del asistente de voz: Integre FireRedASR en asistentes de voz para permitir el reconocimiento preciso de comandos y la comprensión del lenguaje natural, incluso en entornos ruidosos o con diversos acentos. Las bajas tasas de error garantizan una interacción fiable con el usuario.

Servicio de transcripción en tiempo real: Desarrolle un servicio de transcripción en tiempo real para reuniones, conferencias o entrevistas. La eficiencia del modelo AED permite un procesamiento de baja latencia, mientras que el modelo LLM proporciona la máxima precisión para aplicaciones críticas.

Análisis de contenido multimedia: Utilice FireRedASR para generar automáticamente subtítulos para vídeos, indexar archivos de audio o analizar el contenido de podcasts. La capacidad de reconocimiento de letras de canciones permite crear funciones únicas para las plataformas de música.

Conclusión:

FireRedASR proporciona una solución potente y versátil para desarrolladores e investigadores que buscan reconocimiento de voz de calidad industrial. Su precisión de última generación, sus flexibles opciones de arquitectura y su compatibilidad con varios idiomas lo convierten en una opción atractiva para una amplia gama de aplicaciones. La naturaleza de código abierto del proyecto fomenta las contribuciones de la comunidad y el avance del campo.

Preguntas frecuentes:

P: ¿Cuáles son las limitaciones de longitud de entrada para cada modelo?

R: FireRedASR-AED admite entradas de audio de hasta 60 segundos. Una entrada superior a 60 segundos puede causar problemas de alucinación. Las entradas que superen los 200 segundos provocarán errores de codificación posicional. FireRedASR-LLM admite entradas de audio de hasta 30 segundos.

P: ¿Cómo puedo solucionar los posibles problemas de repetición con FireRedASR-LLM durante la búsqueda de haces por lotes?

R: Cuando utilice la búsqueda de haces por lotes con FireRedASR-LLM, asegúrese de que las expresiones de entrada tengan longitudes similares. Las diferencias significativas de longitud pueden provocar repeticiones en las expresiones más cortas. Puede ordenar su conjunto de datos por longitud o establecer el tamaño del lote en 1 para mitigar este problema.

P: ¿Cuáles son las principales diferencias entre los modelos FireRedASR-LLM y FireRedASR-AED?

R: FireRedASR-LLM está diseñado para obtener la máxima precisión y una interacción de voz integral, aprovechando un LLM. FireRedASR-AED prioriza la eficiencia computacional manteniendo un alto rendimiento, lo que lo hace adecuado como módulo de representación de voz.

P: ¿Cómo puedo convertir mi audio al formato requerido?

R: Utilice el comando FFmpeg proporcionado:

ffmpeg -i input_audio -ar 16000 -ac 1 -acodec pcm_s16le -f wav output.wav. Esto convierte el audio al formato PCM de 16 kHz y 16 bits.P: ¿Dónde puedo descargar los archivos del modelo?

R: Los archivos del modelo se pueden descargar de Hugging Face. Los enlaces están disponibles en la documentación proporcionada [Modelo]. También necesita descargar Qwen2-7B-Instruct para FireRedASR-LLM-L.

P: ¿Qué versión de Python se requiere? R: Python 3.10.

More information on FireRedASR

FireRedASR Alternativas

FireRedASR Alternativas-

Omnilingual ASR es un sistema de reconocimiento de voz de código abierto con soporte para más de 1,600 idiomas — entre ellos, cientos que ninguna tecnología ASR había cubierto con anterioridad.

-

Aero-1-Audio: Modelo eficiente de 1.500 millones de parámetros para el procesamiento continuo de audio de hasta 15 minutos. Reconocimiento automático del habla (ASR) y comprensión precisos sin necesidad de segmentación. ¡De código abierto!

-

Transforma tus podcasts y chatbots con FireRedTTS-2: discurso natural, multilocutor y de larga duración. Disfruta de latencia ultrabaja y clonación de voz multilingüe.

-

Descubre Step - Audio, el primer framework de código abierto listo para producción para la interacción inteligente del habla. Armoniza la comprensión y la generación, es compatible con conversaciones multilingües, emocionales y ricas en dialectos.

-

Reverb ofrece modelos de reconocimiento de voz y diarización de código abierto. ASR de alta precisión, diarización de hablantes, control de verbosidad. Ideal para la transcripción de podcasts, actas de reuniones y subtítulos de videos. Redefine el punto de referencia de la tecnología del habla.