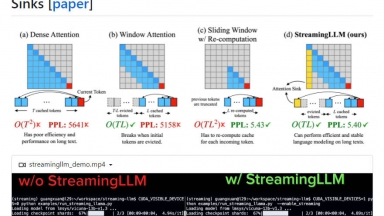

StreamingLLM

StreamingLLM

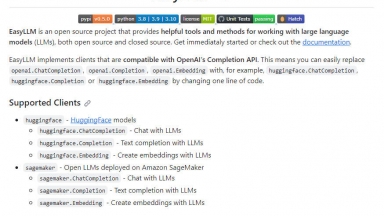

EasyLLM

EasyLLM

StreamingLLM

| Launched | 2024 |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Workflow Automation,Developer Tools,Communication |

EasyLLM

| Launched | 2024 |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Developer Tools,Chatbot Builder,Coding Assistants |

StreamingLLM Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

EasyLLM Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

Estimated traffic data from Similarweb

What are some alternatives?

vLLM - Un moteur d'inférence et de service à haut débit et économe en mémoire pour les LLM

LLMLingua - Pour accélérer l'inférence LLM et améliorer la perception des informations clés de LLM, compressez l'invite et KV-Cache, ce qui permet d'obtenir une compression jusqu'à 20x avec une perte de performance minimale.

LazyLLM - LazyLLM : Le low-code pour les applications LLM multi-agents. Créez, itérez et déployez rapidement des solutions d'IA complexes, du prototype à la production. Concentrez-vous sur les algorithmes, et non sur l'ingénierie.

LMCache - LMCache est un réseau de diffusion de connaissances (KDN) open source qui accélère les applications LLM en optimisant le stockage et la récupération des données.