StreamingLLM

StreamingLLM

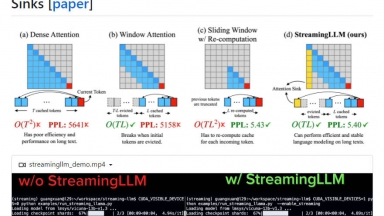

介紹 StreamingLLM:一個用於在串流應用程式中部署 LLM 的高效框架。無需犧牲效能就能處理無限序列長度,並可享受高達 22.2 倍的速度優化。非常適合多輪對話和日常助理。

StreamingLLM

| Launched | 2024 |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Workflow Automation,Developer Tools,Communication |

EasyLLM

| Launched | 2024 |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Developer Tools,Chatbot Builder,Coding Assistants |

StreamingLLM Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

EasyLLM Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

Estimated traffic data from Similarweb

What are some alternatives?

When comparing StreamingLLM and EasyLLM, you can also consider the following products

vLLM - LLM 的高通量及記憶體用量有效推論與服務引擎

LLMLingua - 為了加速 LLM 的推論並增強 LLM 對關鍵資訊的感知,壓縮提示和 KV 快取,在效能損失極小的情況下達到高達 20 倍的壓縮率。

LazyLLM - LazyLLM: 專為多代理式LLM應用程式打造的低程式碼平台。快速建構、疊代並部署複雜的AI解決方案,從原型開發到正式部署一氣呵成。將重心放在演算法的創新,而非繁瑣的工程細節。

LMCache - LMCache 是一個開源的知識傳遞網路 (KDN),透過最佳化資料儲存和擷取來加速 LLM 應用程式。

EasyLLM

EasyLLM