StreamingLLM

StreamingLLM

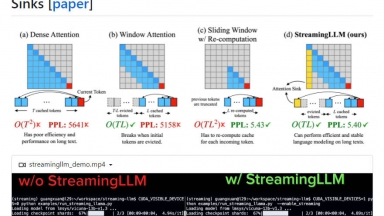

StreamingLLM 소개: 스트리밍 앱에 LLM을 배포하기 위한 효율적인 프레임워크. 성능을 저하시키지 않고 무한한 시퀀스 길이를 처리하고 최대 22.2배의 속도 최적화를 누리세요. 다중 라운드 대화와 일상적 비서에게 이상적입니다.

LazyLLM

LazyLLM

LazyLLM: 다중 에이전트 LLM 앱을 위한 로우코드.

프로토타입부터 실제 서비스(프로덕션)까지 복잡한 AI 솔루션을 빠르게 구축하고, 반복하며, 배포하세요.

엔지니어링에 얽매이지 않고 알고리즘에만 집중하십시오.

StreamingLLM

| Launched | 2024 |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Workflow Automation,Developer Tools,Communication |

LazyLLM

| Launched | |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Low Code,Mlops |

StreamingLLM Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

LazyLLM Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

Estimated traffic data from Similarweb

What are some alternatives?

When comparing StreamingLLM and LazyLLM, you can also consider the following products

vLLM - 대규모 언어 모델에 대한 처리량이 높고 메모리 효율적인 추론 및 서비스 엔진

EasyLLM - EasyLLM은 오픈소스와 클로즈소스를 포함한 대규모 언어 모델(LLM)을 사용하는 데에 유용한 도구와 방법을 제공하는 오픈소스 프로젝트입니다. 즉시 시작하거나 설명서를 확인하세요.

LLMLingua - LLM의 추론 속도를 높이고 LLM이 주요 정보를 인식하도록 하기 위해, 최대 20배 압축률과 최소한의 성능 저하로 압축된 프롬프트 및 KV-캐시

LMCache - LMCache는 데이터 저장 및 검색을 최적화하여 LLM 애플리케이션의 속도를 높이는 오픈소스 지식 전달 네트워크(KDN)입니다.