What is DeepSeek-R1?

DeepSeek-R1 시리즈는 AI 연구 개발을 발전시키도록 설계된 강력한 추론 모델 세트를 제공합니다. DeepSeek-R1-Zero 및 DeepSeek-R1을 포함한 이러한 모델은 수학, 코드 및 추론 작업에서 뛰어난 성능을 발휘하며, OpenAI-o1과 같은 선도적인 모델과 비교할 만하고 경우에 따라서는 능가하는 수준의 성과를 달성합니다.

주요 기능:

DeepSeek-R1-Zero와 DeepSeek-R1은 서로 다른 방식으로 훈련되어 AI 추론 분야에서 상당한 발전을 이끌었습니다.

강화 학습(RL) 활용: DeepSeek-R1-Zero는 기존의 지도 학습 미세 조정(SFT) 단계를 거치지 않고 RL만으로 훈련되었습니다. RL만으로도 모델에서 정교한 추론 행동이 어떻게 촉진되는지, 자체 검증, 반성 및 장황한 사고 과정(CoT) 생성과 같은 부상 능력으로 이어지는지 확인할 수 있습니다.

콜드 스타트 데이터 통합: DeepSeek-R1-Zero와 달리 DeepSeek-R1은 RL 훈련 전 데이터를 포함합니다. 이를 통해 DeepSeek-R1-Zero에서 볼 수 있는 끝없는 반복과 가독성 저하와 같은 문제를 피할 수 있으며, 전반적인 추론 성능도 향상됩니다.

소형 효율적인 모델을 위한 증류 활용: DeepSeek-R1의 추론 기능은 더 작고 접근성이 뛰어난 모델로 증류됩니다. 더 작은 규모에서 RL로 직접 훈련된 모델보다 성능이 뛰어난 이 증류된 모델을 다양한 애플리케이션에 활용하여 성능 저하 없이 활용할 수 있습니다.

오픈소스 모델 활용: 이번 출시에는 DeepSeek-R1-Zero, DeepSeek-R1 및 Llama와 Qwen을 기반으로 한 6개의 증류된 모델의 오픈소스 버전이 포함되어 있습니다. 이러한 모델에 접근하여 고급 추론 기능을 프로젝트에 통합하고 연구 커뮤니티에 기여할 수 있습니다. 특히 DeepSeek-R1-Distill-Qwen-32B는 여러 벤치마크에서 OpenAI-o1-mini를 능가하여 고밀도 모델의 새로운 기준을 제시합니다.

활용 사례:

연구원과 개발자는 DeepSeek-R1 모델을 여러 가지 방법으로 사용할 수 있습니다.

학술 연구: 연구원이라면 DeepSeek-R1-Zero는 순수 RL이 모델 훈련에 미치는 영향을 연구할 수 있는 독특한 기회를 제공합니다. SFT 없이 복잡한 추론 동작이 어떻게 나타나는지 탐구하여 새로운 훈련 방법론을 발견할 수 있습니다. DeepSeek-R1은 또한 콜드 스타트 데이터가 모델 훈련에 미치는 영향을 연구할 수 있는 독특한 기회를 제공합니다.

모델 개발: 개발자는 DeepSeek-R1 또는 증류된 버전을 애플리케이션에 통합할 수 있습니다. 예를 들어 DeepSeek-R1-Distill-Qwen-32B를 사용하여 기존 솔루션보다 우수한 성능을 제공하는 고급 코드 생성 도구를 구축할 수 있습니다. DeepSeek-R1은

model='deepseek-reasoner를 설정하여 호출할 수 있는 사고 과정을 출력하는 API 서비스를 제공합니다.벤치마킹 및 평가: 제공된 종합적인 평가 결과를 사용하여 모델을 DeepSeek-R1과 비교 벤치마킹할 수 있습니다. 예를 들어 수학적 추론 개선 작업을 하고 있다면 DeepSeek-R1이 79.8%의 통과율을 달성한 AIME 2024 벤치마크에서 모델의 성능을 비교할 수 있습니다.

결론:

DeepSeek-R1 시리즈 모델은 AI 추론 분야에서 상당한 진전을 나타냅니다. 고급 훈련 기술을 활용하고 모델을 오픈소스로 공개함으로써 DeepSeek는 연구원과 개발자가 AI의 새로운 영역을 탐구할 수 있도록 지원합니다. 학술 연구를 수행하든, AI 기반 애플리케이션을 개발하든, 또는 모델을 벤치마킹하려고 하든 DeepSeek-R1은 성공하는 데 필요한 도구와 성능을 제공합니다.

FAQ:

1. DeepSeek-R1 모델을 독창적으로 만드는 요소는 무엇입니까?

DeepSeek-R1 모델은 훈련 방법론으로 인해 독창적입니다. DeepSeek-R1-Zero는 강화 학습을 통해서만 훈련되어 지도 학습 미세 조정 없이도 복잡한 추론이 나타날 수 있음을 보여줍니다. DeepSeek-R1은 콜드 스타트 데이터를 활용하여 성능을 향상시키고 가독성 저하와 같은 문제를 해결합니다. 또한 이러한 고급 추론 기능을 소형 모델로 증류할 수 있는 기능은 다양한 애플리케이션에서 더욱 접근성을 높입니다.

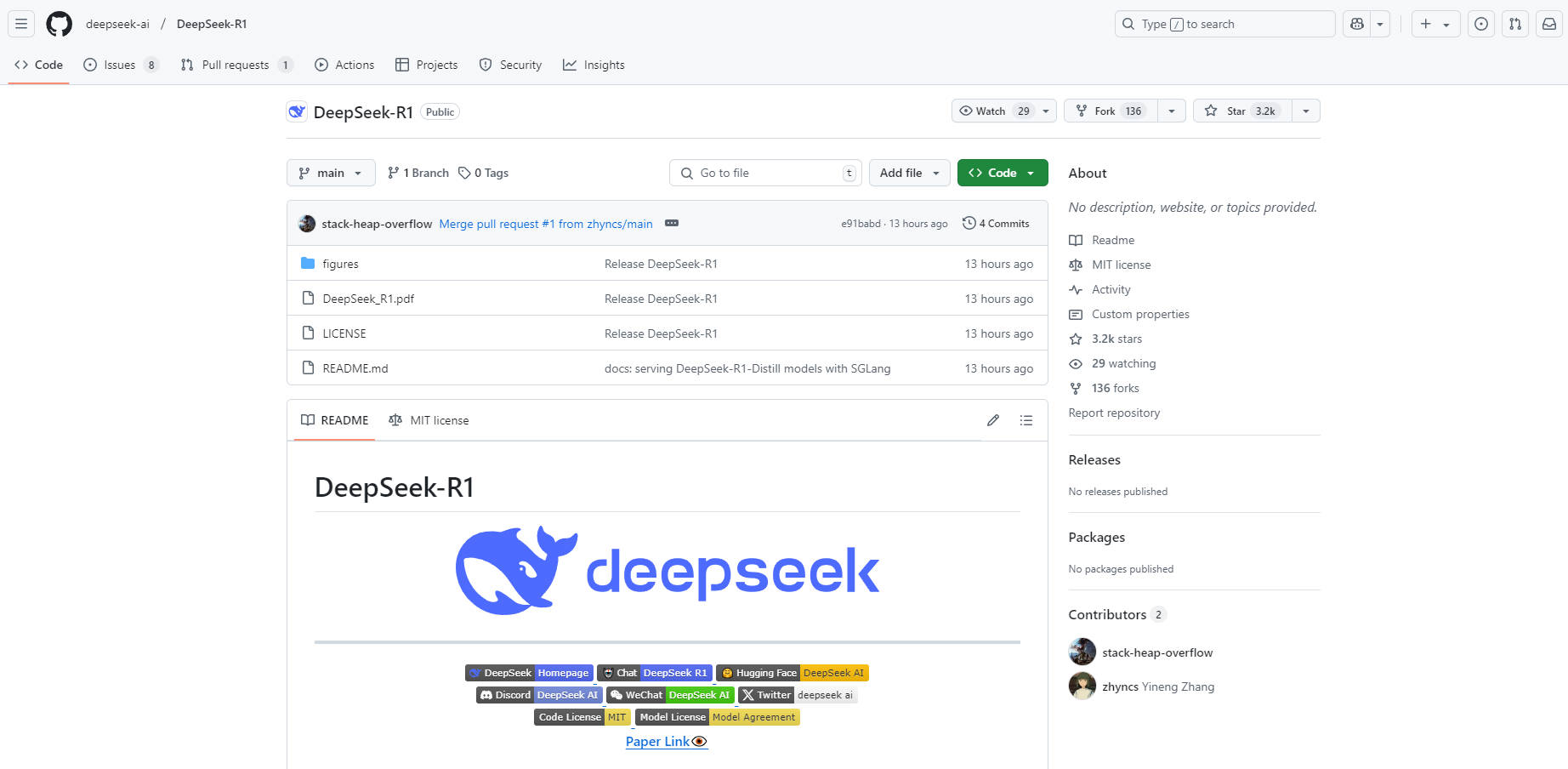

2. DeepSeek-R1 모델에 어떻게 접근하고 사용할 수 있습니까?

공식 DeepSeek 웹사이트와 API 플랫폼을 통해 DeepSeek-R1 모델에 접근할 수 있습니다. DeepSeek-R1-Zero, DeepSeek-R1 및 증류된 버전을 포함한 모델은 Hugging Face에서도 사용할 수 있습니다. Qwen 또는 Llama 모델에 대한 표준 절차를 사용하여 다운로드하고 프로젝트에 통합할 수 있습니다.

3. 증류된 모델을 사용하는 이점은 무엇입니까?

DeepSeek-R1-Distill-Qwen-32B와 같은 증류된 모델은 여러 가지 이점을 제공합니다. 더 큰 DeepSeek-R1 모델의 고급 추론 기능을 유지하지만 더 작고 효율적입니다. 즉, 리소스가 제한된 환경에서도 성능 저하 없이 배포할 수 있습니다. 또한 강화 학습으로 직접 훈련된 동일한 크기의 모델보다 성능이 뛰어나 코드 생성 및 수학적 추론과 같은 작업에 우수한 결과를 제공합니다.

4. DeepSeek-R1 모델은 다른 주요 모델과 어떻게 비교됩니까?

DeepSeek-R1 모델은 벤치마크에서 매우 우수한 성능을 보이며, 종종 OpenAI-o1과 같은 주요 모델과 동등하거나 능가합니다. 예를 들어 DeepSeek-R1은 AIME 2024 벤치마크에서 79.8%의 통과율을, MATH-500에서는 97.3%의 통과율을 달성했습니다. 코딩 작업에서는 Codeforces 등급 2029를 달성하여 인간 참가자의 96.3%를 능가했습니다. 증류된 모델 또한 DeepSeek-R1-Distill-Qwen-32B가 다양한 벤치마크에서 OpenAI-o1-mini를 능가하는 등 강력한 성능을 보여줍니다.

More information on DeepSeek-R1

DeepSeek-R1 대체품

더보기 대체품-

DeepCoder: 64K 컨텍스트 코드 AI. 오픈 소스 14B 모델, 예상을 뛰어넘는 성능! 긴 컨텍스트, RL 트레이닝, 최고의 성능.

-

DeepSeek-AI에서 개발한 시각-언어 모델인 DeepSeek-VL2는 고해상도 이미지를 처리하고, MLA를 통해 빠른 응답을 제공하며, VQA 및 OCR과 같은 다양한 시각적 작업에서 뛰어난 성능을 자랑합니다. 연구원, 개발자 및 BI 분석가에게 이상적입니다.

-

DeepSeek-V2: 2360억 MoE 모델. 뛰어난 성능. 매우 저렴한 가격. 타의 추종을 불허하는 경험. 최신 모델로 업그레이드된 채팅 및 API.

-

670억개 파라미터로 구성된 고급 언어 모델인 DeepSeek LLM. 영어와 중국어 2조개 토큰으로 이루어진 방대한 데이터셋을 기반으로 훈련되었습니다.

-

DeepSearch API: 심층적인 쿼리 조사를 위한 혁신적인 도구입니다. 반복 검색, 50만 토큰 컨텍스트, 증거 기반 결과를 통해 복잡한 질문에 대한 포괄적인 답변을 제공하여 연구 및 모든 분야에서 최신 정보를 유지하는 데 이상적입니다.