What is LongLoRA?

LongLoRA는 대용량 언어 모델이 긴 텍스트를 처리할 때의 한계를 해결하기 위해 나온 기술입니다. 사용자는 간단히 코드 두 줄과 A100 머신 8개를 사용하여 7B 모델의 텍스트 길이를 10만 토큰으로, 70B 모델의 텍스트 길이를 3만2천 토큰으로 늘릴 수 있습니다. 또한 세계 최초의 긴 텍스트 대화 언어 모델인 LongAlpaca를 70B 매개변수로 출시했습니다.

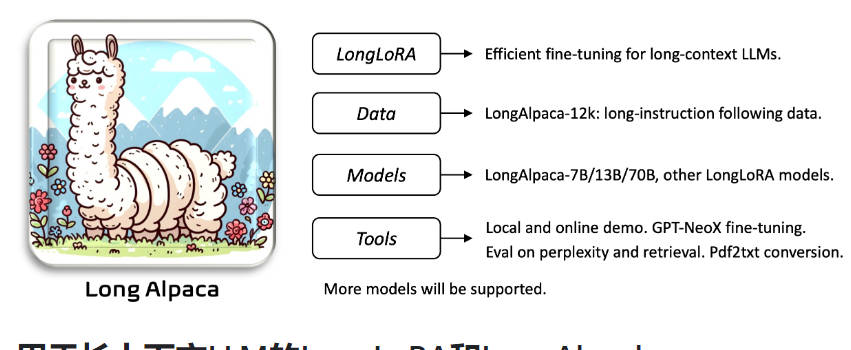

주요 특징:

1. LongLoRA: 이 기술은 대용량 언어 모델에서 텍스트 길이를 늘릴 수 있게 해줍니다.

2. 코드 두 줄: LongLoRA를 구현하려면 코드 두 줄만 입력하면 됩니다.

3. 텍스트 길이 확장: 사용자는 7B 모델의 텍스트 길이를 10만 토큰으로, 70B 모델의 텍스트 길이를 3만2천 토큰으로 늘릴 수 있습니다.

4. LongAlpaca 모델: 연구팀은 인상적인 매개변수 수를 갖춘 긴 텍스트 대화 언어 모델인 LongAlpaca를 개발했습니다.

사용 사례:

1. 학술 논문: 연구자들은 LongAlpaca를 이용해 논문에 대한 피드백을 받고, 보다 명확한 설명, 엄밀한 실험 결과, 다양한 응용 분야, 미래 개발 방향, 핵심 기여도 및 영향을 제공하여 채택률을 높일 수 있습니다.

2. 학술대회 논문 비교: ICLR 및 CVPR과 같은 다양한 학술대회 논문으로 학습한 LongAlpaca를 이용하면 사용자는 이들 학술대회의 스타일 차이를 이론 분석과 수학적 도출의 구조적 초점이나 유연성에 따라 요약할 수 있습니다.

3. 경제 분석: 사용자는 LongAlpaca를 이용해 IMF와 같은 국제 기구가 제공한 요약을 토대로 수년에 걸친 글로벌 경제 전망을 요약하거나 미래 추세를 예측할 수 있습니다.

4. 소설 분석: 독자는 LongAlpaca를 이용해 긴 소설을 철저히 읽은 후 분석할 수 있습니다.

LongLoRA는 대용량 언어 모델이 긴 텍스트를 처리할 때의 한계를 해결해준 혁신적인 기술입니다. 홍콩 중문대 가가야 연구실과 MIT는 텍스트 길이를 늘리고 인상적인 매개변수 수를 갖춘 긴 텍스트 대화 언어 모델인 LongAlpaca를 출시함으로써 연구자, 학자 및 독자 모두에게 새로운 가능성을 열어주었습니다. 이 기술은 대용량 언어 모델의 컨텍스트 윈도우를 확장했을 뿐만 아니라 업계에서 긴 텍스트 기능에 다시 주목하고 초점을 맞추게 했습니다.

More information on LongLoRA

Launched

2024

Pricing Model

Free

Starting Price

Global Rank

Follow

Month Visit

<5k

Tech used

Related Searches