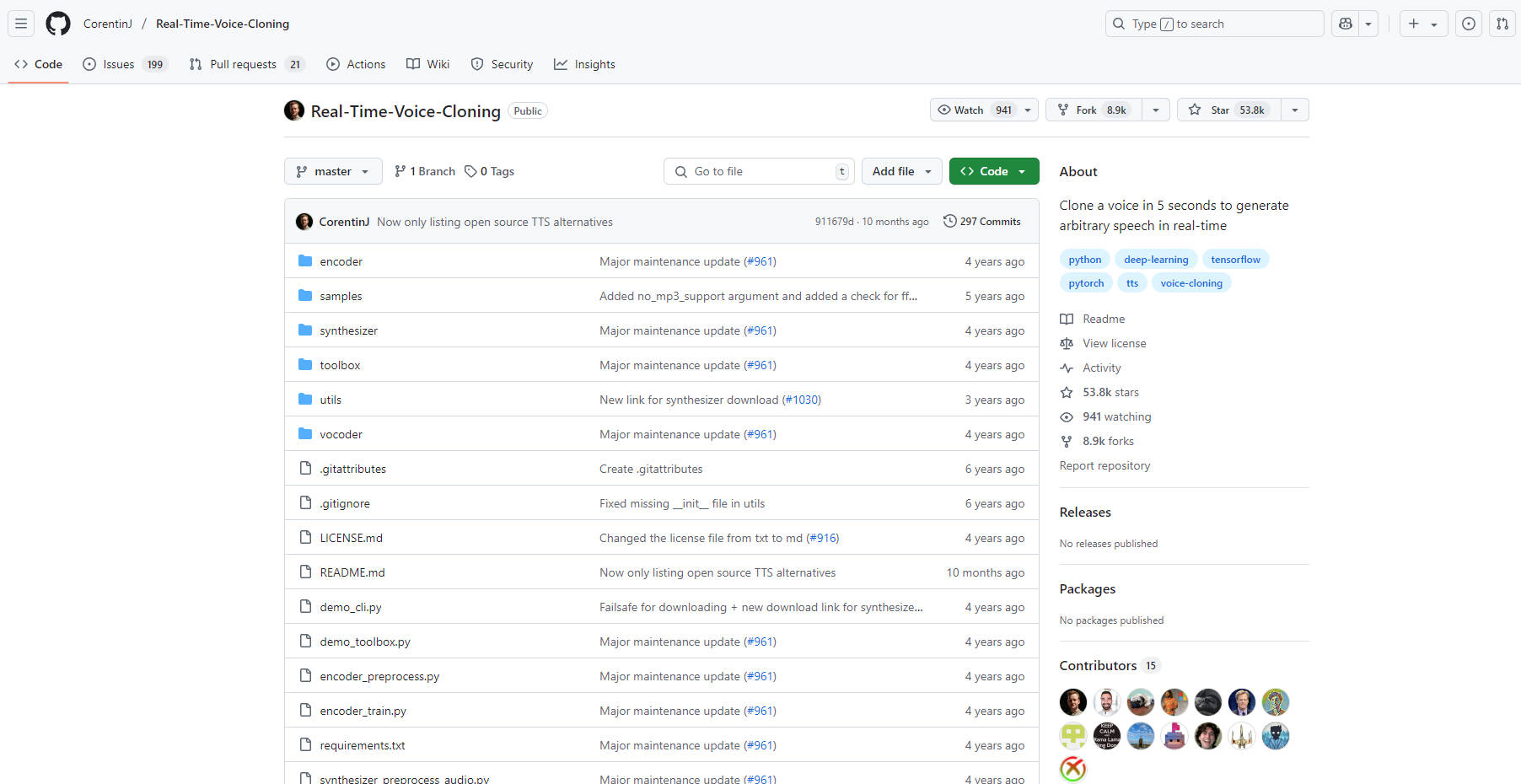

What is Real-Time Voice Cloning?

本仓库提供了一个实时的语音克隆实现方案,即从说话人验证到多说话人文本到语音合成的迁移学习 (SV2TTS),这是一个强大的深度学习框架,可用于语音克隆。该项目基于最初的 SV2TTS 论文 (1806.04558),允许您仅从几秒钟的音频中创建语音的数字表示,然后使用该表示生成具有任意文本的语音。 这是一个实用的、可运行的技术实现,专为研究人员和开发人员而设计。

主要特性:

实现 SV2TTS:提供三阶段 SV2TTS 流程的完整、功能性实现,包括说话人编码器、合成器和声码器。

利用 实时声码器:利用基于 WaveRNN 的声码器 (1802.08435) 实现高效且实时的音频合成。

适配 预训练模型:自动下载预训练模型以供立即使用,或者您可以训练自己的模型。

集成 多个数据集:支持各种数据集,包括 LibriSpeech,用于训练和实验。(请在此处查看详细列表。)

运行 全面测试:包含一个内置的测试套件 (

demo_cli.py) 来验证您的配置并确保正常运行。采用 广义端到端 (GE2E) 损失:实现 GE2E 损失函数 (1710.10467) 以提高说话人验证性能。

技术细节:

该系统构建于一个三阶段的深度学习流水线之上:

说话人编码器: 从目标说话人的短音频样本中提取固定维度的嵌入向量(d-vector)。 此嵌入表示说话人声音的独特特征。 此阶段实现 GE2E 损失函数。

合成器: 基于 Tacotron 架构 (1703.10135),此阶段将说话人嵌入和输入文本序列作为输入。 它生成 mel 频谱图,这是音频信号的时频表示。

声码器: 此组件基于 WaveRNN (1802.08435),将 mel 频谱图转换为原始波形,从而生成最终合成的语音。

应用场景:

定制语音助手开发: 为语音助手和其他交互式应用程序创建独特、个性化的声音。 您可以定制声音以匹配特定品牌或人物角色,而不是依赖于通用的系统声音。

语音合成研究: 为语音克隆、文本到语音和说话人验证的进一步研究奠定基础。 模块化设计允许对各个组件进行实验。

音频内容创作: 使用克隆的声音为视频、播客或有声读物生成逼真的旁白。 这提供了对内容声音特征的灵活性和控制。

结论:

这个 Real-Time Voice Cloning 仓库提供了一个强大而易于使用的平台,用于试验和开发最先进的语音克隆技术。 虽然更新的、通常是付费的 SaaS 解决方案可能提供更高的音频质量,但这个开源项目为研究、开发和定制提供了一个有价值的工具。 对于任何有兴趣探索 SV2TTS 和实时语音合成功能的人来说,这是一个坚实的起点。