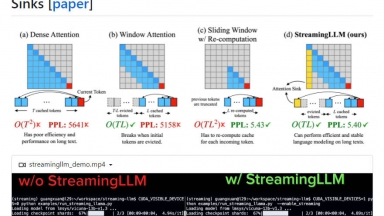

StreamingLLM

StreamingLLM

LMCache

StreamingLLM

| Launched | 2024 |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Workflow Automation,Developer Tools,Communication |

LMCache

| Launched | 2024-10 |

| Pricing Model | Free |

| Starting Price | |

| Tech used | Google Analytics,Google Tag Manager,cdnjs,Cloudflare CDN,Fastly,Google Fonts,GitHub Pages,Gzip,HTTP/3,Varnish |

| Tag | Infrastructure,Data Pipelines,Developer Tools |

StreamingLLM Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

LMCache Rank/Visit

| Global Rank | 475554 |

| Country | China |

| Month Visit | 59830 |

Top 5 Countries

Traffic Sources

Estimated traffic data from Similarweb

What are some alternatives?

vLLM - Un motor de inferencia y servicio de alto rendimiento y bajo consumo de memoria para LLM

EasyLLM - EasyLLM es un proyecto de código abierto que ofrece herramientas y métodos útiles para trabajar con modelos de lenguaje grande (LLM), tanto de código abierto como de código cerrado. Ponte en marcha de inmediato o echa un vistazo a la documentación.

LLMLingua - Para acelerar la inferencia de los LLM y mejorar la percepción de los LLM de información clave, comprime el indicador y KV-Cache, que logra una compresión de hasta 20 veces con una pérdida de rendimiento mínima.

LazyLLM - LazyLLM: Bajo código para aplicaciones LLM multiagente. Desarrolle, itere y despliegue soluciones de IA complejas con rapidez, desde el prototipo hasta la producción. Céntrese en los algoritmos, no en la ingeniería.