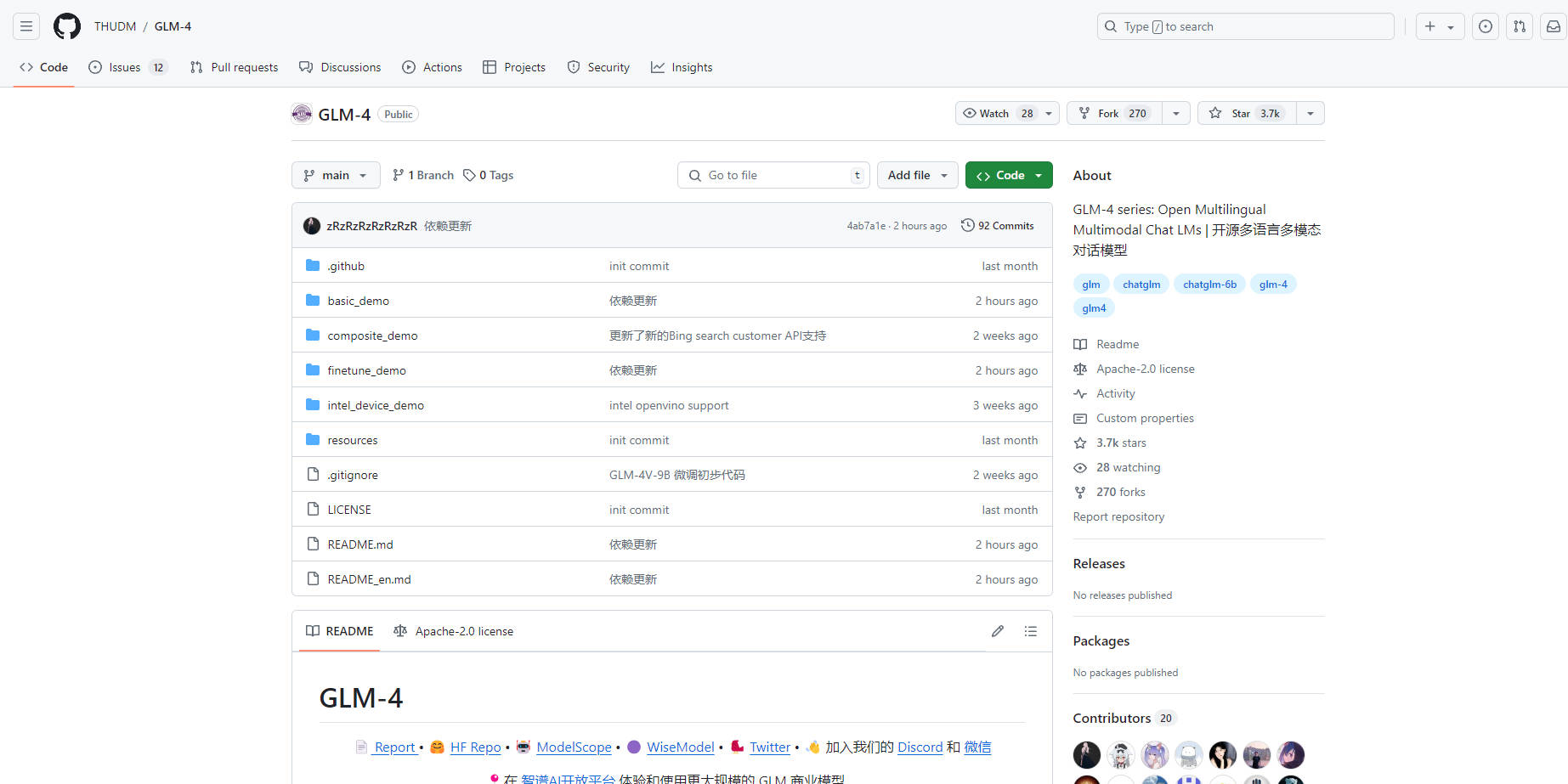

What is Glm-4v-9b?

GLM-4V-9B, développé par l'Université Tsinghua, est un modèle linguistique multimodal de pointe qui excelle dans divers benchmarks, en particulier en reconnaissance optique de caractères (OCR). Il appartient à la série GLM-4, qui comprend également des modèles axés sur la conversation. La caractéristique clé de GLM-4V-9B est ses capacités de compréhension visuelle ajoutées, lui permettant d'effectuer des tâches telles que la description d'images, la réponse aux questions visuelles et le raisonnement multimodal efficacement.

Caractéristiques principales

Compréhension et génération multimodales : GLM-4V-9B peut générer des descriptions détaillées et cohérentes d'images, répondre à des questions sur le contenu visuel et effectuer des tâches telles que le raisonnement visuel et l'OCR. Cela le rend apte à analyser des graphiques ou des diagrammes complexes et à résumer les informations clés.

Prise en charge multilingue : Le modèle prend en charge à la fois le chinois et l'anglais, ce qui le rend polyvalent pour une base d'utilisateurs mondiale. Sa capacité à gérer plusieurs langues améliore son applicabilité dans divers contextes.

Capacités de conversation et multimodales avancées : Avec des capacités telles que la participation à des dialogues visuels et textuels, GLM-4V-9B peut servir d'outil puissant pour le développement d'assistants conversationnels IA multimodaux. Il peut gérer le légendage d'images, la réponse aux questions visuelles et intégrer des éléments visuels et textuels dans la génération de contenu.