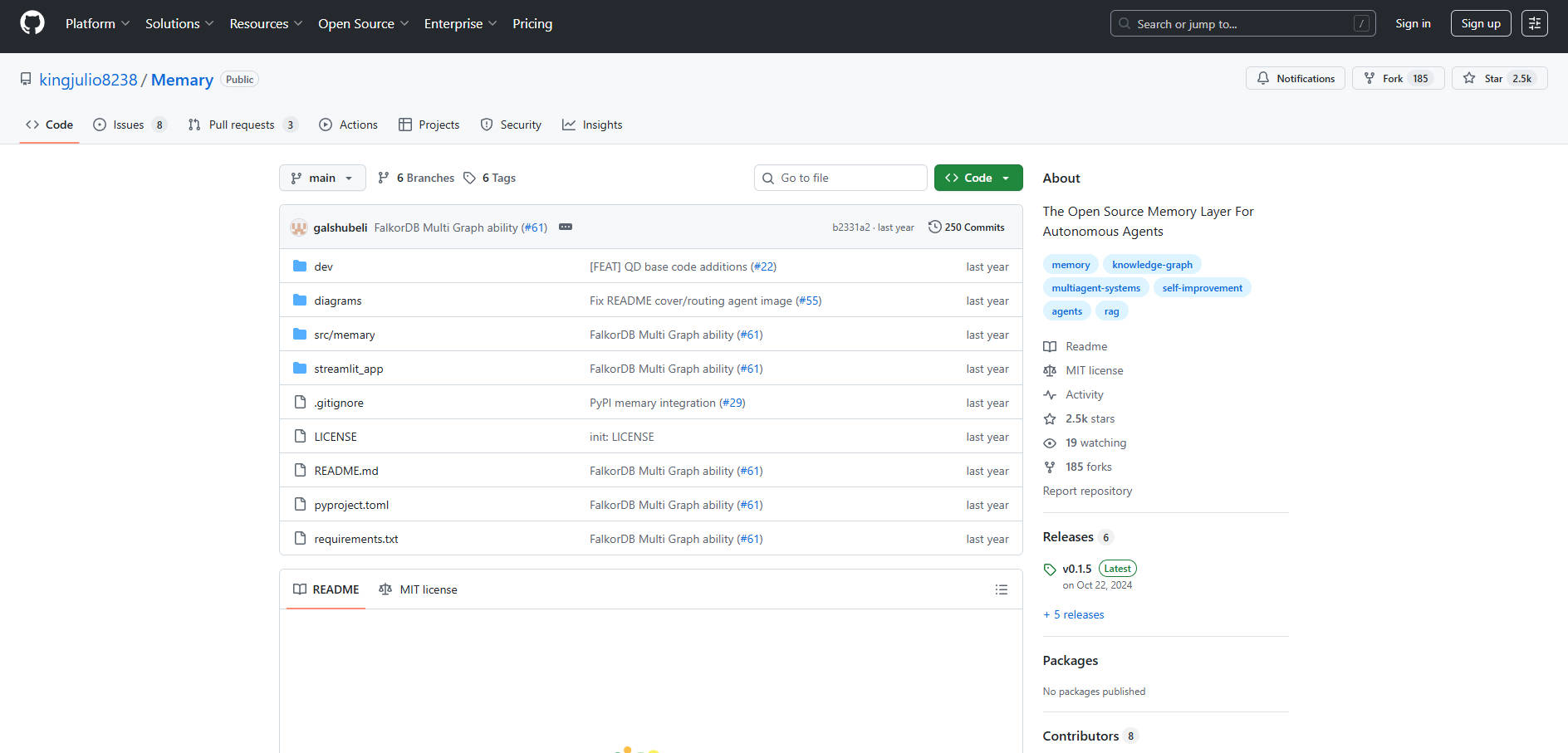

What is Memary ?

memary est une bibliothèque Python robuste conçue pour doter vos agents IA de structures de mémoire persistantes, semblables à celles des humains, améliorant fondamentalement leur capacité à raisonner et à maintenir un contexte dans la durée. Elle pallie la limitation majeure des fenêtres de contexte à court terme des LLM en intégrant des modules sophistiqués de gestion des connaissances et d'analyse de la mémoire. Conçue pour les développeurs et ingénieurs créant des agents IA avancés, personnalisés et véritablement conscients du contexte, memary offre la base essentielle pour la construction de systèmes intelligents capables d'apprendre et d'évoluer.

Caractéristiques Principales

memary s'intègre en toute transparence à votre architecture d'agent existante (prenant en charge les modèles via Ollama ou OpenAI) pour offrir des capacités de mémoire profondes et analytiques.

🧠 Gestion Intégrée du Graphe de Connaissances (KG)

memary utilise une base de données graphe dédiée (par exemple, FalkorDB) pour stocker les connaissances, permettant aux agents de dépasser la simple mémoire séquentielle. Elle met en œuvre une approche de récupération récursive qui identifie les entités clés dans une requête, construit un sous-graphe localisé et utilise ce contexte pour générer des réponses précises. Cette technique réduit drastiquement la latence par rapport à la recherche dans un graphe de connaissances entier.

📈 Modules de Double Mémoire : Flux et Stockage

Le système divise la mémoire en deux composants complémentaires, mimant les fonctions cognitives humaines :

Flux de Mémoire (Memory Stream) : Capture toutes les entités et leurs horodatages, offrant une chronologie étendue de l'exposition et de l'interaction. Cela permet une Analyse Chronologique (Timeline Analysis) pour suivre l'évolution des centres d'intérêt de l'utilisateur.

Base de Connaissances d'Entités (Entity Knowledge Store) : Suit la fréquence et la récence des références d'entités. En classant les entités en fonction de ces facteurs, cette base reflète la profondeur des connaissances et la familiarité de l'utilisateur avec des concepts spécifiques, permettant des réponses hautement personnalisées.

⚙️ Génération Automatique de la Mémoire et Amélioration du Système

Une fois initialisé, memary met automatiquement à jour la structure de mémoire de l'agent au fur et à mesure de ses interactions, capturant toutes les mémoires pertinentes sans nécessiter d'intervention supplémentaire du développeur. Cette boucle de rétroaction constante et évolutive imite la manière dont la mémoire humaine apprend avec le temps, offrant une voie claire pour l'amélioration continue de l'agent.

🧩 Prise en Charge Flexible des Modèles et des Outils

Les développeurs conservent un contrôle total sur les modèles sous-jacents. memary prend en charge les modèles locaux fonctionnant via Ollama (Llama 3, LLaVA sont suggérés) ou les services distants (GPT-3.5-turbo, GPT-4-vision-preview). De plus, vous pouvez facilement ajouter ou supprimer des outils externes personnalisés (par exemple, search, vision, stocks) à l'agent pour étendre ses capacités fonctionnelles.

👥 Commutation de Contexte Multi-Agent et Multi-Graphe

Lors de l'utilisation d'une base de données graphe comme FalkorDB, memary permet la création et la gestion de multiples agents distincts, chacun correspondant à un identifiant de graphe de connaissances unique. Cette fonctionnalité est cruciale pour les développeurs ayant besoin de gérer des contextes personnalisés, permettant des transitions fluides entre différentes personas utilisateur ou projets sans fuite de mémoire (memory bleed).

Cas d'Utilisation

memary est conçue pour les scénarios où la profondeur contextuelle, la personnalisation et la mémoire à long terme sont critiques pour l'expérience utilisateur.

Développement d'Assistants de Recherche Personnalisés : Créez un agent qui se souvient non seulement des faits collectés, mais aussi des méthodologies de recherche spécifiques de l'utilisateur, de ses sources préférées et de ses conclusions antérieures. L'Entity Knowledge Store (Base de Connaissances d'Entités) garantit que l'agent priorise les sujets récemment ou fréquemment référencés, fournissant un contexte hautement pertinent pour les projets en cours.

Mise à l'Échelle et Gestion de Personas Utilisateur Distincts : Pour une plateforme supportant plusieurs utilisateurs distincts, utilisez la capacité Multi-Graphe (Multi-Graph capability) pour attribuer une structure de mémoire unique à chaque ID utilisateur. Cela garantit que les préférences personnelles, l'historique de discussion et la base de connaissances de l'Utilisateur A restent entièrement séparés de ceux de l'Utilisateur B, permettant une véritable personnalisation à grande échelle.

Amélioration de la Clarté et de l'Efficacité Conversationnelle : Appliquez les techniques de compression de mémoire de memary pour gérer efficacement la fenêtre de contexte des LLM. En résumant les conversations passées et en injectant uniquement les entités les plus pertinentes parallèlement à la réponse de l'agent, vous vous assurez que l'agent maintient un contexte à long terme sans entraîner une utilisation excessive de jetons ni perdre de vue l'objectif.

Pourquoi Choisir memary ?

memary offre des avantages architecturaux uniques qui la distinguent des systèmes de récupération de bases de données vectorielles standard, procurant un véritable gain d'informations pour les développeurs.

Récupération Accélérée via le Raisonnement Multi-Sauts (Multi-Hop Reasoning) : Lorsque des requêtes complexes impliquent plusieurs entités clés, memary utilise le raisonnement multi-sauts pour joindre plusieurs sous-graphes pertinents. Cette traversée intelligente garantit que l'agent peut répondre rapidement et précisément à des questions complexes et interconnectées, une capacité que la récupération standard à passage unique a souvent du mal à égaler.

Analyse Contextuelle Approfondie : Contrairement au simple stockage de l'historique de chat, le module de mémoire de memary (Memory Module) effectue des fonctions analytiques (analyse chronologique, de fréquence, de récence) pour déduire les connaissances et les préférences de l'utilisateur. Cela permet aux agents d'adapter leurs réponses plus précisément au niveau d'expertise et aux intérêts actuels de l'utilisateur.

Conçue pour l'Intégration : memary est bâtie sur le principe d'un effort de mise en œuvre minimal. Elle s'intègre aux frameworks d'agents existants, et bien qu'elle fournisse actuellement une implémentation simple d'agent ReAct à des fins de démonstration, sa conception future vise à prendre en charge tout type d'agent, quel que soit le fournisseur.

Conclusion

En offrant un cadre de mémoire structuré, analytique et persistant, memary permet aux développeurs de transcender les limitations des agents IA sans état (stateless). Elle garantit que vos applications peuvent maintenir un contexte profond, apprendre des interactions et offrir des expériences personnalisées et pertinentes.

Découvrez dès aujourd'hui comment memary peut transformer vos agents IA en partenaires véritablement intelligents et fiables.

More information on Memary

Memary Alternatives

Plus Alternatives-

-

Mettez fin à l'oubli de l'IA ! MemMachine offre à vos agents IA une mémoire à long terme et adaptative. Open source et agnostique aux modèles pour une IA personnalisée et sensible au contexte.

-

-

Supermemory dote vos LLMs d'une mémoire à long terme. Plutôt qu'une génération de texte sans état, ils se remémorent les faits pertinents issus de vos fichiers, chats et outils, pour que les réponses demeurent cohérentes, contextuelles et personnelles.

-

MemoryGraph gives your AI assistants persistent memory. Store solutions, track patterns, recall context across sessions. Zero config, local-first, privacy by default.