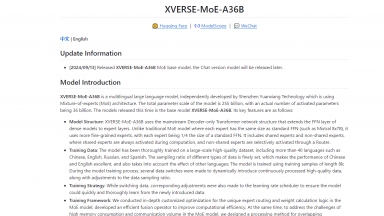

XVERSE-MoE-A36B

XVERSE-MoE-A36B

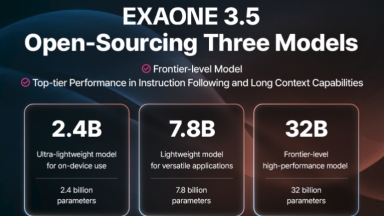

EXAONE 3.5

EXAONE 3.5

XVERSE-MoE-A36B

| Launched | |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Content Creation,Story Writing,Text Generators |

EXAONE 3.5

| Launched | |

| Pricing Model | Free |

| Starting Price | |

| Tech used | |

| Tag | Text Generators,Question Answering,Answer Generators |

XVERSE-MoE-A36B Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

EXAONE 3.5 Rank/Visit

| Global Rank | |

| Country | |

| Month Visit |

Top 5 Countries

Traffic Sources

Estimated traffic data from Similarweb

What are some alternatives?

Yuan2.0-M32 - Yuan2.0-M32 — это языковая модель, основанная на архитектуре "смесь экспертов" (MoE) с 32 экспертами, из которых активны 2.

DeepSeek Chat - DeepSeek-V2: 236-миллиардная модель MoE. Передовые характеристики. Ультрадоступно. Несравненный опыт. Чат и API обновлены до последней модели.

JetMoE-8B - JetMoE-8B был обучен с затратами менее 0,1 миллиона долларов1, но превосходит LLaMA2-7B от Meta AI, которая имеет многомиллиардные ресурсы обучения. Обучение LLM может быть намного дешевле, чем обычно считается.

Yi-VL-34B - Модель Yi Visual Language (Yi-VL) — это открытый исходный код, мультимодальная версия серии больших языковых моделей (LLM) Yi, обеспечивающая понимание, распознавание и многораундовые диалоги о изображениях.