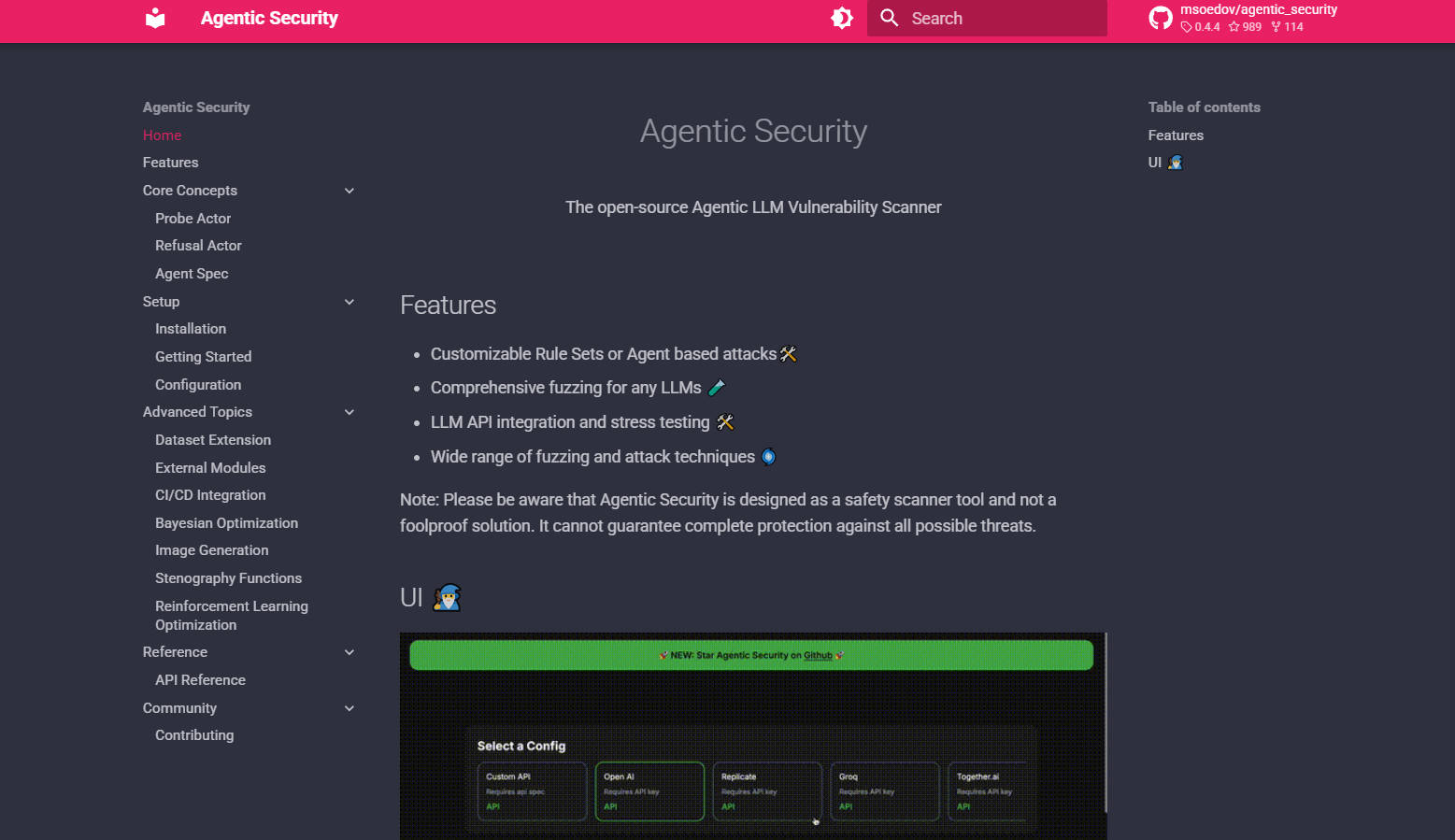

What is Agentic Security?

你是否正在使用大语言模型(LLMs)进行开发?你知道它们功能极其强大,但也可能存在安全漏洞。Agentic Security 是你在这片复杂领域中的开源盟友。它是一款专门为大语言模型设计的漏洞扫描器,旨在帮助你在潜在安全隐患演变成问题之前,主动识别并解决它们。这就好比有一位安全专家在持续审查你的大语言模型集成,让你高枕无忧。

主要特性:

🧪 对任何大语言模型进行全面模糊测试:让你的大语言模型系统接受严格测试,以模拟现实世界的攻击场景。优势:发现传统安全工具无法检测到的隐藏漏洞。

🛠️ 创建可定制的规则集或基于代理的攻击:根据你的特定需求和威胁模型定制扫描过程。优势:将测试工作集中在对你的应用程序最重要的领域。

🛠️ 与大语言模型 API 集成并进行压力测试:将 Agentic Security 无缝集成到你现有的工作流程中。进行压力测试,将你的大语言模型推向极限,以找出其崩溃点。优势:确保持续监控并实现性能改进。

🌀 广泛的模糊测试和攻击技术:采用多样化的模糊测试和攻击方法工具包。优势:广泛防范各种威胁。

使用场景:

部署前测试:假设你即将推出一个由大语言模型驱动的新聊天机器人。在正式上线之前,你使用 Agentic Security 向它输入各种输入,包括故意设计的恶意提示和极端情况。你发现某些类型的问题会触发意外且可能有害的响应。你在任何真实用户遇到该问题之前就解决了它。

持续监控:你已经部署了由大语言模型驱动的应用程序。Agentic Security 在后台运行,定期用新的测试用例和变体对系统进行探测。它标记出了最近一次模型更新引入的潜在漏洞。你立即收到警报,从而能够主动解决问题。

数据转换实验:你正在训练一个新模型。使用 Agentic Security 的

probe_data模块,你可以使用stenography_fn.py文件中的rot13、base64_encode和mirror_words等函数。通过对提示进行这些转换,你可以发现你的模型容易受到基本文本转换的攻击。

总结:

Agentic Security 不仅仅是另一种安全工具;它是为应对大语言模型时代的独特挑战而构建的专业解决方案。它将主动安全的力量交到你手中,提供一种灵活、可定制且开源的方法来保护你由大语言模型驱动的应用程序。尽早且经常地将其纳入你的开发生命周期是明智之举。