What is NeuralTrust?

NeuralTrust 是一款企业级的安全平台,旨在解决大型语言模型 (LLMs) 在安全防护、测试、监控和扩展方面面临的独特挑战。它为首席信息安全官 (CISO) 和人工智能团队提供了一个统一的指挥中心,具备全面的保护、深入的可观测性和强大的合规能力。

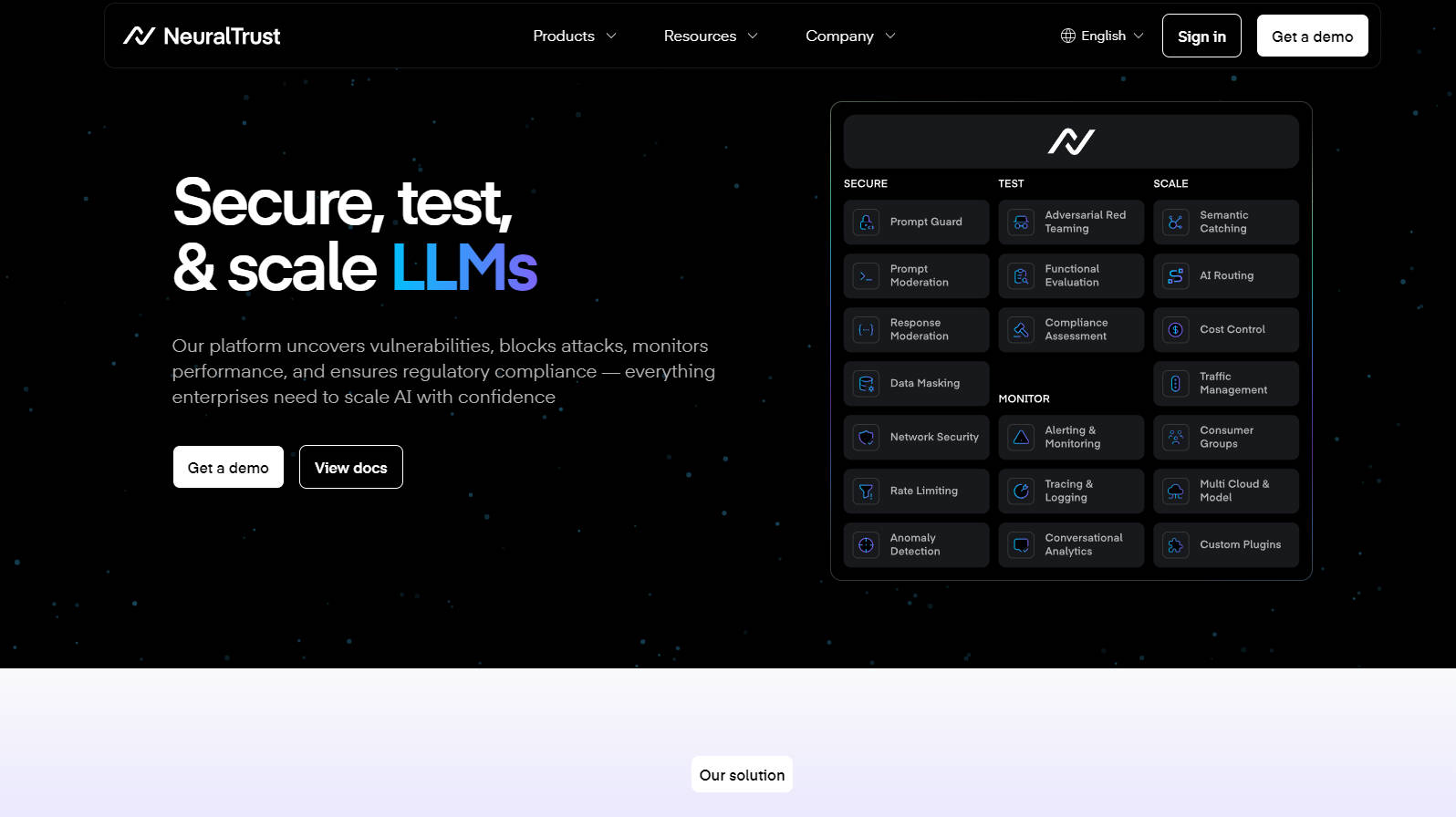

主要特性:

🔒 TrustGate (AI 网关): 实施零信任、开源的 AI 网关,以保护所有 LLM 流量。强制执行组织范围内的策略,实现供应商独立性,并受益于行业领先的性能(25k 请求/秒,<1 毫秒响应延迟)。

技术细节: 采用多层方法,结合网络安全、语义防御和配额管理。

🔬 TrustTest (自动化红队演练): 通过自动化渗透测试持续评估 LLM 的漏洞。利用不断更新的威胁数据库和特定领域的测试功能。

技术细节: 采用先进的算法进行对抗性测试,并提供可定制的评估标准(准确性、语气等)。

👁️ TrustLens (实时可观测性): 通过先进的监控、警报和分析,全面追踪和洞察 AI 行为。确保符合欧盟 AI 法案和 GDPR 等法规。

技术细节: 提供可定制的对话分析、实时异常检测和详细的跟踪日志,用于调试复杂的多代理系统。

🚀 扩展 LLM:

技术细节: 提供语义缓存以降低成本和延迟。通过消费者组实施细粒度的基于角色的访问控制。受益于流量管理功能,如负载平衡和 A/B 测试。

使用场景:

缓解 Prompt 注入攻击: NeuralTrust 的 TrustGate 检测并阻止复杂的 Prompt 注入尝试,防止恶意行为者操纵 LLM 输出。

确保 GDPR 合规性: TrustLens 提供详细的审计跟踪和数据沿袭跟踪,简化了 GDPR 和其他数据隐私法规的合规性。

优化 LLM 性能: TrustTest 识别性能瓶颈和改进领域,使团队能够优化 LLM 部署,以提高速度和效率。

结论:

NeuralTrust 是组织大规模部署 LLM 的必备安全平台。其开源核心、高性能架构和全面的功能集提供了构建安全、可靠和合规的 AI 应用程序所需的工具。