What is Cortex?

Cortex 是一個強大且多功能的 AI 引擎,為開發人員提供了一個與 OpenAI 相容的介面,用於構建基於大型語言模型 (LLM) 的應用程序。其類似的 Docker CLI 和 Typescript 庫簡化了本地 AI 開發,抽象化了硬體和引擎複雜性。Cortex 支援 Llama.cpp、ONNX Runtime 和 TensorRT-LLM 等引擎,確保從物聯網到伺服器的各種設備都能實現高性能執行。Cortex 以靈活性與適應性為設計理念,允許從各種註冊表中提取模型,並支援多個數據庫以實現高效的數據管理。

主要功能:

OpenAI 等效 API:Cortex 提供了 OpenAI 的 API 鏡像,方便平滑過渡到自託管的開源替代方案,而無需進行大量的代碼重寫。

多引擎支援:開發人員可以從 Llama.cpp、ONNX Runtime 和 TensorRT-LLM 引擎中選擇用於模型執行,根據特定硬體配置提供優化。

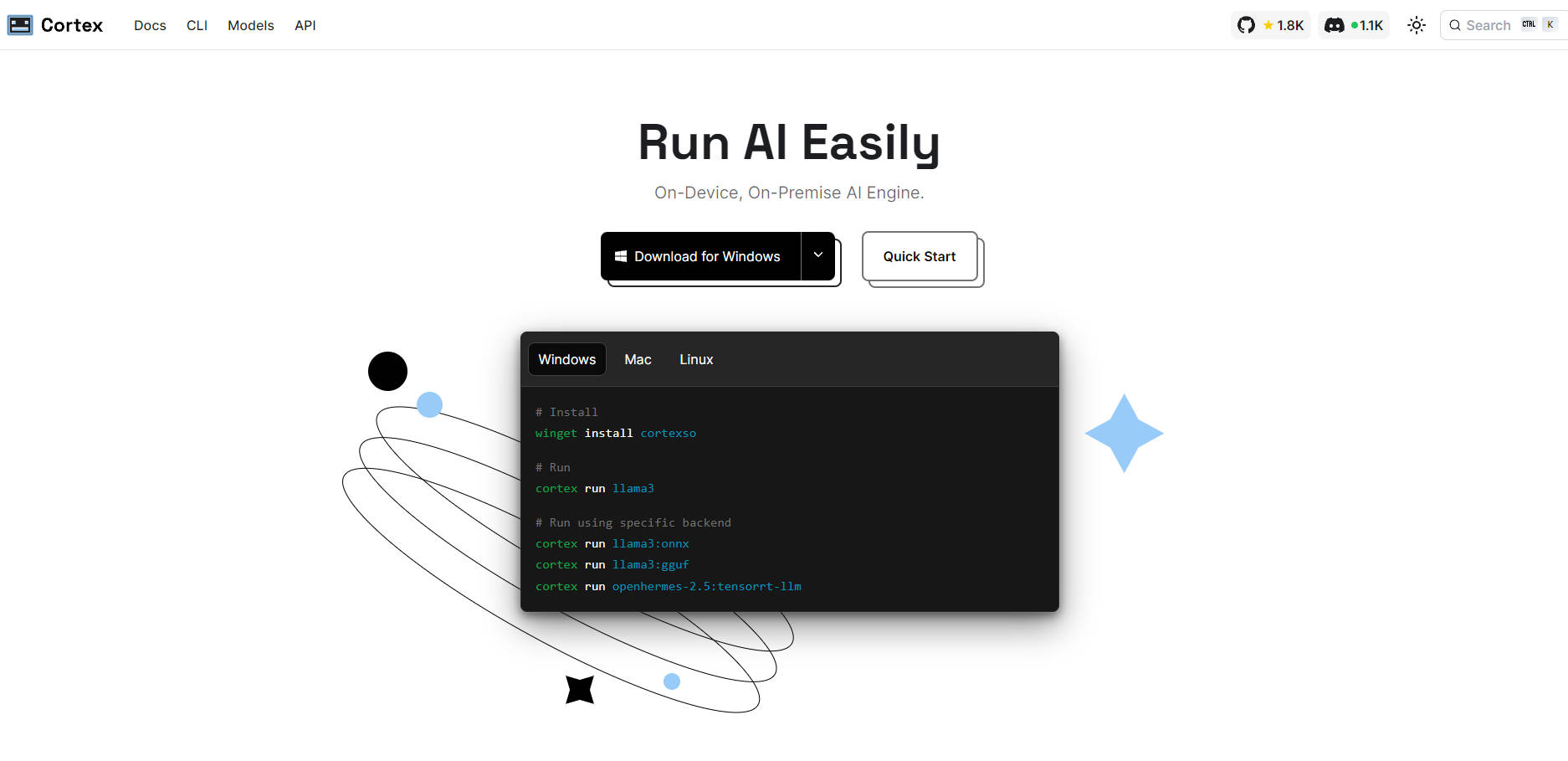

受 Docker 啟發的 CLI 和庫:CLI 和 Typescript 庫使模型部署和應用程序開發變得容易,簡化了使用複雜 AI 系統的過程。

靈活的模型管理:Cortex 支援來自任何註冊表的模型,擴展了兼容性,並簡化了與預先訓練模型的集成。

可擴展的數據管理:Cortex 配備了 MySQL 和 SQLite 數據庫,可以處理大型模型和更簡單的應用程序,提供優化的數據處理和存儲。

用例:

物聯網設備集成:Cortex 的輕量級設計允許在物聯網設備上實現 AI 功能,使設備能夠進行處理而無需依賴雲端。

在伺服器上部署自訂模型:企業可以本地託管其模型以確保隱私和速度,利用 Cortex 的多引擎支援來優化性能。

邊緣計算解決方案:在邊緣設備上部署 Cortex 將 AI 功能更靠近數據源,減少延遲並改善實際應用程序的響應時間。

結論:

Cortex 正在徹底改變 AI 開發,提供了一個全面的、用戶友好的解決方案,用於構建、部署和運行 AI 應用程序。憑藉其強大的功能,Cortex 不僅簡化了 AI 的集成,而且使開發人員能夠在各種平台上利用尖端技術。立即探索 Cortex,在您的項目中發揮 AI 的全部潛力!

常見問題解答:

Cortex 相較於 OpenAI 的主要優勢是什麼?

Cortex 提供了具有等效 API 功能的自託管開源替代方案,允許更有效地控制數據、性能優化以及降低成本。我可以使用 Cortex 在邊緣設備上開發應用程序嗎?

當然可以!Cortex 支援物聯網和 SBC,加上其多引擎兼容性,使其成為邊緣 AI 應用的理想選擇。Cortex 如何處理模型管理?

Cortex 簡化了模型管理,允許從任何模型註冊表中提取,確保靈活性並簡化與預先訓練模型的集成。