What is EasyLLM?

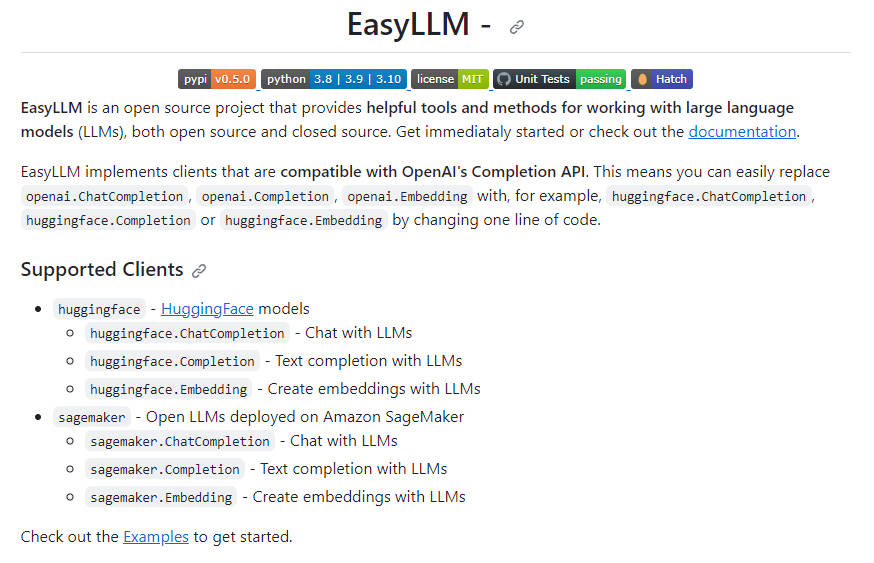

EasyLLM es un proyecto de código abierto que ofrece herramientas y métodos útiles para trabajar con modelos de lenguaje grande (LLM). Proporciona clientes compatibles con la Completion API de OpenAI, lo que permite una integración sencilla con distintos LLM. Con EasyLLM, los usuarios pueden cambiar entre varios LLM, como HuggingFace y SageMaker, realizando un simple cambio en el código. El proyecto tiene como objetivo simplificar el proceso de trabajo con LLM y ofrece ejemplos y documentación para ayudar a los usuarios a empezar.

Características principales:

1. Clientes compatibles: EasyLLM implementa clientes que son compatibles con la Completion API de OpenAI, incluyendo huggingface.ChatCompletion, huggingface.Completion, huggingface.Embedding, sagemaker.ChatCompletion, sagemaker.Completion y sagemaker.Embedding. Estos clientes permiten a los usuarios interactuar con los LLM y realizar tareas como completar chats, completar textos y crear inserciones.

2. Fácil integración: cambiando solo una línea de código, los usuarios pueden cambiar entre diferentes LLM, como HuggingFace y SageMaker, utilizando EasyLLM. Esta flexibilidad permite a los usuarios aprovechar las fortalezas de diferentes LLM para sus necesidades específicas.

3. Compatibilidad con transmisión: EasyLLM admite la transmisión de compleciones, lo que permite a los usuarios procesar grandes cantidades de datos de manera eficiente. Esta función es particularmente útil cuando se trabaja con aplicaciones en tiempo real o se manejan flujos continuos de texto.

4. Módulos auxiliares: EasyLLM proporciona módulos auxiliares adicionales, como evol_instruct y prompt_utils. Estos módulos ofrecen funcionalidades como el uso de algoritmos evolutivos para crear instrucciones para LLM y convertir formatos de petición entre mensajes de OpenAI y modelos de código abierto como Llama 2.

Casos de uso:

1. Chat Completion: Los clientes huggingface.ChatCompletion y sagemaker.ChatCompletion de EasyLLM pueden usarse para crear aplicaciones de chatbot. Estos clientes permiten a los usuarios tener conversaciones interactivas con LLM, haciéndolos adecuados para atención al cliente, asistentes virtuales o cualquier escenario que requiera una respuesta de chat en tiempo real.

2. Text Completion: Con huggingface.Completion y sagemaker.Completion, EasyLLM permite a los usuarios generar textos completos basados en indicaciones dadas. Esto puede ser útil para tareas como generación de contenido, asistencia de escritura o generación de sugerencias basadas en la entrada del usuario.

3. Creación de Inserciones: Los clientes huggingface.Embedding y sagemaker.Embedding de EasyLLM permiten a los usuarios crear inserciones con LLM. Las inserciones son útiles para tareas como el procesamiento del lenguaje natural, el análisis de sentimientos o la clasificación de textos.

EasyLLM es un versátil proyecto de código abierto que simplifica el trabajo con modelos de lenguaje grande. Sus clientes compatibles, la fácil integración con diferentes LLM, la compatibilidad con la transmisión y los módulos auxiliares lo convierten en una herramienta valiosa para diversas aplicaciones. Ya sea que necesites completar chats, completar textos o crear inserciones, EasyLLM proporciona las herramientas y los recursos necesarios para mejorar tus flujos de trabajo con modelos de lenguaje. Comienza con EasyLLM hoy mismo y experimenta el poder de los modelos de lenguaje grande en tus proyectos.