What is EasyLLM?

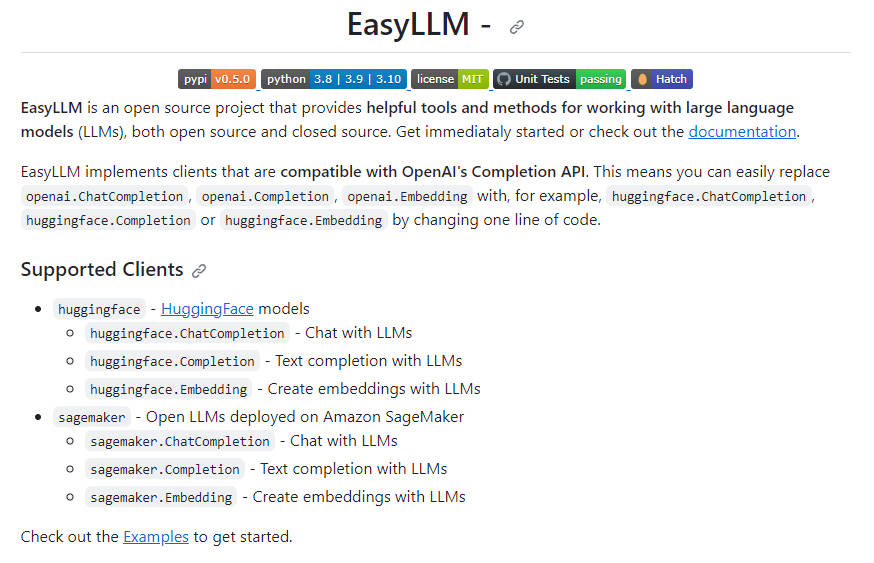

EasyLLM — это проект с открытым исходным кодом, предлагающий полезные инструменты и методы для работы с большими языковыми моделями (LLM). Он предоставляет совместимые клиенты для Completion API OpenAI, что дает возможность легкой интеграции с различными LLM. EasyLLM позволяет пользователям переключаться между различными LLM (например, HuggingFace и SageMaker) с помощью простого изменения кода. Цель проекта — упростить процесс работы с LLM. Он также предлагает примеры и документацию, чтобы помочь пользователям начать работу.

Ключевые особенности:

1. Совместимые клиенты: EasyLLM реализует клиентов, совместимых с Completion API OpenAI, включая huggingface.ChatCompletion, huggingface.Completion, huggingface.Embedding, sagemaker.ChatCompletion, sagemaker.Completion и sagemaker.Embedding. Эти клиенты позволяют пользователям взаимодействовать с LLM и выполнять такие задачи, как завершение чата, завершение текста и создание вложений.

2. Простая интеграция: изменив всего одну строку кода, пользователи могут переключаться между разными LLM, например HuggingFace и SageMaker, с помощью EasyLLM. Такая гибкость позволяет пользователям использовать преимущества разных LLM для решения конкретных задач.

3. Поддержка потоковой передачи: EasyLLM поддерживает потоковую передачу завершений, что позволяет пользователям эффективно обрабатывать большие объемы данных. Эта функция особенно полезна при работе с приложениями реального времени или обработке непрерывных потоков текста.

4. Вспомогательные модули: EasyLLM предоставляет дополнительные вспомогательные модули, такие как evol_instruct и prompt_utils. Эти модули предлагают функциональные возможности, например использование эволюционных алгоритмов для создания инструкций для LLM и преобразование форматов подсказок между сообщениями OpenAI и моделями с открытым исходным кодом, такими как Llama 2.

Варианты использования:

1. Завершение чата: клиенты huggingface.ChatCompletion и sagemaker.ChatCompletion EasyLLM можно использовать для создания приложений для чат-ботов. Эти клиенты позволяют пользователям вести интерактивные беседы с LLM, что делает их подходящими для поддержки клиентов, виртуальных помощников или любых сценариев, требующих ответа на чат в режиме реального времени.

2. Завершение текста: с помощью huggingface.Completion и sagemaker.Completion EasyLLM позволяет пользователям генерировать завершения текста на основе заданных подсказок. Это может быть полезно для таких задач, как создание контента, помощь в написании или создание предложений на основе ввода пользователя.

3. Создание вложений: клиенты huggingface.Embedding и sagemaker.Embedding EasyLLM позволяют пользователям создавать вложения с помощью LLM. Вложения полезны для таких задач, как обработка естественного языка, анализ настроений или классификация текста.

EasyLLM — это универсальный проект с открытым исходным кодом, упрощающий работу с большими языковыми моделями. Его совместимые клиенты, простая интеграция с различными LLM, поддержка потоковой передачи и вспомогательные модули делают его ценным инструментом для различных приложений. Независимо от того, нужно ли вам завершение чата, завершение текста или создание вложений, EasyLLM предоставляет необходимые инструменты и ресурсы для улучшения рабочих процессов вашей языковой модели. Начните работу с EasyLLM уже сегодня и ощутите всю мощь больших языковых моделей в своих проектах.