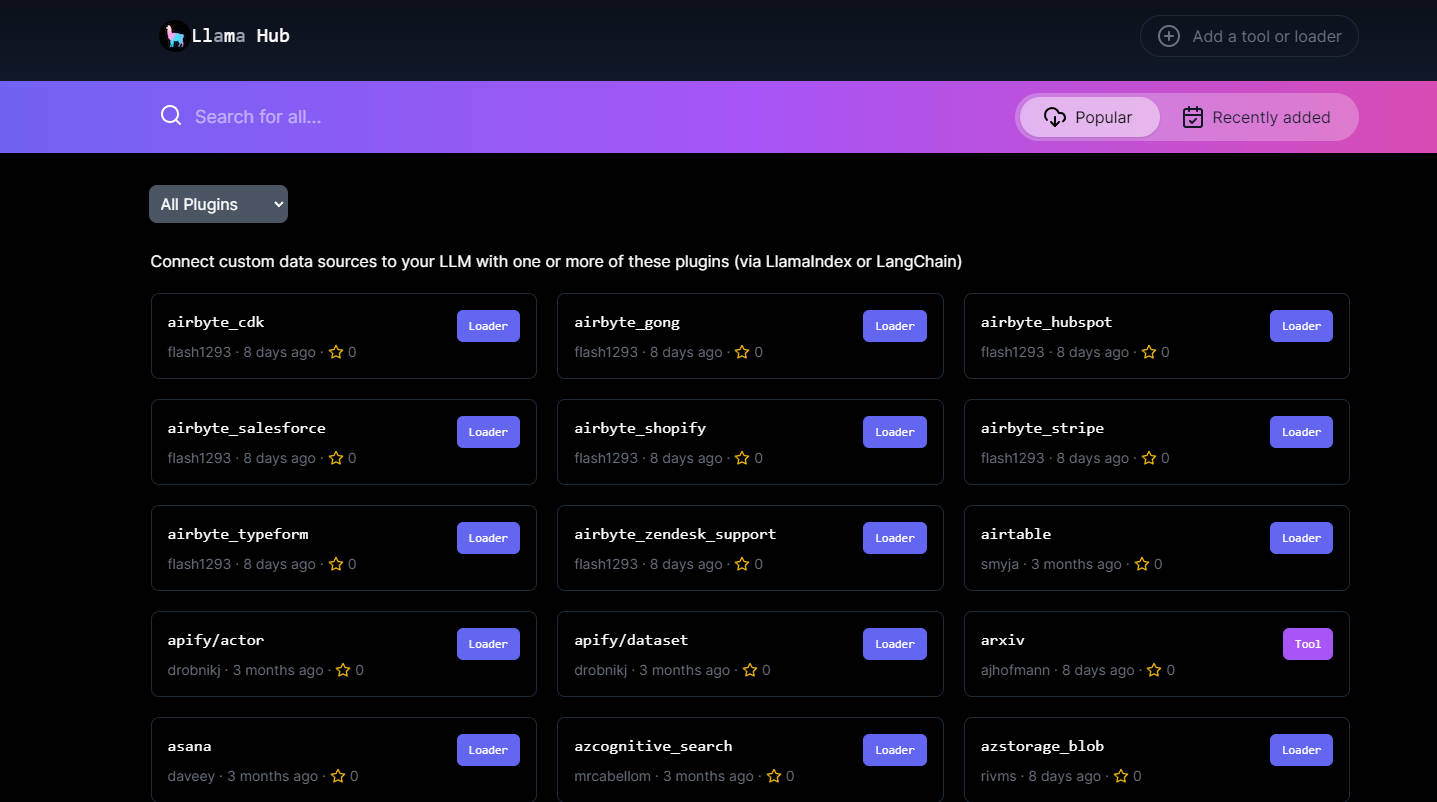

What is LlamaHub?

Características principales:

1. Utilidades de propósito general para la ingesta de datos para la búsqueda y recuperación de modelos de lenguaje grandes. 2. Herramientas para que los modelos lean y escriban en servicios y fuentes de datos de terceros. 3. Ejemplos de agentes de datos para cargar y analizar datos de Google Docs, bases de datos SQL, Notion, Slack y administrar Google Calendar, la bandeja de entrada de Gmail y las especificaciones de OpenAPI. 4. LangChain para responder preguntas y cargar documentos. LlamaHub es una herramienta valiosa para conectar modelos de lenguaje grandes con varias fuentes de conocimiento. Sus utilidades y herramientas de propósito general facilitan la ingesta de datos y la creación de agentes de datos personalizados, desbloqueando todo el potencial de los modelos de lenguaje grandes.

More information on LlamaHub

Top 5 Countries

Traffic Sources

LlamaHub Alternativas

Más Alternativas-

Llama 2 es una potente herramienta de IA que potencia a los desarrolladores mientras promueve prácticas responsables. Al mejorar la seguridad en los casos de uso de chat y fomentar la colaboración en la investigación académica, da forma al futuro de la IA de manera responsable.

-

Descubre Code Llama, una herramienta de IA de vanguardia para la generación y comprensión de código. Aumenta la productividad, agiliza los flujos de trabajo y facilita la labor de los desarrolladores.

-

-

LlamaIndex desarrolla agentes de IA inteligentes a partir de tus datos empresariales. Potencia los LLMs con RAG avanzado, transformando documentos complejos en conocimientos fiables y procesables.

-