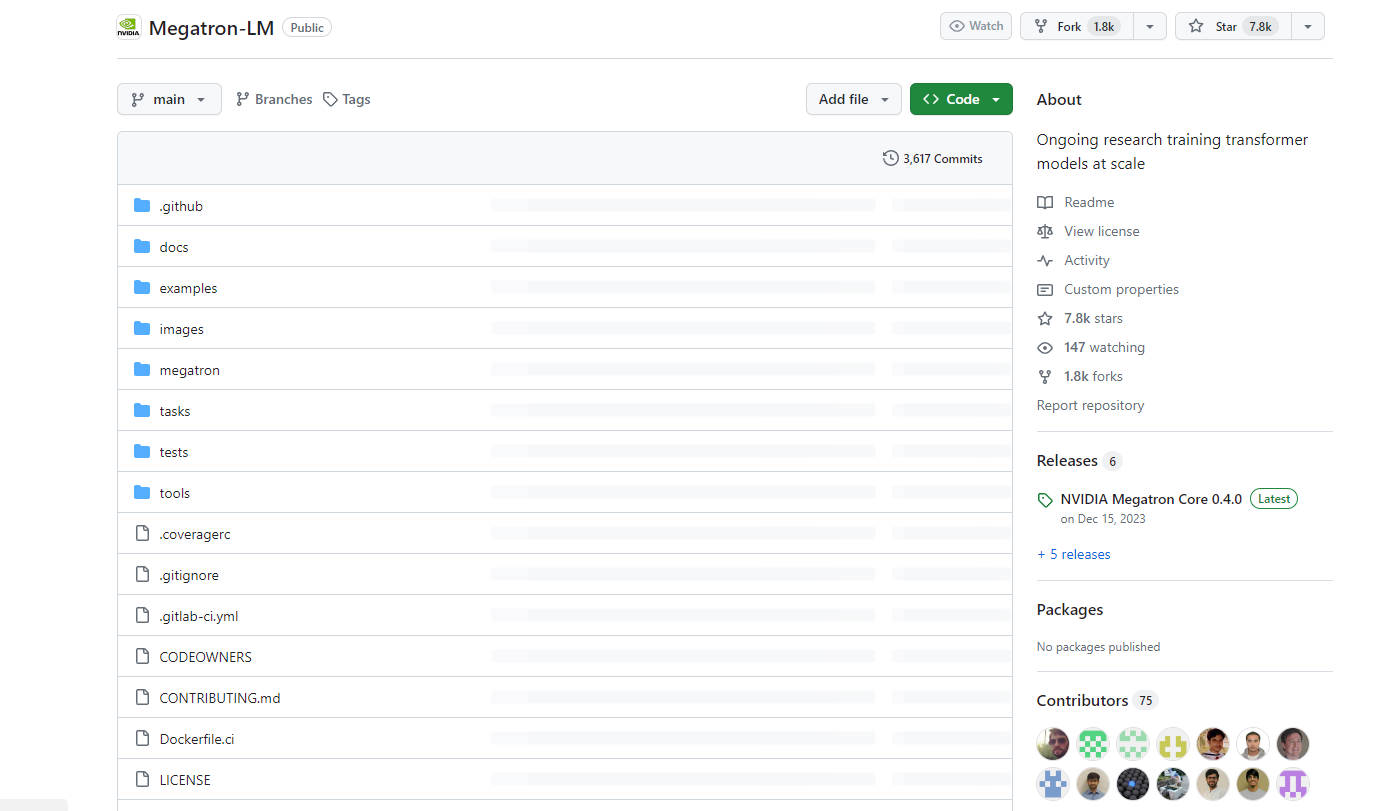

What is Megatron-LM?

Megatron es un potente transformador desarrollado por NVIDIA para entrenar modelos de lenguaje a gran escala. Ofrece eficientes capacidades de preentrenamiento en paralelo con el modelo y multinodo para modelos como GPT, BERT y T5. Con Megatron, las empresas pueden superar los desafíos de construir y entrenar modelos sofisticados de procesamiento del lenguaje natural con miles de millones y billones de parámetros.

Características clave:

? Entrenamiento eficiente: Megatron permite el entrenamiento eficiente de modelos de lenguaje con cientos de miles de millones de parámetros utilizando paralelismo de modelo y datos.

? Paralelismo de modelo: Admite paralelismo de modelo de tensor, secuencia y canalización, lo que permite escalar modelos en múltiples GPU y nodos.

? Preentrenamiento versátil: Megatron facilita el preentrenamiento de varios modelos basados en transformadores como GPT, BERT y T5, lo que permite el desarrollo de modelos de lenguaje generativos a gran escala.

Casos de uso:

? Modelado del lenguaje: Megatron se utiliza para el preentrenamiento de modelos de lenguaje a gran escala, lo que permite la creación de modelos potentes para tareas como generación de texto, traducción y resumen.

?️ Recuperación de información: Se emplea en el entrenamiento de recuperadores neuronales para responder preguntas de dominio abierto, mejorando la precisión y relevancia de los resultados de búsqueda.

? Agentes conversacionales: Megatron impulsa a los agentes conversacionales al permitir el modelado de diálogo generativo multiactor a gran escala, mejorando la calidad y naturalidad de las conversaciones automatizadas.

Conclusión:

Megatron es una herramienta de IA de vanguardia desarrollada por NVIDIA, diseñada para entrenar modelos de transformadores a gran escala. Con sus eficientes capacidades de entrenamiento, soporte para paralelismo de modelo y versatilidad en el preentrenamiento de varios modelos de lenguaje, Megatron permite a las empresas construir y entrenar modelos sofisticados de procesamiento del lenguaje natural con un rendimiento y precisión excepcionales. Ya sea modelado del lenguaje, recuperación de información o agentes conversacionales, Megatron es un activo valioso para investigadores y desarrolladores de IA.

More information on Megatron-LM

Megatron-LM Alternativas

Más Alternativas-

KTransformers, un proyecto de código abierto del equipo KVCache.AI de Tsinghua y QuJing Tech, optimiza la inferencia de modelos de lenguaje grandes. Reduce los umbrales de hardware, ejecuta modelos de 671B parámetros en GPUs individuales de 24GB de VRAM, aumenta la velocidad de inferencia (hasta 286 tokens/s en pre-procesamiento, 14 tokens/s en generación) y es adecuado para uso personal, empresarial y académico.

-

Transformer Lab: Una plataforma de código abierto para construir, ajustar y ejecutar LLMs localmente sin necesidad de programar. Descarga cientos de modelos, ajusta finamente en diferentes hardwares, chatea, evalúa y mucho más.

-

MonsterGPT: Afina y despliega modelos de IA personalizados a través de chat. Simplifica tareas complejas de LLM e IA. Accede fácilmente a más de 60 modelos de código abierto.

-

Nemotron-4 340B, una familia de modelos optimizados para NVIDIA NeMo y NVIDIA TensorRT-LLM, incluye modelos de instrucción y recompensa de vanguardia, y un conjunto de datos para entrenamiento de IA generativa.

-