What is Qwen2-VL?

Qwen2-VL, la última generación de modelos de lenguaje visual, diseñada para brindar claridad y profundidad a su comprensión del mundo visual. Construido sobre la base de Qwen2, Qwen2-VL ofrece avances significativos en la comprensión de imágenes y videos, convirtiéndolo en una herramienta versátil para diversas aplicaciones.

Características Clave:

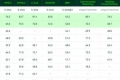

Interpretación Avanzada de Imágenes: Qwen2-VL sobresale en la comprensión de imágenes de diferentes resoluciones y proporciones. Su excepcional desempeño en puntos de referencia de comprensión visual como MathVista, DocVQA, RealWorldQA y MTVQA lo posiciona a la vanguardia de su campo.

Comprensión de Videos Largos: Qwen2-VL extiende sus capacidades para comprender videos de más de 20 minutos. Esta característica permite una amplia gama de aplicaciones, incluyendo preguntas y respuestas basadas en video, diálogo y creación de contenido.

Agente Inteligente Visual: Con sus complejas capacidades de razonamiento y toma de decisiones, Qwen2-VL puede integrarse a teléfonos inteligentes y robots, permitiéndoles realizar operaciones automatizadas basadas en señales visuales e instrucciones textuales.

Soporte Multilingüe: Qwen2-VL atiende a una audiencia global al admitir la interpretación de texto multilingüe en imágenes, incluyendo la mayoría de los idiomas europeos, japonés, coreano, árabe, vietnamita y más, además de inglés y chino.

Rendimiento del Modelo: Qwen2-VL, disponible en tamaños que van desde 2B hasta 72B, supera a varios modelos líderes, especialmente en la comprensión de documentos. La versión 72B establece un nuevo punto de referencia para modelos multimodales de código abierto.

Limitaciones del Modelo: Si bien Qwen2-VL ofrece numerosas fortalezas, también tiene limitaciones, como la incapacidad de extraer audio de videos, el corte de conocimiento en junio de 2023 y desafíos en el manejo de instrucciones y escenas complejas, conteo, reconocimiento de personas y conciencia espacial 3D.

Arquitectura del Modelo: La arquitectura de Qwen2-VL incluye innovaciones como soporte de resolución dinámica y Multimodal Rotated Position Embedding (M-ROPE), mejorando su capacidad para procesar y comprender datos multimodales.

Accesibilidad y Licencia: Qwen2-VL-2B y Qwen2-VL-7B son de código abierto bajo la licencia Apache 2.0, y su integración en plataformas como Hugging Face Transformers y vLLM los hace accesibles para los desarrolladores.

En conclusión, Qwen2-VL es una herramienta poderosa que mejora la comprensión visual y ofrece una amplia gama de aplicaciones. Sus características avanzadas, rendimiento excepcional y disponibilidad de código abierto lo convierten en un recurso valioso para desarrolladores e investigadores por igual.

More information on Qwen2-VL

Qwen2-VL Alternativas

Más Alternativas-

-

Los modelos de lenguaje de la serie Qwen2.5 ofrecen capacidades mejoradas con conjuntos de datos más grandes, más conocimiento, mejores habilidades de codificación y matemáticas, y una alineación más cercana a las preferencias humanas. De código abierto y disponible a través de API.

-

Qwen2-Audio, este modelo integra dos funciones principales de diálogo de voz y análisis de audio, brindando a los usuarios una experiencia interactiva sin precedentes.

-

-

DeepSeek-VL2, un modelo de visión-lenguaje de DeepSeek-AI, procesa imágenes de alta resolución, ofrece respuestas rápidas con MLA y sobresale en diversas tareas visuales como VQA y OCR. Ideal para investigadores, desarrolladores y analistas de BI.