What is Baichuan-7B?

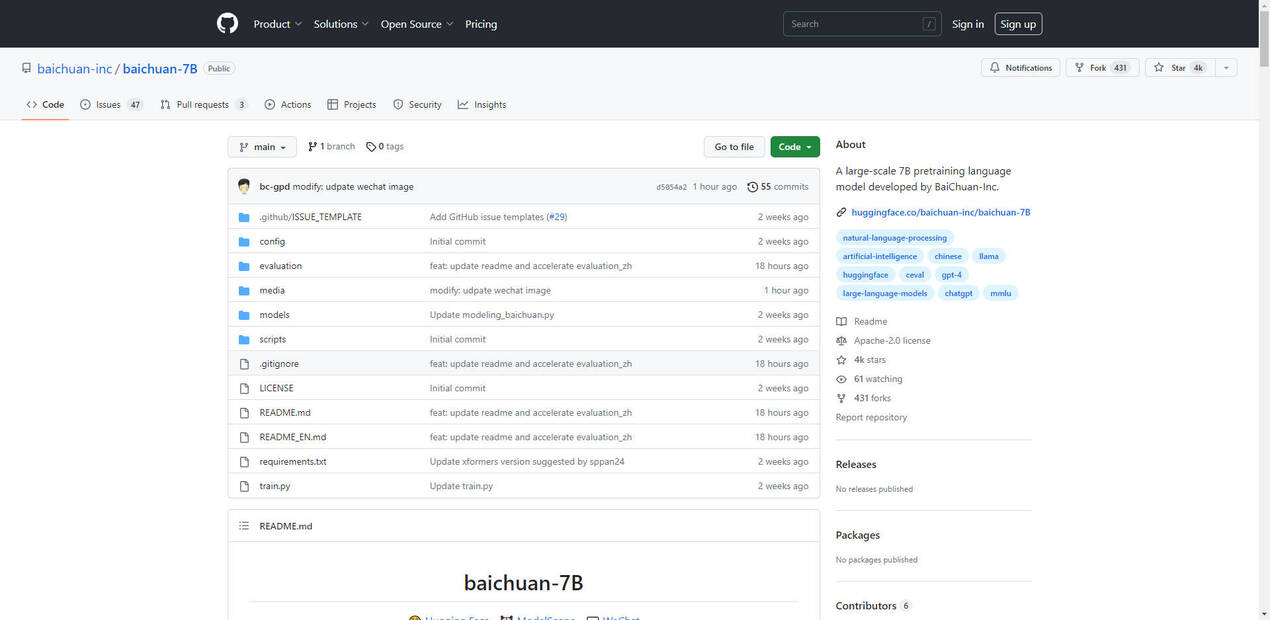

Baichuan-7B est un remarquable modèle pré-entraîné à grande échelle et en open-source développé par Baichuan Intelligent Technology. Basé sur l'architecture Transformer, ce modèle dispose de 7 milliards de paramètres entraînés sur environ 1,2 billion de jetons. Il est unique par ses capacités bilingues, prenant en charge à la fois le chinois et l'anglais, et par sa longueur impressionnante de fenêtre de contexte de 4096. Grâce à une évaluation rigoureuse sur les références chinoises standard (C-Eval) et anglaises (MMLU), Baichuan-7B a atteint des performances de pointe parmi les modèles de sa taille.

Caractéristiques principales :

- Prise en charge linguistique étendue : Baichuan-7B excelle dans le traitement du chinois et de l'anglais, démontrant de solides performances sur des critères spécifiques.

- Architecture de pointe : Tirant parti de l'architecture Transformer, Baichuan-7B offre des capacités remarquables de génération de texte, permettant des tâches telles que la synthèse, la traduction et l'écriture créative.

- Applicabilité polyvalente en aval : Baichuan-7B est bien adapté aux tâches en aval, notamment les réponses aux questions, la classification de texte et la génération de dialogues, ce qui en fait un outil polyvalent pour diverses applications de PNL.

Cas d'utilisation :

- Chatbots de service client : Baichuan-7B peut être utilisé pour créer des chatbots de service client sophistiqués qui fournissent une assistance efficace et personnalisée, améliorant ainsi la satisfaction du client.

- Traduction automatique : Les capacités bilingues de Baichuan-7B en font une option idéale pour la traduction en temps réel, éliminant les barrières linguistiques et facilitant la communication mondiale.

- Génération de contenu : Libérez la puissance de Baichuan-7B pour générer des descriptions de produits convaincantes, des textes marketing captivants et des publications engageantes sur les médias sociaux, stimulant ainsi l'engagement de la marque.

Conclusion :

Baichuan-7B se présente comme une réalisation révolutionnaire dans le domaine du traitement du langage naturel, repoussant les limites de la génération et de la compréhension de texte. Ses capacités bilingues, ses diverses applications en aval et ses performances impressionnantes en font un atout précieux pour les développeurs et les entreprises cherchant à améliorer leurs capacités de PNL. Alors que le domaine continue d'évoluer, Baichuan-7B est prêt à jouer un rôle central dans le façonnement de l'avenir de la communication homme-machine et à permettre de nouvelles applications qui exploitent la puissance du langage.

More information on Baichuan-7B

Baichuan-7B Alternatives

Plus Alternatives-

Hunyuan-MT-7B : Traduction automatique par IA open-source. Maîtrise plus de 33 langues avec une précision contextuelle et culturelle inégalée. Lauréat du WMT2025, léger et efficace.

-

-

Baichuan-M2 : Une IA médicale de pointe pour le raisonnement clinique en conditions réelles. Elle éclaire les diagnostics, optimise les résultats pour les patients et se déploie de manière privée sur un seul GPU.

-

-