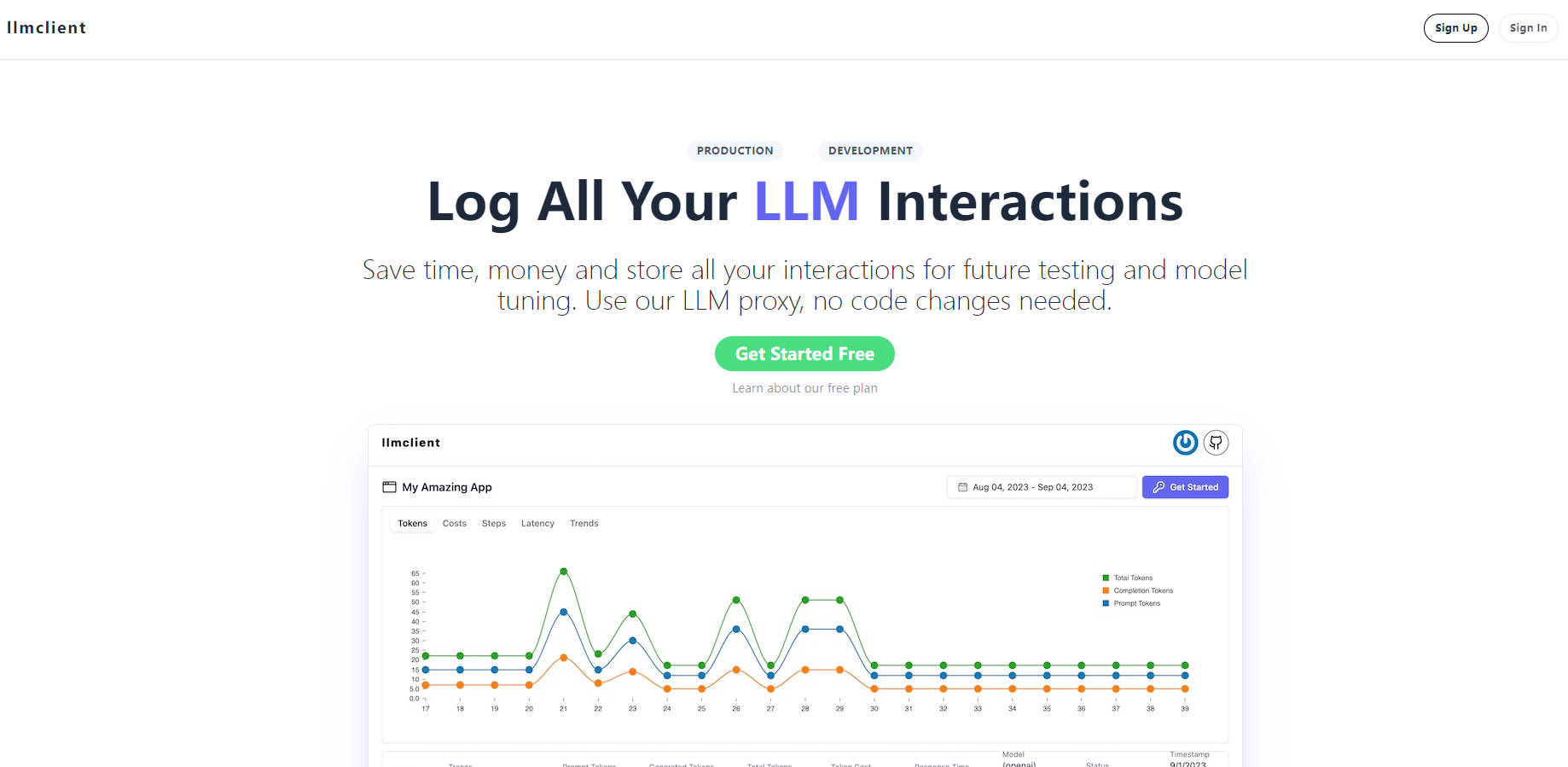

What is LLMClient?

Enregistrez toutes vos interactions avec LLM pour gagner du temps, de l'argent et stocker les interactions pour les tests futurs et le réglage du modèle.

Fonctionnalités clés :

Utilisez le proxy LLM fourni, aucune modification de code n'est nécessaire.

Effectuez le suivi des invites, des modèles, des réponses et partagez les journaux pour le débogage pendant le développement.

Surveillez les performances des invites, les coûts, l'activité des utilisateurs et les erreurs en production.

Utilisez le proxy hébergé hautement évolutif et rapide ou exécutez votre propre proxy open source.

Enregistrez chaque détail, y compris les invites d'achèvement, les invites du système, les invites de chat, les appels de fonctions, la configuration du modèle et les erreurs d'API.

More information on LLMClient

Top 5 Countries

Traffic Sources

LLMClient Alternatives

Plus Alternatives-

Optimisez votre application d'IA avec LLMonitor, une plateforme d'observabilité et de journalisation pour les applications basées sur LLM.

-

BenchLLM : évaluez les réponses LLM, créez des suites de test, automatisez les évaluations. Améliorez les systèmes pilotés par IA grâce à des évaluations complètes des performances.

-

Révolutionnez le développement LLM avec LLM-X ! Intégrez des modèles de langage volumineux en toute transparence dans votre workflow grâce à une API sécurisée. Optimisez la productivité et libérez la puissance des modèles de langage pour vos projets.

-

Intégrez des modèles linguistiques volumineux comme ChatGPT avec des applications React en utilisant useLLM. Diffusez des messages et concevez des invites pour des fonctionnalités optimisées par l'IA.

-

Une plateforme de bout en bout permettant aux équipes d'obtenir des informations sur leurs applications LLM post-production