What is LLMClient?

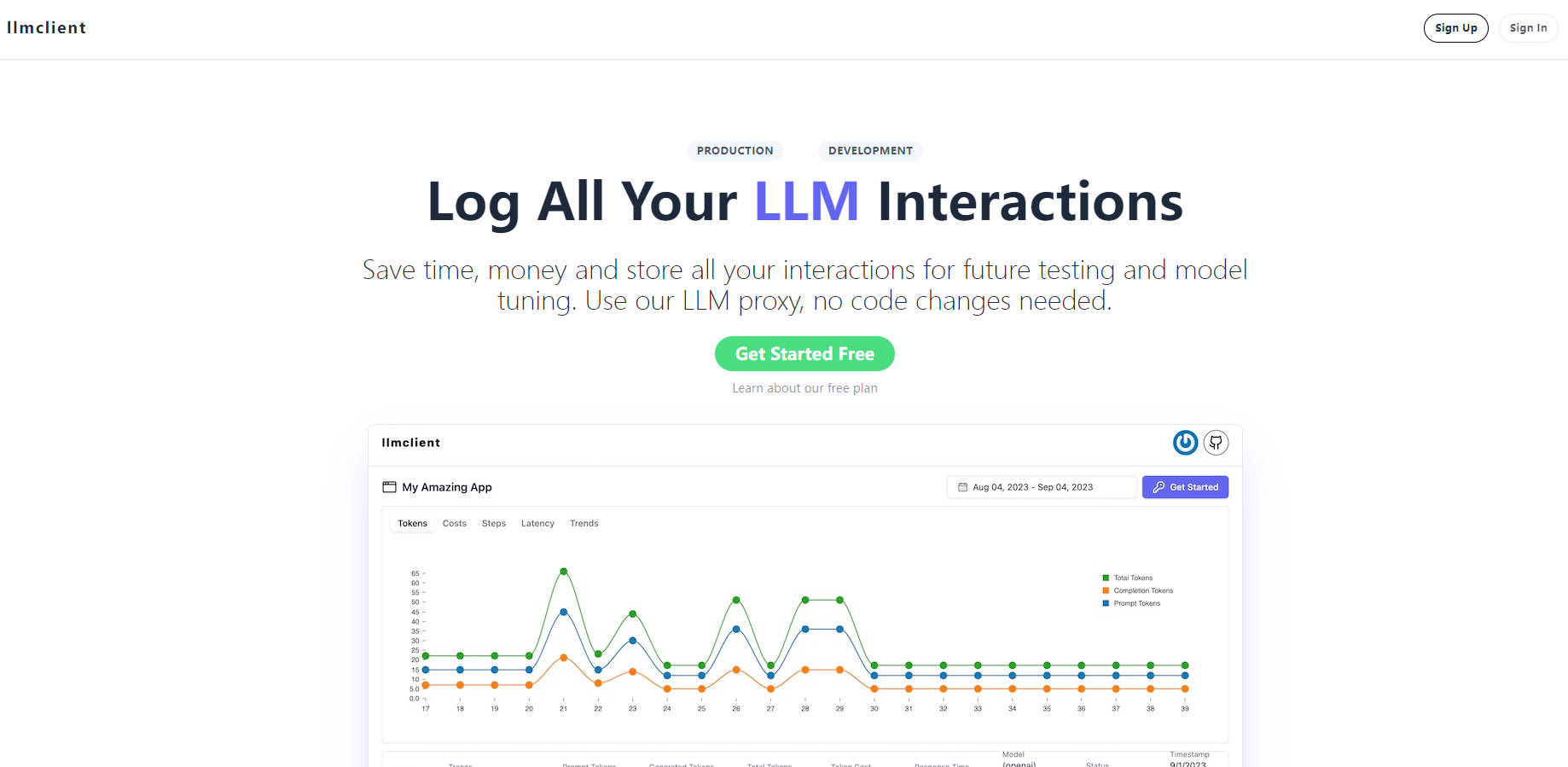

Запишите все взаимодействия с LLM, чтобы сэкономить время и деньги и сохранить взаимодействия для будущего тестирования и настройки модели.

Ключевые особенности:

Используйте предоставленный прокси-сервер LLM, не требуется никаких изменений в коде.

Отслеживайте подсказки, модели, ответы и обменивайтесь журналами для отладки во время разработки.

Отслеживайте эффективность подсказок, затраты, действия пользователей и ошибки в процессе производства.

Используйте высокомасштабируемый и быстрый размещенный прокси-сервер или запустите свой собственный прокси-сервер с открытым исходным кодом.

Регистрируйте каждую деталь, включая подсказки завершения, системные подсказки, подсказки чата, вызовы функций, конфигурацию модели и ошибки API.

More information on LLMClient

Top 5 Countries

Traffic Sources

LLMClient Альтернативи

Больше Альтернативи-

Оптимизируйте свое ИИ-приложение с помощью LLMonitor, платформой для наблюдения и ведения журнала для приложений на базе LLM.

-

BenchLLM: оценка ответов LLM, создание наборов тестов, автоматизация оценок. Усовершенствование систем на базе ИИ с помощью комплексной оценки эффективности.

-

Революционизируйте разработку LLM с помощью LLM-X! Интегрируйте большие языковые модели в ваш рабочий процесс с помощью безопасного API. Повысьте продуктивность и раскройте возможности языковых моделей для ваших проектов.

-

Встраивайте крупные языковых модели, такие как ChatGPT, в приложения React с помощью useLLM. Передавайте сообщения потоком и проектируйте для управляемых ИИ функций.

-

Платформа полного цикла, позволяющая командам получать информацию о своих приложениях LLM после выпуска