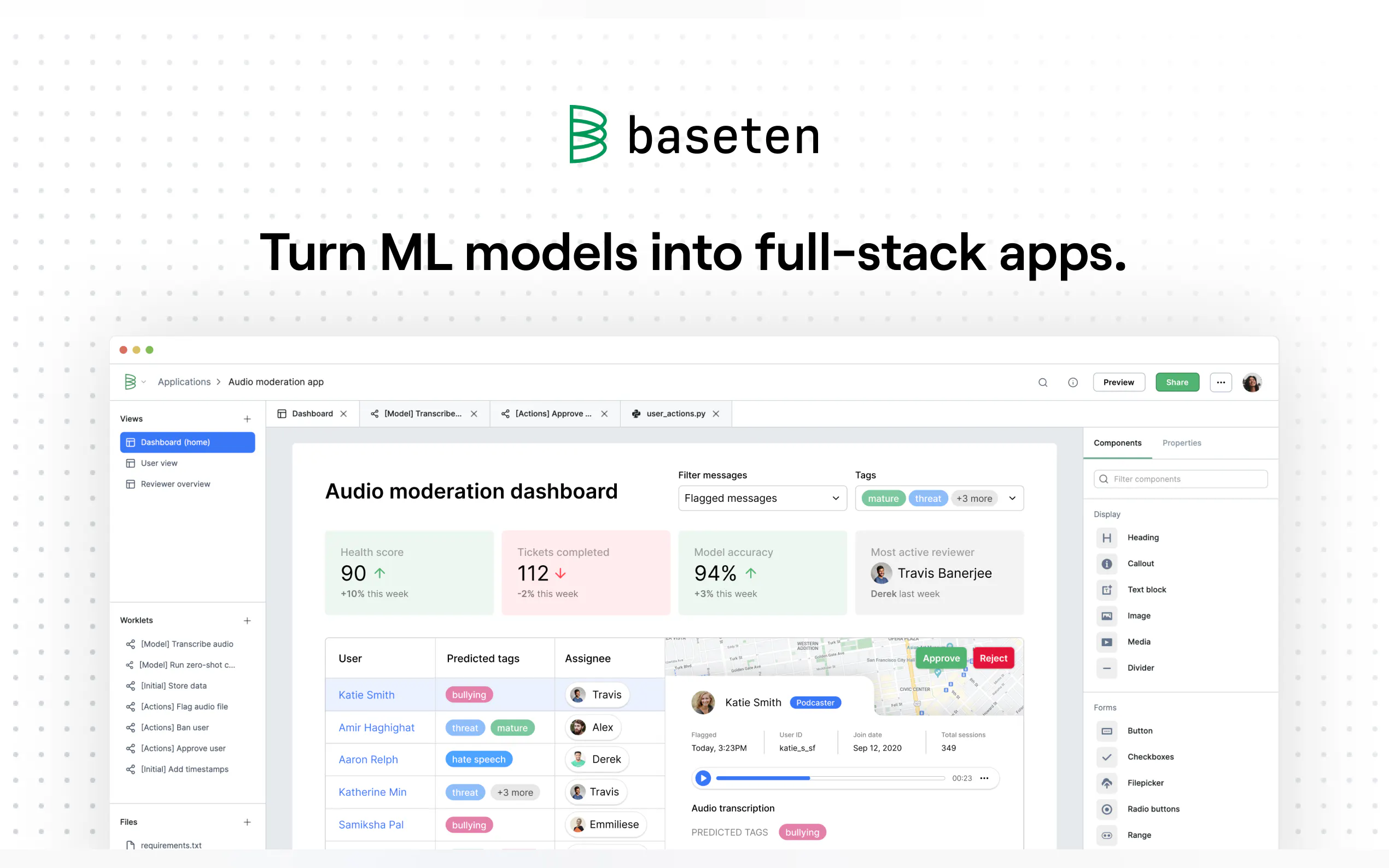

What is Baseten?

AIモデルの運用が、これまで以上に容易になりました。Basetenは、オープンソースモデルとカスタムモデルの両方を、お客様のクラウドでも、Basetenのクラウドでも、高速でスケーラブルかつ信頼性の高いプラットフォームで提供します。パフォーマンス、セキュリティ、シームレスなワークフローを重視する開発者や企業向けに設計されたBasetenは、AI推論を安心してスケールアップできます。

主な機能

? 高性能推論

毎秒最大1,500トークン、ミッションクリティカルなアプリケーション向けに最適化されたコールドスタートにより、驚異的な速度を実現します。Basetenのインフラストラクチャは低遅延を保証し、チャットボットやバーチャルアシスタントなどのリアルタイムユースケースに最適です。

?️ 開発者フレンドリーなワークフロー

BasetenのオープンソースモデルパッケージングツールであるTrussを使用すると、わずか数コマンドでモデルをデプロイできます。PyTorch、TensorFlow、Tritonのいずれを使用している場合でも、Trussは開発から運用への移行を簡素化します。

? エンタープライズ対応のセキュリティ

Basetenは、HIPAAコンプライアンスとSOC 2 Type II認証を取得しており、エンタープライズニーズの最高水準を満たしています。単一テナント分離により、お客様のクラウドまたはセルフホスト型ソリューションとして安全にデプロイできます。

? 容易な自動スケーリング

トラフィックの急増に対応するためにモデルを自動的にスケールアップし、計算コストの過払いを防ぎます。Basetenのオートスケーラーは最適なリソース割り当てを保証するため、モデルは常に利用可能でコスト効率に優れています。

? 包括的な可観測性

詳細なログ、メトリクス、コスト追跡ツールを使用して、モデルをリアルタイムで監視します。問題を迅速に特定して解決し、信頼性とパフォーマンスを維持します。

ユースケース

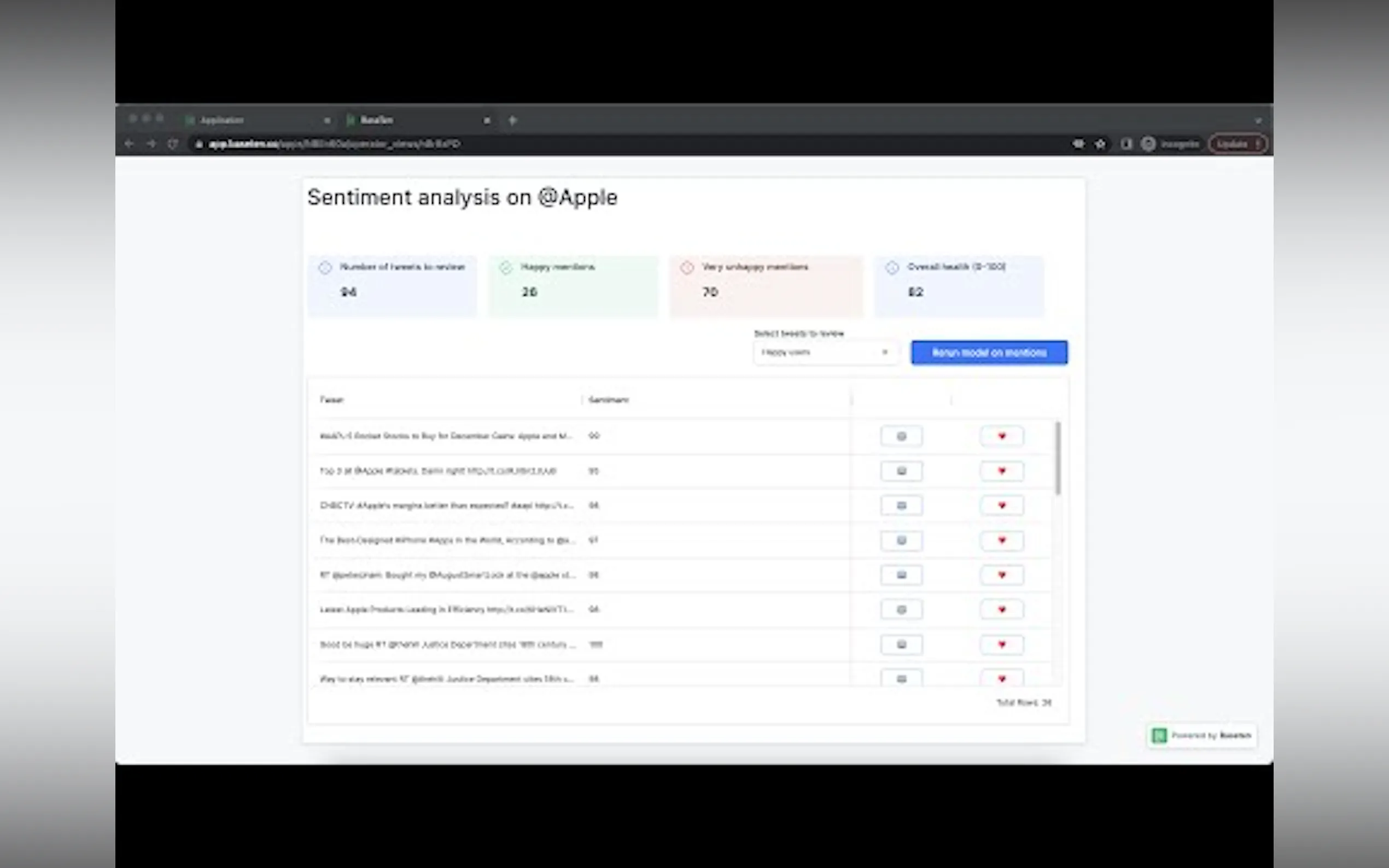

インタラクティブアプリケーション

Basetenの低遅延推論と自動スケーリング機能により、チャットボット、バーチャルアシスタント、翻訳サービスなどのリアルタイムエクスペリエンスを実現します。エンタープライズAIソリューション

重要なビジネス運用のために、HIPAAやSOC 2などの業界標準への準拠を確保した、安全で高性能なモデルをデプロイします。マルチモデルワークフロー

Basetenの直感的なプラットフォーム内で管理される複数のモデルをチェーン接続することにより、複雑なAIワークフローを構築およびオーケストレーションします。

Basetenを選ぶ理由

Basetenは、最先端のパフォーマンス、開発者フレンドリーなツール、エンタープライズグレードのセキュリティを組み合わせることで、AIモデルのデプロイをシームレスにします。お客様のクラウドでもBasetenのクラウドでも推論をスケールアップする場合、Basetenはモデルを高速、信頼性が高く、費用対効果の高いものにします。

AIデプロイメントを加速させる準備はできましたか?今すぐ開始するか、営業チームにご連絡して詳細をご覧ください。