What is Omnilingual ASR?

Omnilingual ASRは、MetaのFundamental AI Research (FAIR) チームによって開発された、最先端のオープンソース自動音声認識システムです。この包括的なモデルスイートは、これまでのASR技術ではカバーされなかった数百もの言語を含む1,600以上の言語をサポートすることで、世界的な言語の包括性という重要な課題に対応します。世界中の研究者、開発者、そして多様な言語コミュニティ向けに設計された Omnilingual ASR は、高品質で適応性の高い音声からテキストへの変換(文字起こし)を、かつてない規模で実現します。

主な機能

Omnilingual ASR は、高度なアーキテクチャ設計を活用し、スケールアップされた wav2vec 2.0 音声エンコーダーとLLMスタイルのデコーダーを組み合わせることで、強力かつ柔軟な音声ソリューションを提供します。

🌍 多様な言語への対応

本システムは1,600以上の世界中の言語をサポートし、音声技術の適用範囲を大幅に拡大します。特に、これまでASRの対応が不足していた500以上の低リソース言語のサポートを含んでおり、これにより、十分にサービスが行き届いていないコミュニティや言語研究にとって不可欠な文字起こし機能が開かれます。

🚀 ゼロショット学習による容易な言語拡張

新しい言語に対して大規模でコストのかかるデータセットを必要とする従来のASRシステムとは異なり、Omnilingual ASR は、LLMから派生したスケーラブルなゼロショット学習とインコンテキスト能力を活用します。これにより、少数の音声とテキストのペアの例を使用するだけで、システムを全く新しい言語や方言に拡張でき、専門知識や高性能な計算リソースに関する参入障壁を劇的に低減します。

✨ 最先端のパフォーマンスを大規模に実現

強力な 7B-LLM-ASR モデルは、その膨大な言語ポートフォリオ全体で最高水準の精度を達成しています。サポートされている1,600以上の言語のうち78%で、システムは文字誤り率 (CER) を10未満に維持しており、これは、特にロングテール言語や低リソース言語において、パフォーマンスの大幅な向上を意味します。

⚙️ 多機能でスケーラブルなモデルファミリー

Omnilingual ASR は、多様な展開ニーズに合わせて調整された柔軟なモデルスイートを提供します。低消費電力デバイスでの効率的な利用のために設計された軽量な300Mバージョンから、要求の厳しい、重要度の高いユースケースで最高の精度を提供する強力な7Bモデルまで、選択可能です。

ユースケース

Omnilingual ASR は、研究者、開発者、言語擁護者がより包括的で機能的な音声対応アプリケーションを構築できるよう支援します。

1. 低リソース言語データの保存と分析 地域コミュニティや言語研究者は Omnilingual ASR を利用して、既存のAIによるカバーがない低リソース言語の歴史的または新たに録音された音声を文字起こしできます。この機能は、検索可能で共有可能なテキストコーパスの作成を促進し、言語の保存と高度な学術分析に貢献します。

2. クロスプラットフォームの多言語アプリケーション開発 開発者はこのモデルスイートを統合して、特定のハードウェア制約に合わせたASRソリューションを展開できます。例えば、軽量な300Mモデルはモバイルまたは組み込みシステム向けの正確なオンデバイス文字起こしを可能にし、一方、7Bモデルは数百の言語を同時にサポートする高精度なサーバーサイド文字起こしサービスを強化できます。

3. 音声技術研究の加速 研究者は、付随する Omnilingual ASR Corpus —これまでに公開された中で最大の超低リソースの自発的ASRデータセット—と、包括的なトレーニングレシピ、そして基盤となる Omnilingual wav2vec 2.0 モデルを活用できます。これにより、標準的なASRを超えた音声関連タスクの迅速な実験、ファインチューニング、および進歩が可能になります。

独自の利点

Omnilingual ASR は、自動音声認識技術のアクセシビリティとスケーラビリティを根本的に再定義することで際立っています。

- 前例のないロングテール言語への対応: Omnilingual ASR は、AIでこれまでカバーされなかった500以上の言語を初めて成功裏に文字起こしした大規模ASRシステムであり、音声技術を真にグローバルで包括的なものにします。

- 容易な拡張性: このフレームワークは、最小限のデータと専門知識なしで、全く新しい言語に拡張できるように独自に設計されています。LLMからのインコンテキスト学習を活用することで、大規模な独自トレーニングセットや専門的な高性能コンピューティングリソースといった一般的な要件を回避できます。

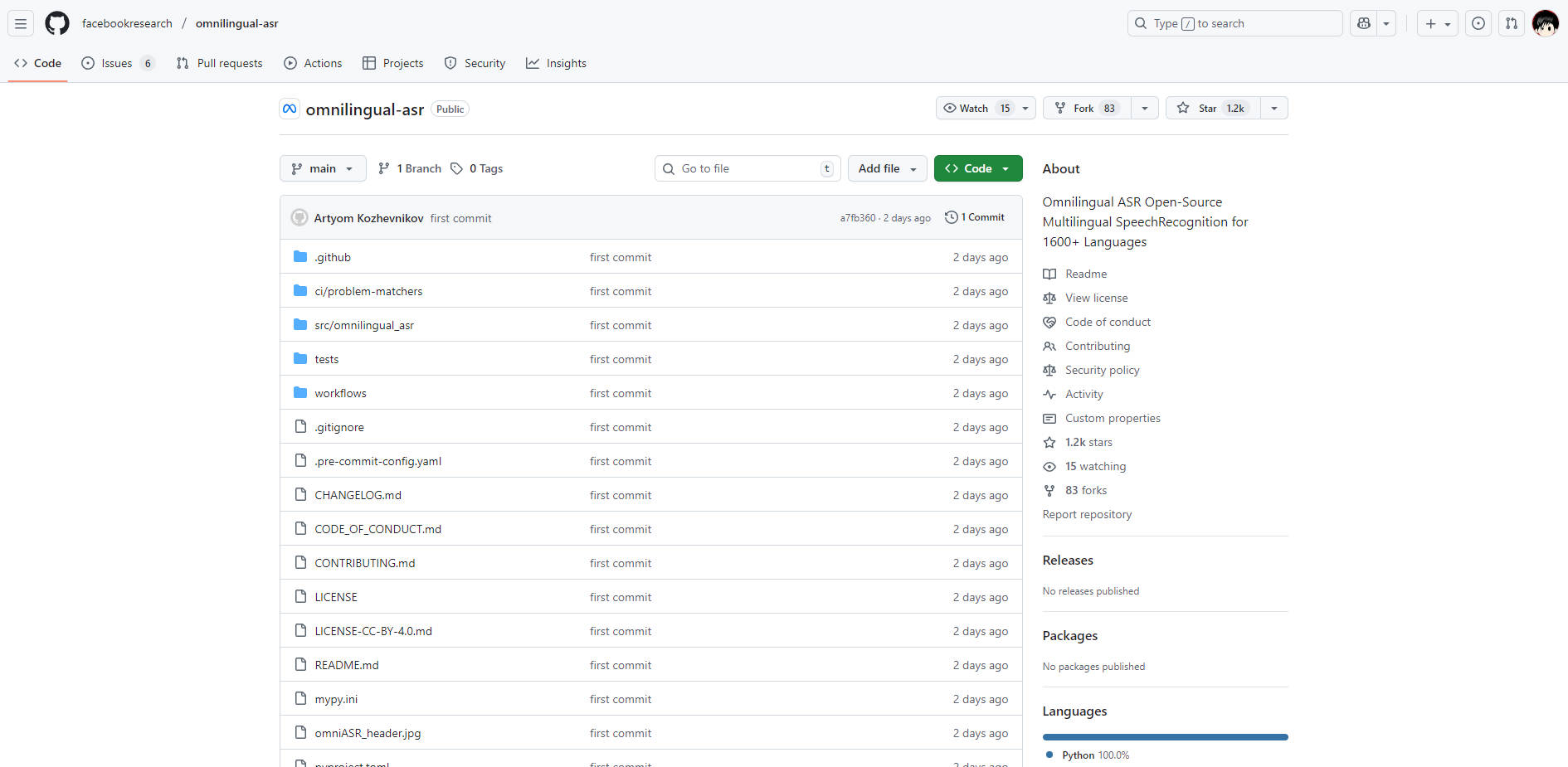

- オープンソース基盤: MetaのFAIRチームによって寛容な Apache 2.0 ライセンスの下でリリースされ、システム全体がコミュニティでの採用のために設計されています。PyTorchエコシステムと fairseq2 を基盤とするこのオープンアーキテクチャは、世界中の開発者にとって最大限の透明性、コラボレーション、そして統合の柔軟性を保証します。

結論

Omnilingual ASR は、世界中のあらゆる言語コミュニティに正確な音声認識をもたらすために必要なパフォーマンスと適応性を提供します。最先端の精度、比類のない言語規模、そしてオープンソースフレームワークを組み合わせることで、次世代の包括的な音声技術のための強力な基盤を提供します。

Omnilingual ASR があなたの研究を拡大したり、これまで取り残されてきた言語向けの音声ソリューションを展開したりするのにどのように役立つかを探ってみましょう。

よくある質問

Q: Omnilingual ASR と以前の大規模ASRシステムとの主な違いは何ですか? A: 主な違いは、カバー範囲の広さと拡張方法です。以前のシステムが高リソース言語に重点を置いていたのに対し、Omnilingual ASR は1,600以上の言語をカバーし、特に数百の低リソース言語を含んでいます。さらに、インコンテキスト学習機能が導入されており、開発者はわずか数組のペアの例で新しい言語のサポートを追加でき、大規模なデータ収集や費用のかかる再トレーニングの必要がなくなります。

Q: Omnilingual ASR のライセンス体系はどうなっていますか? A: Omnilingual ASR は完全なオープンソースです。モデルアセットは寛容な Apache 2.0 ライセンスの下でリリースされ、関連データ(Omnilingual ASR Corpus など)は CC-BY ライセンスの下で提供されます。このオープンライセンスは、幅広い採用とコミュニティへの貢献を促進します。

Q: 音声入力に関する現在の制限はありますか? A: 現在、推論パイプラインは短いセグメント向けに最適化されており、40秒未満の音声ファイルを受け入れます。これは多くの標準的なユースケースをカバーしますが、チームは、長時間の録音に対応するため、将来のアップデートで無制限の長さの音声ファイルの文字起こしサポートを積極的に開発しています。