What is Inferless?

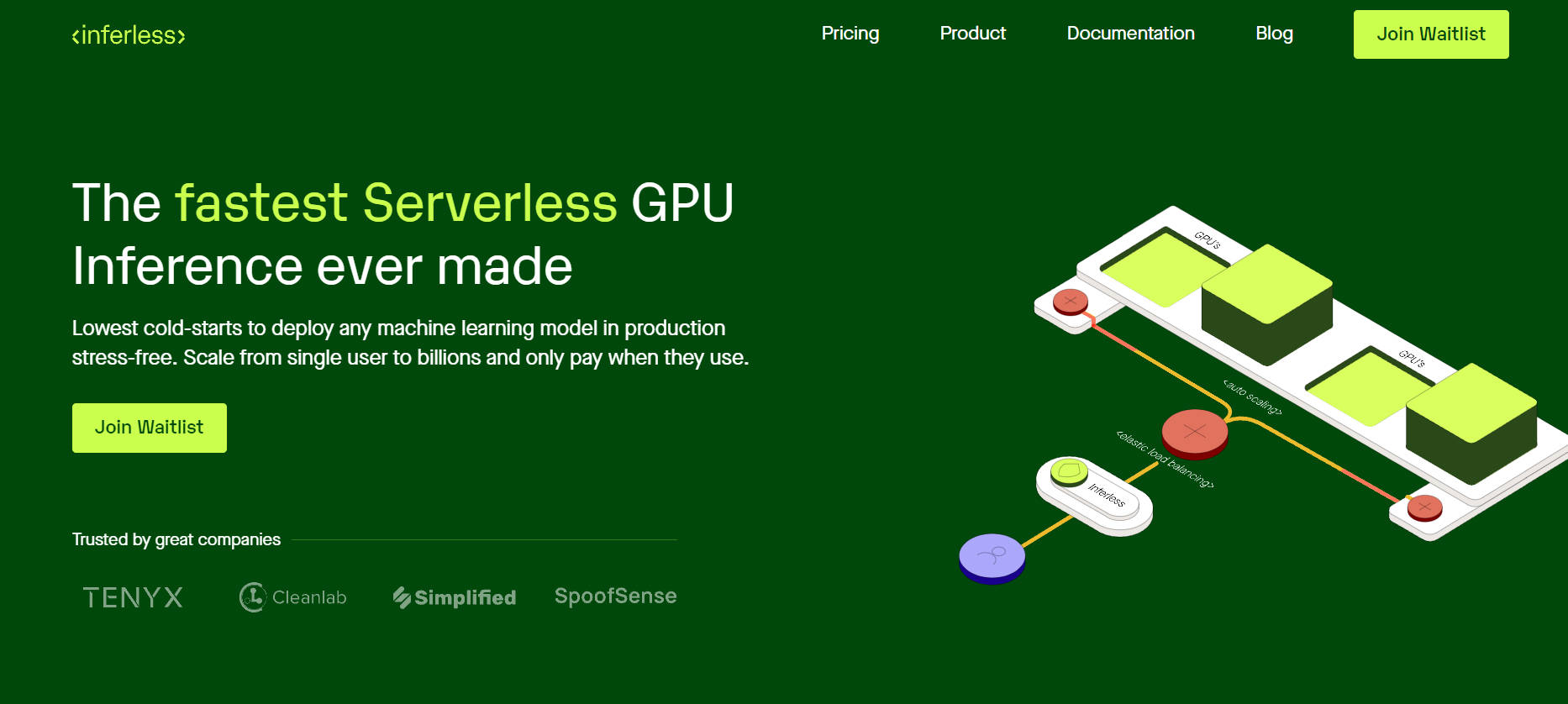

Inferless는 클라우드 기반 머신 러닝 환경을 혁신하여 타의 추종을 불허하는 속도와 확장성을 제공합니다. 프로덕션 워크로드를 위해 설계된 이 플랫폼은 모델 파일에서 엔드포인트까지 배포 시간을 단 몇 분으로 단축하며, 자체 개발한 부하 분산기를 통해 예측 불가능한 워크로드에도 원활하게 확장하거나 축소할 수 있습니다. 사용량에 따라 요금이 청구되는 방식으로, Inferless는 개인 개발자부터 글로벌 기업까지 모든 규모의 비즈니스에 최적화된 비용을 제공합니다.

주요 기능:

탁월한 속도를 제공하는 서버리스 GPU 추론: Inferless는 가장 빠른 추론 시간을 제공하여 콜드 스타트의 번거로움 없이 프로덕션 환경에 머신 러닝 모델을 신속하게 배포합니다.

원활한 확장: 단일 사용자부터 대규모 사용자 기반까지, 플랫폼의 확장 기능은 0에서 수백 개의 GPU로 즉시 확장하여 변동하는 수요에 적응합니다.

사용자 지정 런타임 및 볼륨 지원: 필요한 소프트웨어와 종속성을 포함하도록 컨테이너를 맞춤 설정합니다. 동시 데이터 액세스 및 복제를 위해 NFS와 유사한 쓰기 가능 볼륨을 활용합니다.

자동 CI/CD 및 모니터링: 모델에 대한 자동 재빌드를 통해 수동 재임포트를 제거합니다. 모델의 효율적인 모니터링 및 최적화를 위해 상세한 호출 및 빌드 로그에 액세스합니다.

동적 배치 및 사용자 지정 엔드포인트: 서버 측 요청 결합을 활성화하여 처리량을 향상시킵니다. 테스트, 동시성, 시간 제한 등을 위해 엔드포인트를 맞춤 설정합니다.

사용 사례:

헬스케어 스타트업은 전염병 중에 예측 진단 알고리즘을 원활하게 확장하여 인프라 문제 없이 갑작스러운 환자 증가를 처리합니다.

전자 상거래 회사는 주문형으로 맞춤형 추천 모델을 배포하여 연휴 시즌 동안 트래픽 피크에 동적으로 적응합니다.

선도적인 기술 회사는 새로운 도구에 Inferless를 사용하여 GPU 클라우드 비용을 90% 절감하여 고부하 기간 동안 고정 비용을 크게 절감하고 콜드 스타트 지연을 방지합니다.

결론:

Inferless는 ML 모델을 효과적이고 확장 가능하며 비용 효율적으로 배포하기 위한 원스톱 솔루션입니다. 당사 플랫폼을 통해 새로운 가능성을 열어낸 통찰력 있는 기업의 대열에 합류하세요. AI 인프라를 혁신할 준비가 되셨습니까? 지금 등록하여 머신 러닝의 미래를 경험하세요.