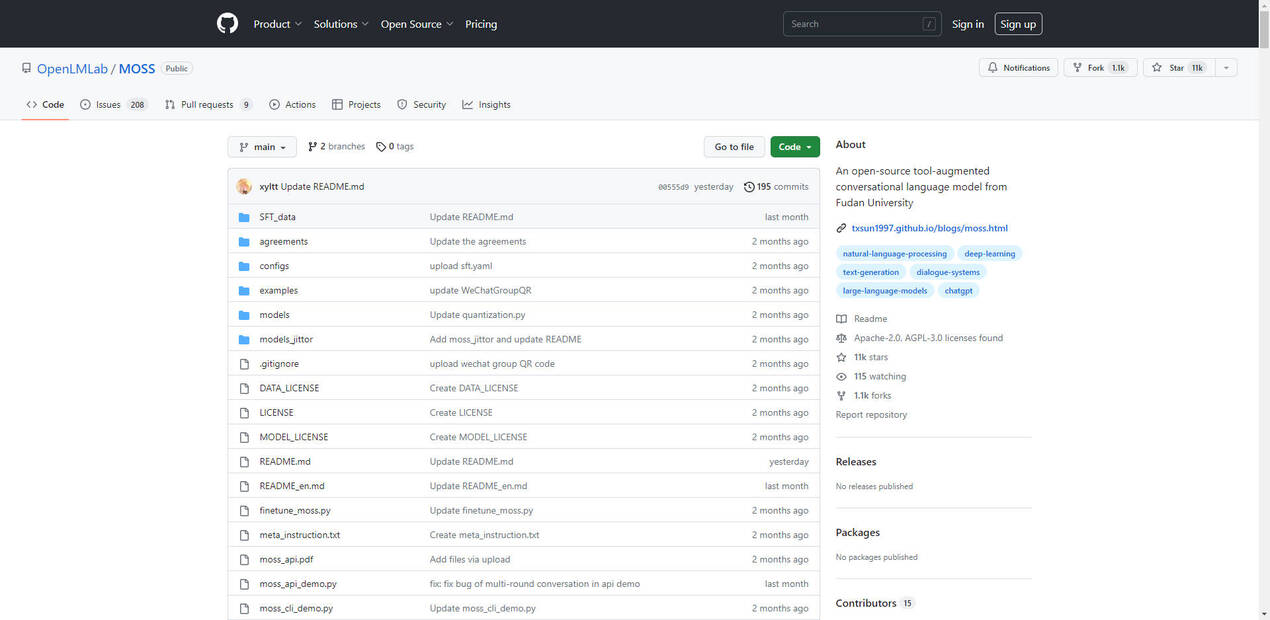

What is MOSS?

MOSS는 복단대학교에서 개발한 최첨단 오픈소스 대화형 언어 모델입니다. 영어와 중국어 모두 뛰어난 성능을 자랑하며, 기능을 향상시키는 다양한 플러그인 생태계를 갖추고 있습니다. 무려 1600억 개의 매개변수를 가진 MOSS-Moon 시리즈 모델(moss-moon-003-sft와 같은)은 단일 A100/A800 또는 듀얼 3090 GPU에서도 뛰어난 성능을 발휘하도록 설계되었으며, INT4/8과 같은 낮은 정밀도로 단일 3090 GPU에서 실행될 수 있습니다.

주요 기능

이중 언어 기능: ? MOSS는 영어와 중국어 모두 뛰어나 언어 장벽을 넘어 매끄러운 의사소통을 가능하게 합니다.

광범위한 플러그인 지원: ? MOSS는 다양한 플러그인과 원활하게 통합되어 웹 검색, 계산, 이미지 생성 등 기능을 확장합니다.

효율적인 리소스 사용: ? MOSS는 방대한 매개변수 크기에도 불구하고 효율적인 리소스 사용을 위해 최적화되어 고성능 하드웨어에서도 원활하게 작동합니다.

안전성 및 신뢰성: ?️ MOSS는 사실 오류나 편향된 콘텐츠 생성에 대한 제한 사항을 인식하며 안전을 염두에 두고 설계되었습니다.

맞춤화 및 확장 가능성: ? MOSS는 다양한 용도에 맞게 쉽게 맞춤화 및 확장할 수 있어 다양한 애플리케이션에 유용한 도구입니다.

More information on MOSS

Launched

2023

Pricing Model

Free

Starting Price

Global Rank

Follow

Month Visit

<5k

Tech used