What is MOSS?

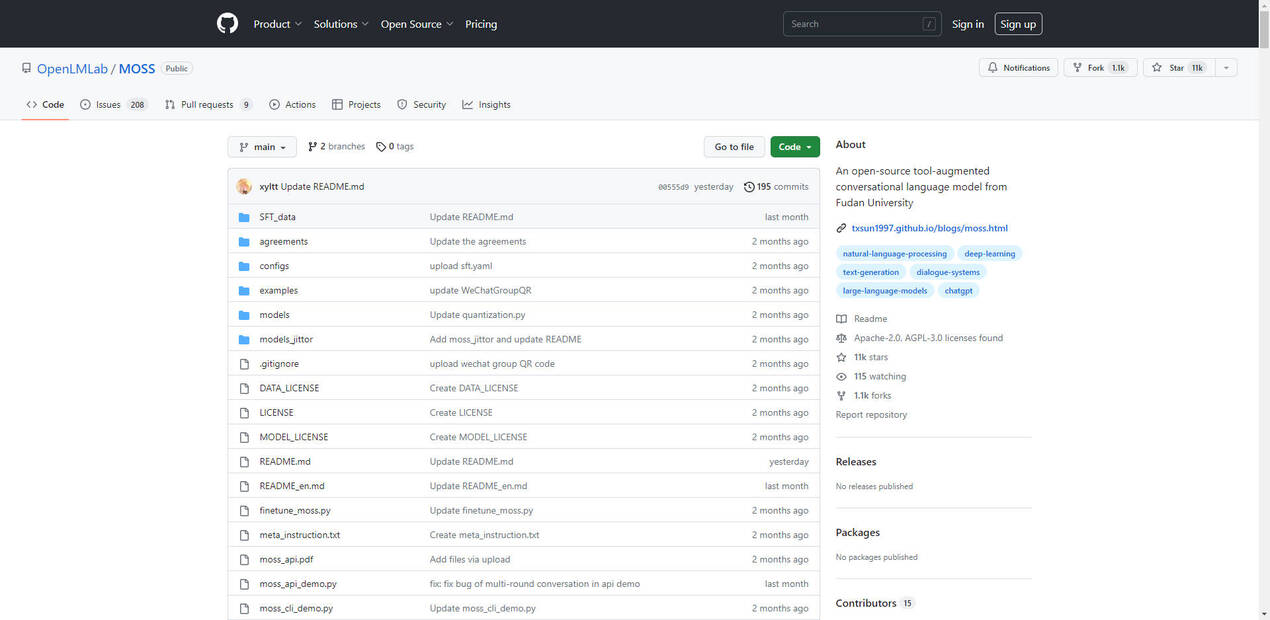

MOSS es un modelo de lenguaje conversacional avanzado de código abierto desarrollado por la Universidad de Fudan. Destaca por sus excepcionales capacidades tanto en inglés como en chino, junto con un rico ecosistema de plugins que mejoran su funcionalidad. Con la friolera de 160 mil millones de parámetros, los modelos de la serie MOSS-Moon, como moss-moon-003-sft, están diseñados para funcionar de manera impresionante incluso en una sola GPU A100/A800 o dos GPUs 3090, y con menor precisión, como INT4/8, puede ejecutarse en una sola GPU 3090.

Características Clave

Capacidad Bilingüe: ? MOSS sobresale tanto en inglés como en chino, facilitando la comunicación fluida a través de las fronteras lingüísticas.

Amplio Soporte de Plugins: ? MOSS se integra perfectamente con una variedad de plugins, ampliando sus capacidades para incluir la búsqueda web, el cálculo, la generación de imágenes y más.

Uso Eficiente de Recursos: ? A pesar de su enorme tamaño de parámetros, MOSS está optimizado para un uso eficiente de los recursos, garantizando un funcionamiento fluido incluso en hardware de gama alta.

Seguridad y Fiabilidad: ?️ MOSS está diseñado teniendo en cuenta la seguridad, reconociendo sus limitaciones en la generación de errores fácticos o contenido sesgado.

Personalizable y Escalable: ? MOSS se puede personalizar y escalar fácilmente para diferentes casos de uso, lo que lo convierte en una herramienta versátil para diversas aplicaciones.