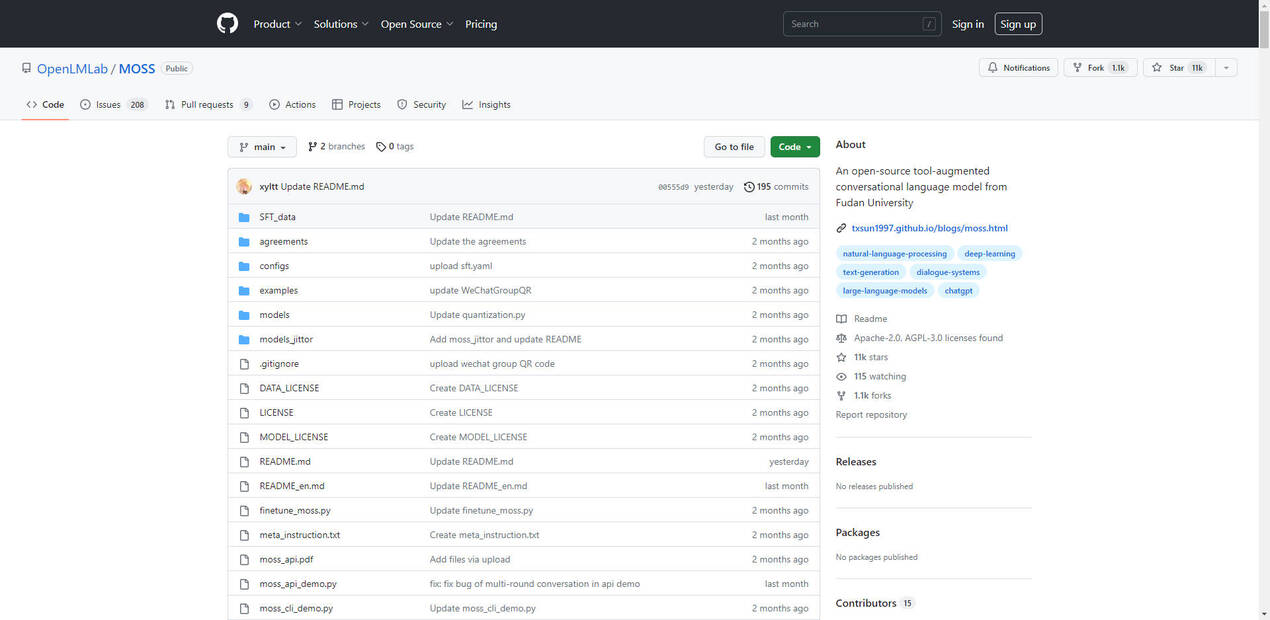

What is MOSS?

MOSS 是由复旦大学开发的先进开源对话语言模型。它以其在英语和中文方面的出色能力以及丰富的插件生态系统脱颖而出,增强了其功能。拥有高达 1600 亿个参数的 MOSS-Moon 系列模型,如 moss-moon-003-sft,旨在即使在单个 A100/A800 或双 3090 GPU 上也能出色地执行,并且在较低精度(如 INT4/8)下,它可以在单个 3090 GPU 上运行。

主要特点

双语能力:? MOSS 在英语和中文方面都表现出色,促进跨语言界限的无缝沟通。

广泛的插件支持:? MOSS 与各种插件无缝集成,扩展其功能以包括网络搜索、计算、图像生成等。

高效的资源利用:? 尽管参数规模庞大,但 MOSS 针对高效的资源利用进行了优化,确保即使在高端硬件上也能平稳运行。

安全性和可靠性:?️ MOSS 以安全为设计理念,承认其在生成事实性错误或有偏见内容方面的局限性。

可定制性和可扩展性:? MOSS 可以轻松定制和扩展以适应不同的用例,使其成为各种应用的多功能工具。

More information on MOSS

Launched

2023

Pricing Model

Free

Starting Price

Global Rank

Follow

Month Visit

<5k

Tech used