What is NeMo Guardrails?

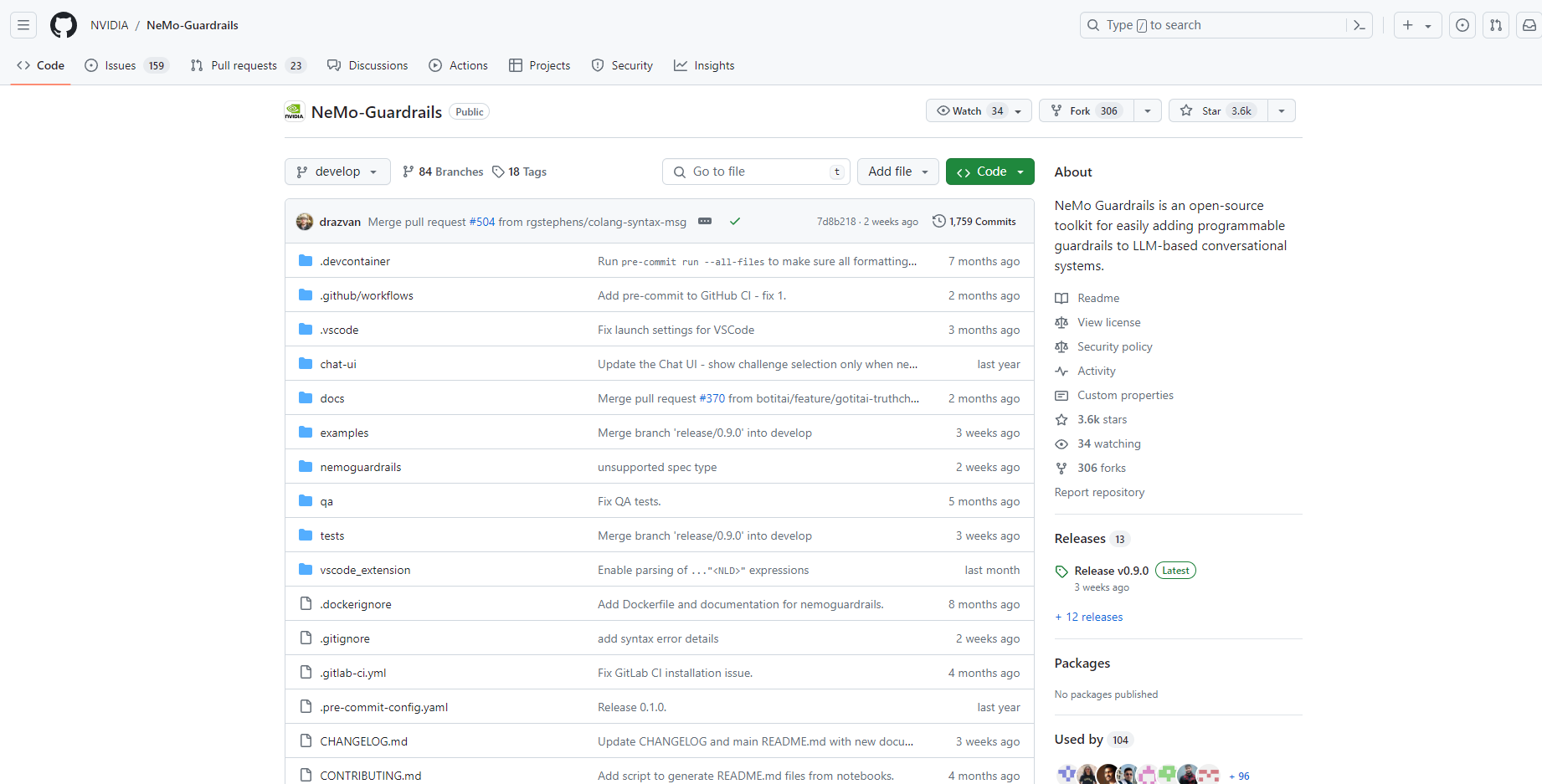

NeMo Guardrails는 대규모 언어 모델(LLM) 기반 대화형 애플리케이션에 프로그래밍 가능한 안전장치를 추가하도록 설계된 혁신적인 오픈소스 툴킷입니다. 개발자는 NeMo Guardrails를 통해 LLM 출력을 제어하고 안내하여 더 안전하고 안정적인 상호 작용을 보장할 수 있습니다. 다양한 LLM과 안전장치 유형을 지원하는 NeMo Guardrails는 사용자가 응답성이 뛰어나고 안전한 애플리케이션을 만들 수 있도록 지원합니다.

주요 기능:

? 사용자 지정 가능한 안전장치: 특정 주제를 피하거나 미리 정의된 대화 경로를 따르는 등 LLM의 동작에 대한 특정 규칙을 정의합니다.

? 원활한 통합: LLM을 다른 서비스 및 도구와 안전하게 연결하여 애플리케이션 기능을 향상시킵니다.

?️ 제어 가능한 대화: 미리 정의된 흐름으로 대화를 유도하여 대화 디자인 모범 사례 준수를 보장합니다.

?️ 취약점 보호: 탈옥 및 프롬프트 주입과 같은 일반적인 LLM 취약점으로부터 보호하는 메커니즘을 구현합니다.

? 언어 지원: OpenAI GPT-3.5, GPT-4, LLaMa-2, Falcon, Vicuna 및 Mosaic를 포함한 다양한 LLM과 호환됩니다.

사용 사례:

? 검색 증강 생성: 질문 답변 시스템에서 사실 확인 및 조정을 강제합니다.

? 도메인별 어시스턴트: 챗봇이 주제에 맞게 유지되고 설계된 대화 흐름을 따르도록 합니다.

?️ LLM 엔드포인트: 사용자와의 더 안전한 상호 작용을 위해 사용자 지정 LLM에 안전장치를 추가합니다.

?️ LangChain 체인: 강화된 제어 및 보안을 위해 LangChain에 안전장치를 통합합니다.