What is JetMoE-8B?

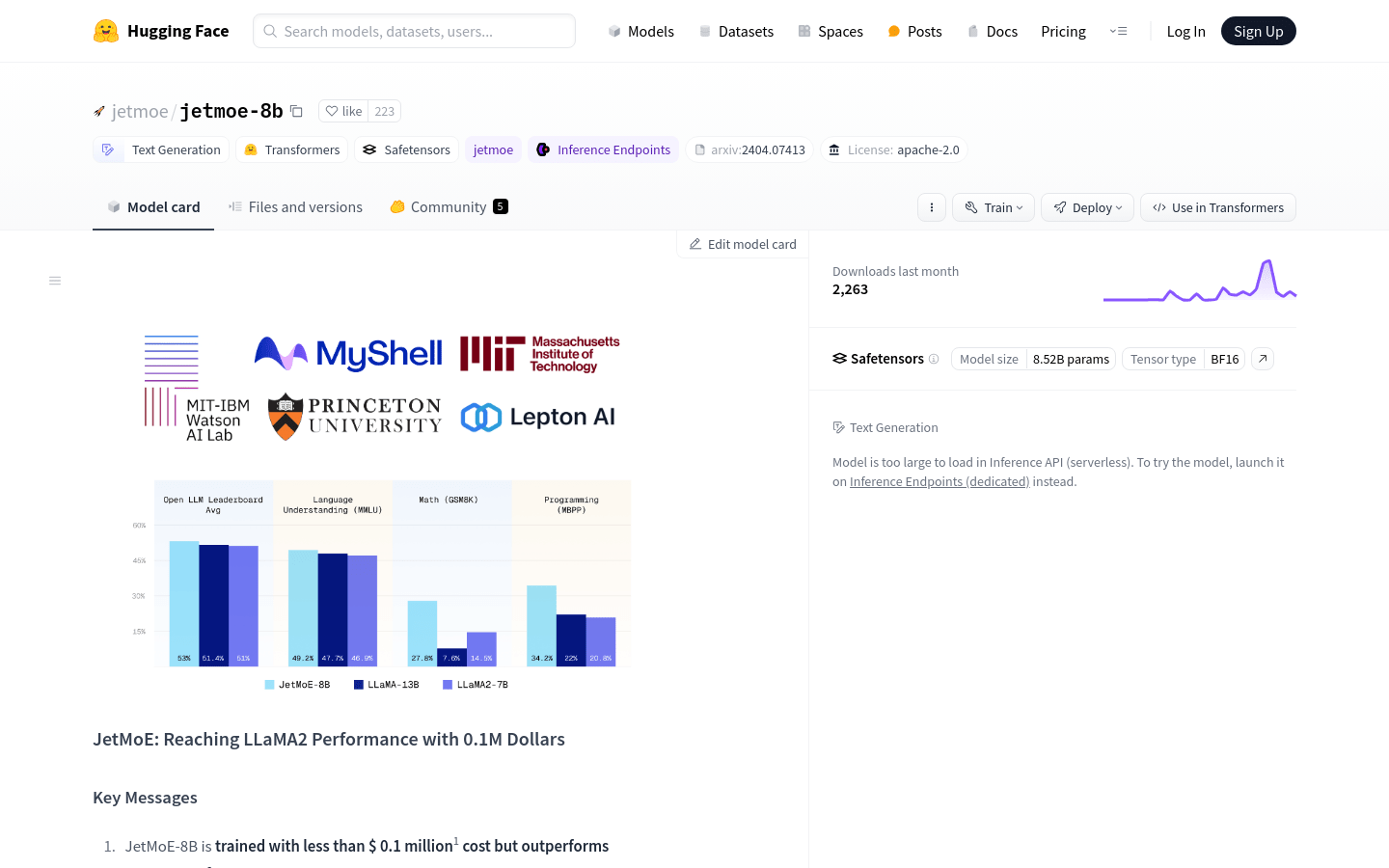

JetMoE-8B, разработанная Yikang Shen, Zhen Guo, Tianle Cai и Zengyi Qin — это модель искусственного интеллекта с открытым исходным кодом, удобная для академического сообщества, которая обучается с минимальными затратами. Несмотря на скромный бюджет обучения менее 0,1 млн долларов, JetMoE-8B превосходит многомиллиардные модели, такие как LLaMA2-7B. Используя только общедоступные наборы данных и доступные вычислительные ресурсы, JetMoE-8B устанавливает новый стандарт для экономичных и высокопроизводительных языковых моделей.

Ключевые особенности:

?? Доступное обучение: обученная всего за 0,1 млн долларов на потребительском графическом процессоре, JetMoE-8B демонстрирует экономичную разработку ИИ без ущерба для качества.

? Высокая производительность: с 2,2 миллиарда активных параметров во время вывода JetMoE-8B обеспечивает превосходную производительность по сравнению с моделями с аналогичными вычислительными затратами, такими как Gemma-2B.

? Открытый исходный код: используя только общедоступные наборы данных и код с открытым исходным кодом, JetMoE-8B способствует сотрудничеству и доступности для сообщества ИИ.

Варианты использования:

Улучшение поддержки клиентов: JetMoE-8B может использоваться в чат-ботах для предоставления эффективных и точных ответов на запросы клиентов, что повышает удовлетворенность пользователей и снижает нагрузку на команды поддержки.

Помощь в исследованиях: учебные заведения могут использовать JetMoE-8B для задач обработки естественного языка, способствуя развитию таких областей, как лингвистика, психология и социальные науки.

Создание персонализированного контента: создатели контента могут использовать JetMoE-8B для создания индивидуальных статей, описаний продуктов или маркетинговых материалов, оптимизируя показатели вовлеченности и конверсии.

Заключение:

JetMoE-8B представляет собой прорыв в разработке ИИ, предлагая непревзойденную производительность за небольшую часть стоимости традиционных моделей. Будь то для академических исследований, коммерческих приложений или общественного воздействия, JetMoE-8B позволяет пользователям использовать возможности самых современных языковых моделей, не тратя при этом огромные средства. Оцените эффективность и результативность JetMoE-8B уже сегодня и присоединяйтесь к передовым достижениям в инновациях в области ИИ.

More information on JetMoE-8B

JetMoE-8B Альтернативи

Больше Альтернативи-

XVERSE-MoE-A36B: Многоязычная большая языковая модель, разработанная XVERSE Technology Inc.

-

-

Yuan2.0-M32 — это языковая модель, основанная на архитектуре "смесь экспертов" (MoE) с 32 экспертами, из которых активны 2.

-

OpenBMB: создание центра крупномасштабных предварительно обученных языковых моделей и инструментов для ускорения обучения, настройки и вывода крупных моделей с более чем 10 миллиардами параметров. Присоединяйтесь к нашему сообществу с открытым исходным кодом и сделайте большие модели доступными для всех.

-

Gemma 3 270M: Компактный, сверхэффективный ИИ для специализированных задач. Легко настраивается для точного выполнения команд и экономичного локального развертывания.