What is LMQL?

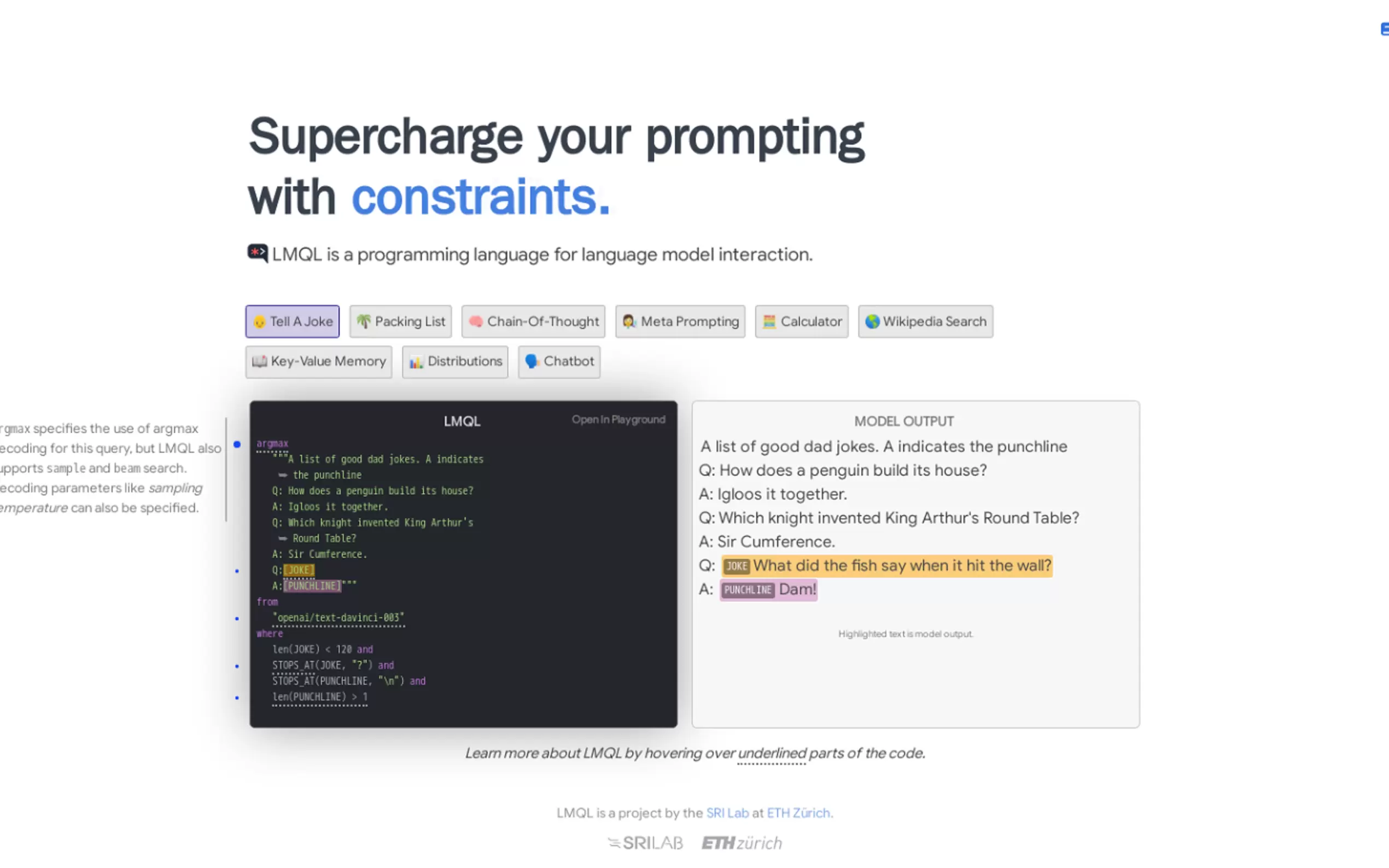

LMQL es un lenguaje de consulta diseñado especialmente para modelos de lenguaje a gran escala (LLM), que combina indicaciones en lenguaje natural con la expresividad de Python. Ofrece características como restricciones, depuración, recuperación y flujo de control para facilitar la interacción con los LLM.

Características principales:

Restricciones: especifica condiciones para que la salida generada cumpla con criterios específicos.

Depuración: analiza y comprende cómo el LLM genera la salida, lo que ayuda a afinar y detectar errores.

Recuperación: accede a indicaciones predefinidas para tareas comunes, lo que proporciona un punto de partida conveniente.

Flujo de control: utiliza instrucciones de flujo de control de Python para tener más control sobre el proceso de generación.

Generación y validación automática de tokens: genera los tokens necesarios automáticamente y valida la secuencia producida en función de las restricciones proporcionadas.

Compatibilidad con código Python arbitrario: incluye indicaciones dinámicas y procesamiento de texto mediante código Python.

More information on LMQL

Top 5 Countries

Traffic Sources

LMQL Alternativas

Más Alternativas-

LM Studio es una aplicación de escritorio fácil de usar para experimentar con Modelos de Lenguaje Grandes (LLMs) locales y de código abierto. La aplicación de escritorio multiplataforma LM Studio permite descargar y ejecutar cualquier modelo compatible con ggml de Hugging Face, y proporciona una interfaz de usuario (UI) sencilla pero potente para la configuración e inferencia de modelos. La aplicación aprovecha tu GPU cuando es posible.

-

-

-

-