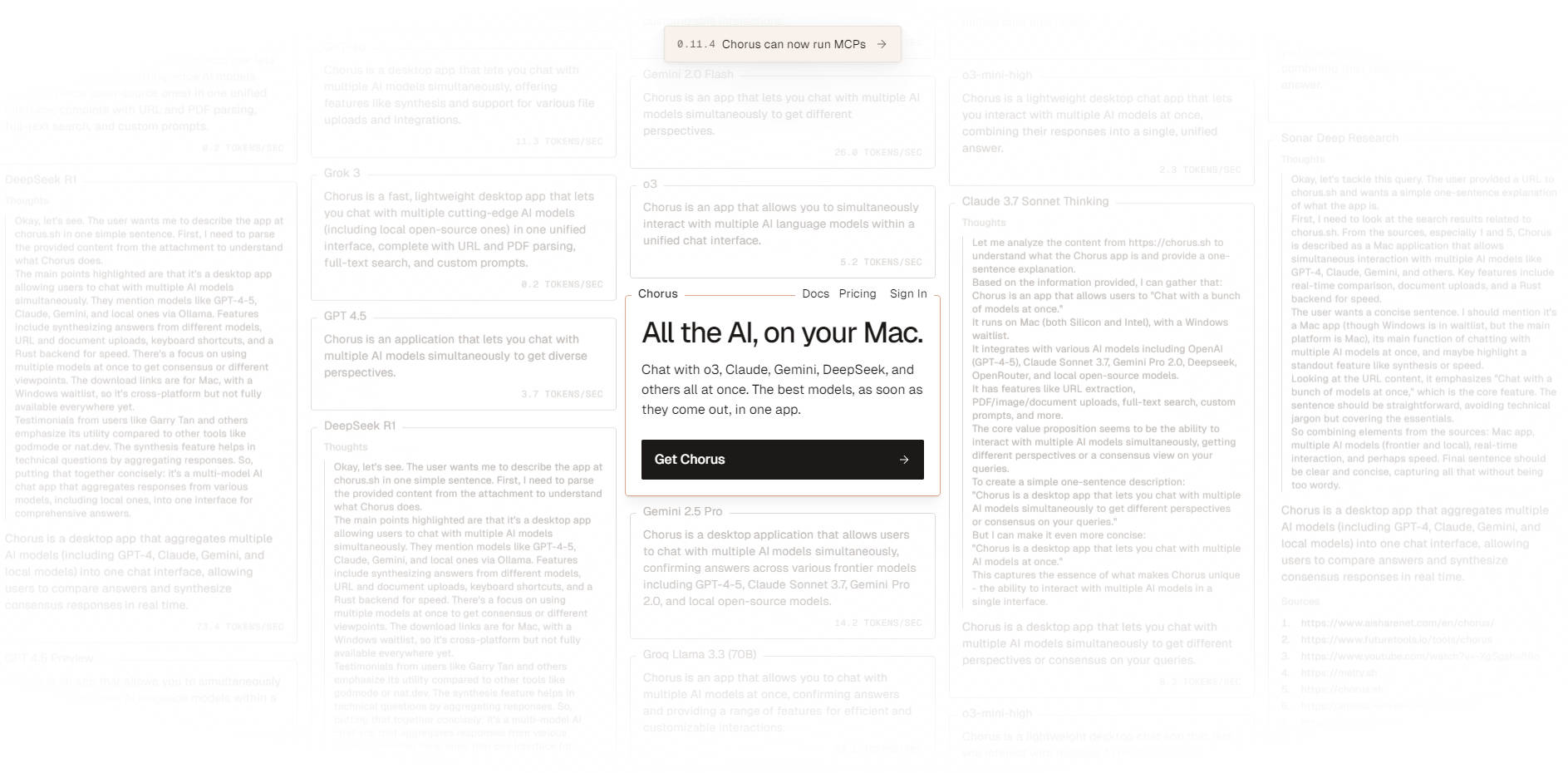

What is Chorus ?

Chorusは、AIワークフロー全体を一元化し、その効率と質を飛躍的に向上させるために設計された、Macネイティブの決定版アプリケーションです。ChatGPT、Claudeといった多様なプラットフォームや専門ツールを頻繁に切り替える手間を解消し、最新のAIモデルすべてに、単一の高性能環境から即座に統合的にアクセスできるようにします。プロフェッショナル、研究者、開発者は、包括的なコンテキスト管理、高度なツール統合、そして複数のAIの視点を同時に活用するという独自の機能を通じて、分析を加速し、出力品質を確かなものにすることができます。

主な機能

Chorusは、AIとのインタラクションにおいて、効率性、深いコンテキスト理解、そして多機能性を求めるパワーユーザーのために設計されています。

🤖 複数のAIモデルによる同時応答

Claude Opus、GPT 4.1、Gemini 2.5 Proなどの複数のAIモデルを選択し、あなたのプロンプトに同時に応答させることができます。この機能は、即座の比較分析に不可欠であり、多様なインサイトを収集し、矛盾点やハルシネーションを瞬時に発見し、順次テストを行うことなく、生成される出力に対する信頼性を高めることを可能にします。

🧠 詳細なプロジェクトコンテキストと記憶機能

Projectsを活用することで、複雑なワークフローを整理できます。PDF、画像、リンクなどを含む永続的なコンテキストフィールドを定義でき、それはそのプロジェクト内のすべてのチャットに自動的に追加されます。さらに、Project Memoryを有効にすると、進行中の会話から重要な情報が自動的に抽出・共有され、その後のすべてのチャットが常に最新の共有知識ベースを維持するようになります。

🖥️ Vision Modeを備えたアンビエントチャット

設定可能なアンビエントチャットショートカット(デフォルト: Option + Space)を使用すれば、あらゆるアプリケーション内からAIに即座にアクセスできます。この中断の少ない機能により、他のアプリでの作業を続けながら、素早く回答を得ることが可能です。有効にすると、Vision Modeは現在の画面のスクリーンショットをすべてのメッセージに含めることができ、ウィンドウを切り替えることなく、正確でコンテキストを考慮したアシスタンスを提供します。

🛠️ 広範なツールと添付ファイルの統合

AIに、Web search、Terminal commands、Image Generation(OpenAIのgpt-image-1モデル経由)、GitHub managementといった統合ツールへのアクセスを付与できます。PDF、画像、テキスト文書などのファイルをドラッグ&ドロップするか、リンクを貼り付けることで、シームレスに添付ファイルを追加することも可能です。Chorusは自動的にその内容を読み込み、AIの応答に反映させます。

🌐 ローカルモデルおよびカスタムモデルのサポート

標準的なクラウドAPIの枠を超え、OllamaやLMStudioを介して実行されるローカルモデルをChorusのインターフェースに直接統合できます。上級ユーザーや企業のニーズに対応するため、ChorusはローカルまたはリモートのMCP (Multi-Cloud Platform)サーバーを介したカスタムツールをサポートしており、これによりカスタマイズされたワークフローの自動化とセキュリティを実現します。

ユースケース

Chorusは、様々な複雑なプロフェッショナルなシナリオにおいて、生産性を最大限に高めます。

綿密な調査と比較分析: 複雑な研究論文(PDF)をプロジェクトにドロップし、コンテキストを「批判的分析」と定義します。強力なモデル(Claude Opusなど)に深い洞察を、軽量なモデル(Gemini 2.5 Flashなど)に素早い要約を同時に問いかけます。並列で表示される応答と永続的なコンテキストにより、手動での相互参照にかかる時間を大幅に節約できます。

コンテキストを意識したソフトウェア開発: 「開発」プロジェクトを開始し、主要なアーキテクチャ図をアップロードし、スタック(例:「Tauri 2.0とTypescriptのフロントエンド、Elixir Phoenix API」)を詳述するコンテキストを設定します。AIは、統合されたTerminalおよびGitHubツールを使用して、コードの問題を診断し、リポジトリを管理し、永続的なプロジェクトの記憶とコンテキストに基づいて関連するコードスニペットを生成できます。

スムーズで中断のないワークフロー: スプレッドシートで財務報告書を確認中に、Ambient ChatとVision Modeを使用して、画面に表示されている特定のデータセットについてAIに高レベルな質問を投げかけます。AIは視覚的なコンテキストを受け取り、情報に基づいた回答を即座に提供するため、レポートから離れることなく作業に集中し続けることができます。

Chorusの独自の利点

Chorusは、現代のAI利用における主要な課題を解決するためにゼロから構築されており、明確な機能的利点を提供します。

Macネイティブのパフォーマンス: 専用のネイティブアプリケーションとして、ChorusはmacOSの機能とシームレスに統合された、非常に応答性が高く流動的なユーザーエクスペリエンスを提供し、Webベースのインターフェースと比較して優れたパフォーマンスと安定性を実現します。

即座の比較分析: Chorusは、順次テストを不要にするために独自に設計されています。複数のモデルから同時に応答を受け取ることで、最も信頼性の高い回答を特定し、異なるAIアーキテクチャ間で事実を確認するための、即座かつ信頼性の高いメカニズムが得られます。

分離されたコンテキスト管理(Threads): 複雑で多層的な会話中に、明確さを維持します。Threadsを活用して、分離されたコンテキスト内で正確な追加質問をしたり、特定のモデル応答を洗練させたりすることで、これらの調整がメインチャットのコンテキストを汚染せず、会話の流れが正確に保たれるようにします。

比類なきモデルの多様性: 6つの異なるプロバイダーから17のモデルにネイティブでアクセスし、OllamaとLMStudioを介してローカルモデルを統合し、OpenRouterを通じてさらに数百ものモデルに接続できます。これらすべてが単一のインターフェースから管理可能です。

結論

Chorusは、分断されたAIの世界を、Mac上で単一かつ統合された強力なワークフロー環境へと変革します。高度なコンテキスト管理、深いツールアクセス、そして複数モデルの同時クエリによる効率性を統合することにより、現代のLLMの可能性を最大限に引き出そうとするプロフェッショナルにとって、不可欠な生産性レイヤーとなるでしょう。