What is Pruna AI?

Pruna AI는 머신러닝 모델을 더 작고, 빠르고, 비용 효율적으로 만들도록 설계된 AI 최적화 엔진입니다. 광범위한 재설계 없이도 가지치기(pruning) 및 양자화와 같은 고급 압축 기술을 사용합니다. Pruna는 ML 파이프라인에 원활하게 통합되며 다양한 하드웨어를 지원하고 개인 사용자와 팀을 위한 무료 및 엔터프라이즈 솔루션을 제공합니다.

주요 기능

자동 모델 최적화? : Pruna는 모델을 자동으로 분석하고 가지치기, 양자화, 컴파일과 같은 가장 효과적인 최적화 방법을 적용하여 프로세스를 간소화하고 귀중한 시간을 절약합니다.

유연하고 범용적인 호환성? : Pruna는 모든 ML 파이프라인에 원활하게 통합되고 모든 주요 압축 방법을 지원하므로 선호하는 프레임워크나 하드웨어에 관계없이 기존 워크플로에 쉽게 통합할 수 있습니다.

하드웨어 독립성? : Pruna의 다양성은 하드웨어 호환성으로 확장되어 클라우드 서버에서 에지 디바이스에 이르기까지 다양한 플랫폼에서 안정적인 성능을 보장합니다.

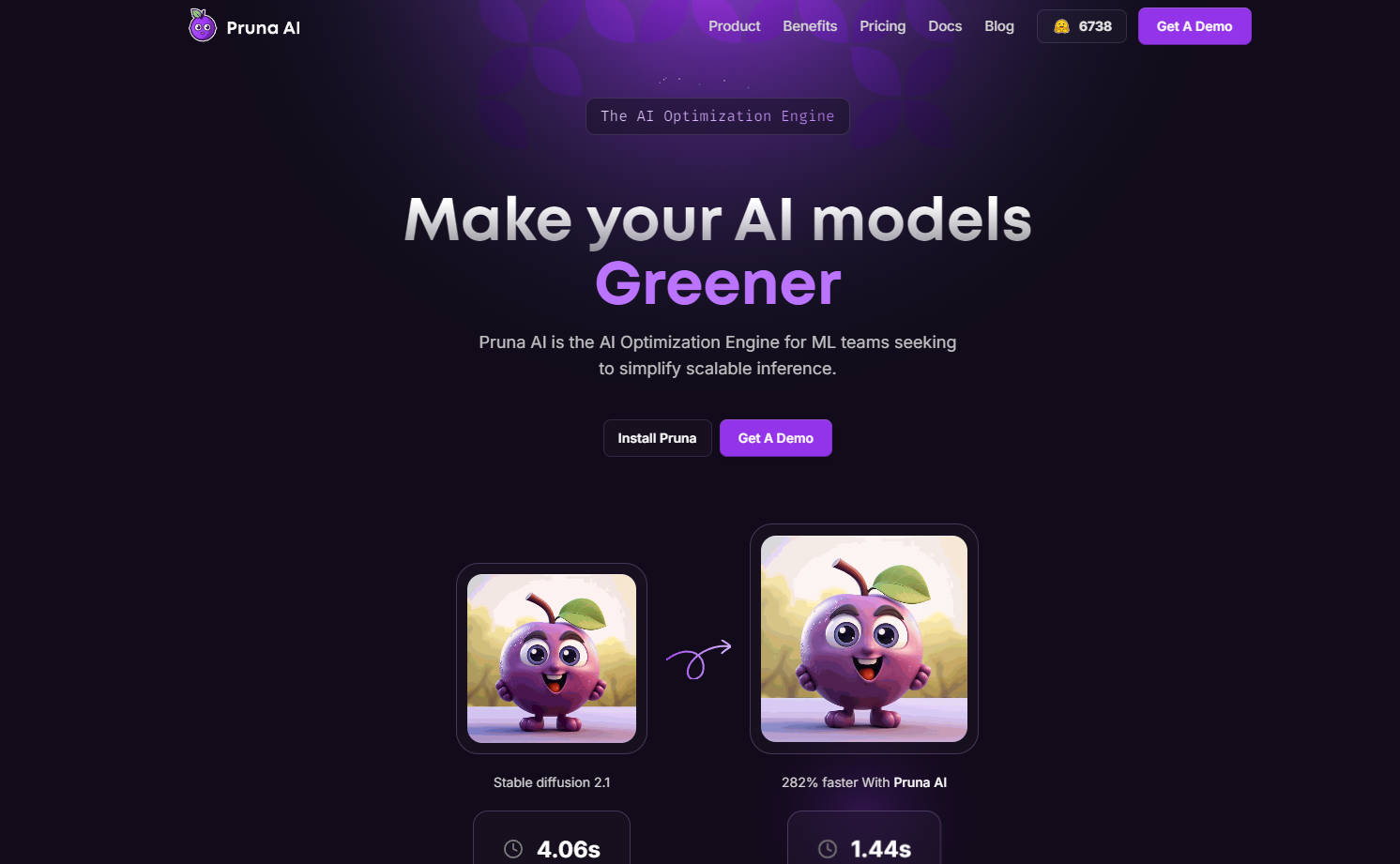

성능 획기적 향상? : Pruna는 추론 속도와 모델 크기를 크게 개선하여 모델을 더 효율적이고 비용 효과적으로 배포할 수 있도록 지원합니다.

비용 및 탄소 배출량 감소? : 모델 효율을 최적화함으로써 Pruna는 컴퓨팅 오버헤드를 줄여 클라우드 컴퓨팅 비용을 절감하고 환경적 영향을 줄입니다.

활용 사례

자원 제약이 있는 디바이스에 대규모 언어 모델(LLM) 배포: Pruna는 LLM을 압축하여 성능 저하 없이 디바이스에서 효율적으로 실행할 수 있도록 합니다.

실시간 애플리케이션에서 컴퓨터 비전 모델의 추론 속도 가속화: Pruna는 더 빠른 처리를 위해 모델을 최적화하여 더 빠른 객체 감지 또는 이미지 분류를 가능하게 합니다.

이미지 생성을 위한 Stable Diffusion 모델 실행의 클라우드 컴퓨팅 비용 절감: Pruna는 모델을 압축하여 필요한 컴퓨팅 리소스를 최소화하고 비용을 절감합니다.

결론

Pruna AI는 효율성을 위해 최적화하여 AI 모델의 잠재력을 최대한 발휘할 수 있도록 지원합니다. 사용자 친화적인 인터페이스, 강력한 최적화 기술 및 접근성에 대한 노력을 통해 Pruna는 비용 효율적이고 지속 가능한 방식으로 고성능 AI 모델을 배포하려는 개인과 팀에게 이상적인 솔루션입니다.

FAQ

1. Pruna는 어떻게 모델 최적화를 달성합니까?

Pruna는 가지치기, 양자화, 컴파일 및 캐싱을 포함한 최첨단 기술을 결합하여 정확성을 저해하지 않고 모델 크기를 줄이고 추론 속도를 높입니다.

2. Pruna는 어떤 유형의 모델을 지원합니까?

Pruna는 LLM, 이미지 및 비디오 생성 모델, 컴퓨터 비전 모델 및 오디오 모델을 포함한 광범위한 머신러닝 모델을 최적화하도록 설계되었습니다.

3. Pruna는 개인과 기업 모두에게 적합합니까?

네, Pruna는 무료 및 엔터프라이즈 솔루션을 제공합니다. 무료 계층은 개인 사용자와 소규모 팀에 적합하며, 엔터프라이즈 플랜은 대규모 조직을 위해 맞춤형 최적화 전략과 전용 지원을 포함한 고급 기능을 제공합니다.

More information on Pruna AI

Top 5 Countries

Traffic Sources

Pruna AI 대체품

더보기 대체품-

-

Neutrino는 GPT4의 성능과 일치하면서도 비용은 극히 저렴한 스마트 AI 라우터로, 프롬프트를 가장 적합한 모델로 동적으로 라우팅하여 속도, 비용, 정확성의 균형을 맞춥니다.

-

-

Kolosal AI는 속도, 효율성, 개인 정보 보호 및 친환경성을 최우선으로 하여 노트북, 데스크탑, 심지어 Raspberry Pi와 같은 기기에서 대규모 언어 모델(LLM)을 로컬로 실행할 수 있도록 지원하는 오픈소스 플랫폼입니다.

-

FriendliAI의 PeriFlow로 생성형 AI 프로젝트에 힘을 더하세요. 최고 속도의 LLM 서빙 엔진과 유연한 배포 옵션을 제공하며, 업계 선두주자들이 신뢰하는 제품입니다.