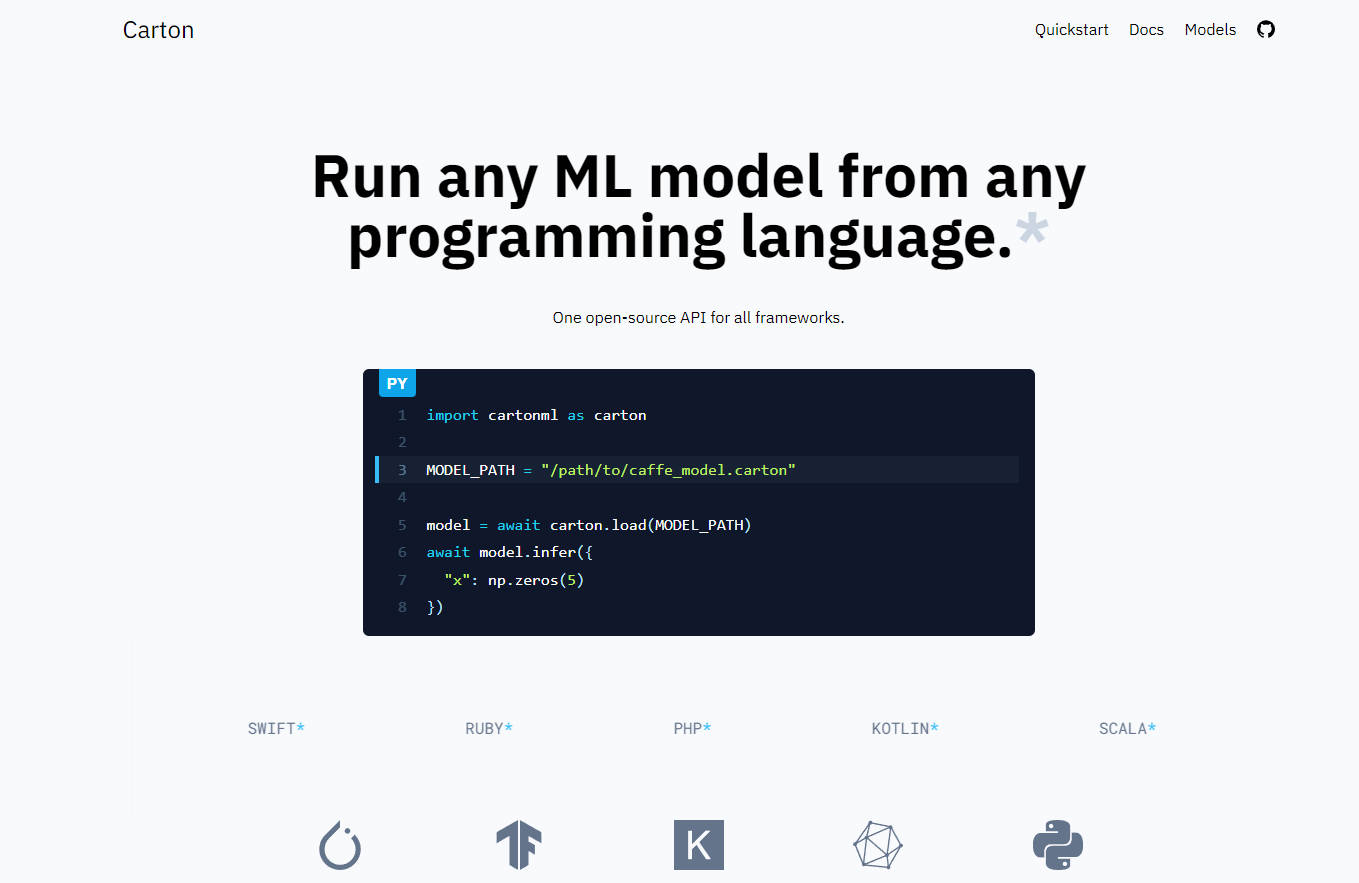

What is Carton?

Carton — это программное обеспечение, которое позволяет пользователям запускать модели машинного обучения (ML) из любого языка программирования. Оно отделяет код вывода от специальных фреймворков ML, позволяя пользователям легко оставаться в курсе передовых технологий. Carton имеет низкие накладные расходы и поддерживает различные платформы, включая x86_64 Linux и macOS, aarch64 Linux, aarch64 macOS и WebAssembly.

Ключевые особенности:

- Отделяет реализацию фреймворка ML: Carton позволяет пользователям запускать модели ML без привязки к конкретным фреймворкам, таким как Torch или TensorFlow.

- Низкие накладные расходы: предварительные тесты показывают накладные расходы менее 100 микросекунд на вызов вывода.

- Поддержка платформ: в настоящее время Carton поддерживает x86_64 Linux и macOS, aarch64 Linux, aarch64 macOS и WebAssembly.

- Упаковка без модификации: упакованный файл — это результат этапа упаковки, который содержит исходную модель и метаданные. Он не изменяет исходную модель, избегая подверженных ошибкам шагов конвертации.

- Поддержка пользовательских операций: Carton использует базовый фреймворк (например, PyTorch) для выполнения моделей, что упрощает использование пользовательских операций, таких как TensorRT, без изменений.

- Будущая поддержка ONNX: несмотря на то, что Carton упаковывает модели, а не конвертирует их, как это делает ONNX, планируется поддержка моделей ONNX в Carton для реализации интересных вариантов использования, таких как запуск моделей в браузере с помощью WASM.

Варианты использования:

1. Быстрое экспериментирование: отделяя код вывода от конкретных фреймворков и сокращая шаги преобразования, Carton позволяет быстрее экспериментировать с различными моделями ML.

2. Гибкость развертывания: благодаря поддержке различных операционных систем, включая Linux и macOS, на разных архитектурах, таких как x86_64 и aarch64, Carton обеспечивает гибкость при развертывании моделей ML в разных средах.

3. Интеграция пользовательских операций: возможность использования пользовательских операций, таких как TensorRT, упрощает для разработчиков оптимизацию рабочих процессов ML в соответствии с их конкретными требованиями.

4. ML в браузере: благодаря будущей поддержке моделей ONNX и WebAssembly Carton можно использовать для запуска моделей ML непосредственно в веб-браузерах, открывая возможности для приложений на основе браузера, требующих возможностей машинного обучения.

More information on Carton

Top 5 Countries

Traffic Sources

Carton Альтернативи

Больше Альтернативи-

ONNX Runtime: Запускайте модели машинного обучения быстрее, где угодно. Ускоряйте вывод и обучение на различных платформах. Поддержка PyTorch, TensorFlow и многих других!

-

Cortex - это совместимый с OpenAI движок ИИ, который разработчики могут использовать для создания приложений с использованием больших языковых моделей (LLM). Он поставляется с интерфейсом командной строки, вдохновленным Docker, и клиентскими библиотеками. Его можно использовать как автономный сервер или импортировать как библиотеку.

-

-

-