What is PromptShuttle?

Устали от борьбы с LLM-промптами, разбросанными по всему вашему коду? Ощущаете, что эксперименты с различными моделями и итерациями превращаются в медленный и мучительный процесс? Вы не одиноки! Управление промптами по мере роста вашего приложения может быстро превратиться в хаос, затрудняя совместную работу и делая прозрачность невозможной.

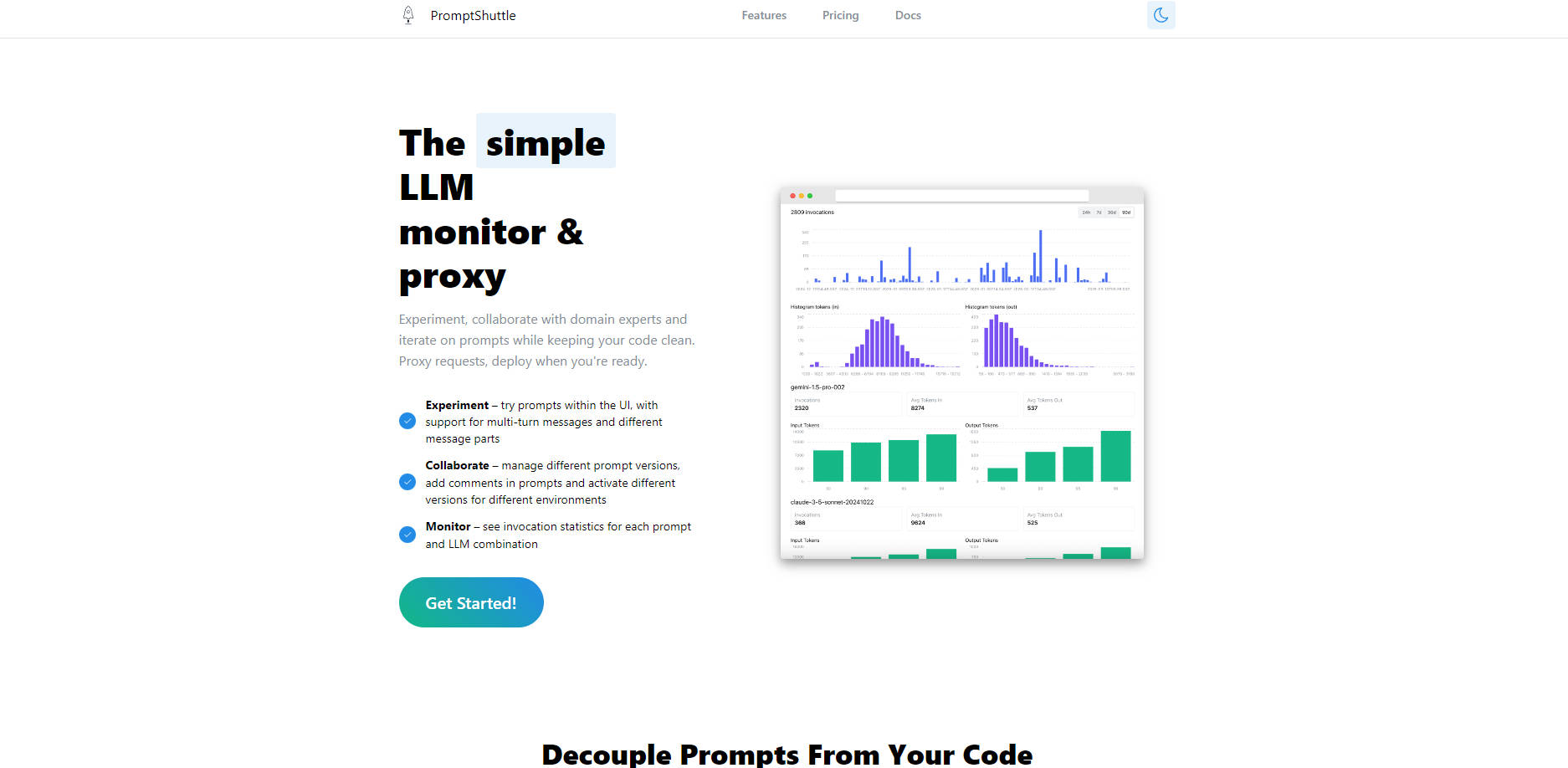

Вот где на помощь приходит PromptShuttle! Это ваш простой и мощный монитор и прокси для LLM, разработанный для полного отделения ваших промптов от кода. Это означает, что вы можете свободно экспериментировать, беспрепятственно сотрудничать со своей командой и экспертами в предметной области, а также развертывать обновления промптов, не касаясь основного кода приложения. Получите кристально ясное представление об использовании LLM и уверенно двигайтесь к созданию промптов мирового класса!

✨ Экспериментируйте без усилий: Пробуйте промпты на огромном количестве LLM – отдельно или все сразу – и мгновенно сравнивайте результаты бок о бок. Найдите идеальное сочетание модели и промпта быстрее, чем когда-либо!

🤝 Сотрудничайте как профессионал: Управляйте различными версиями промптов, добавляйте встроенные комментарии (в стиле // или /* */) для кристально ясного контекста и отслеживайте каждое изменение с помощью простого пользовательского интерфейса. Он создан для беспрепятственной совместной работы команд!

📈 Контролируйте с уверенностью: Просматривайте подробную статистику вызовов для каждой комбинации промпта и LLM в одном месте. Понимайте производительность, отслеживайте использование и принимайте решения на основе данных для оптимизации рабочих процессов LLM!

🔗 Отделите промпты от кода: Полностью перенесите логику промптов из кода приложения. Обновляйте промпты, переключайте модели или развертывайте новые версии для каждой среды, не написав и не развертывая новый код!

🚦 Упростите интеграцию LLM: Используйте PromptShuttle в качестве интеллектуального прокси! Получите доступ к десяткам моделей (таким как GPT-4o, Claude 3.7 Sonnet, Llama3, Gemini 1.5 и многим другим!) через единый унифицированный API. Получайте консолидированные журналы, централизованный биллинг и даже настраивайте автоматические резервные варианты!

✏️ Создавайте динамические шаблоны: Легко создавайте шаблоны для ваших промптов, используя [[tokens]], и заменяйте значения простым объектом JSON в ваших API-вызовах. Создавайте многократно используемые, гибкие промпты, которые адаптируются к вашим потребностям!

👻 Тестируйте без затрат: Используйте встроенный "Fake LLM" для тщательного тестирования шаблонов промптов во время разработки, не неся никаких затрат на API LLM. Быстро выполняйте итерации и экономьте деньги!

Узнайте, как PromptShuttle работает на практике:

Быстрая итерация промптов: Как разработчик, вы создаете новую функцию, которая опирается на конкретную задачу LLM. Используйте пользовательский интерфейс Experiment PromptShuttle и Fake LLM, чтобы быстро создавать и тестировать варианты вашего промпта, сравнивать результаты по различным моделям, таким как GPT-4o и Claude 3.7, и найти абсолютно лучший, прежде чем интегрировать его в свое приложение.

Совершенствование промптов командой: Ваш продукт требует нюансированных ответов, и эксперты в предметной области имеют решающее значение для формулировки промптов. Используйте функции совместной работы PromptShuttle – управление версиями и комментарии – чтобы позволить экспертам в предметной области и менеджерам по продуктам предлагать и отслеживать изменения в промптах, управляемых вне кодовой базы, гарантируя, что каждый внесет свой вклад в наилучший возможный результат.

Надежные производственные процессы: Вы развернули приложение, использующее LLM. Используйте PromptShuttle в качестве прокси для обработки всех запросов LLM. Отслеживайте статистику использования для получения информации о производительности, управляйте версиями промптов для различных сред (staging vs. production) и используйте автоматические резервные варианты для повышения надежности ваших интеграций LLM, как это делает TenderStrike для своего анализа AI!

PromptShuttle делает создание, управление и мониторинг ваших LLM-промптов простым и эффективным. Это разумный способ поддерживать чистоту вашего кода, повышать эффективность командной работы и получать важную информацию о вашей деятельности LLM.

Готовы упростить свой рабочий процесс LLM?

Зарегистрируйтесь сегодня бесплатно и получите мгновенный доступ ко всем моделям!

More information on PromptShuttle

PromptShuttle Альтернативи

Больше Альтернативи-

SysPrompt — это всеобъемлющая платформа, разработанная для упрощения управления, тестирования и оптимизации запросов для больших языковых моделей (LLM). Это коллаборативная среда, где команды могут работать вместе в режиме реального времени, отслеживать версии запросов, проводить оценки и тестировать различные модели LLM — всё в одном месте.

-

Оптимизируйте разработку промптов для LLM. PromptLayer предлагает управление, оценку и наблюдаемость на одной платформе. Создавайте ИИ лучше и быстрее.

-

PromptTools — это открытая платформа, помогающая разработчикам создавать, отслеживать и совершенствовать приложения на основе больших языковых моделей (LLM) посредством экспериментов, оценки и обратной связи.

-

-