What is Gpt-oss?

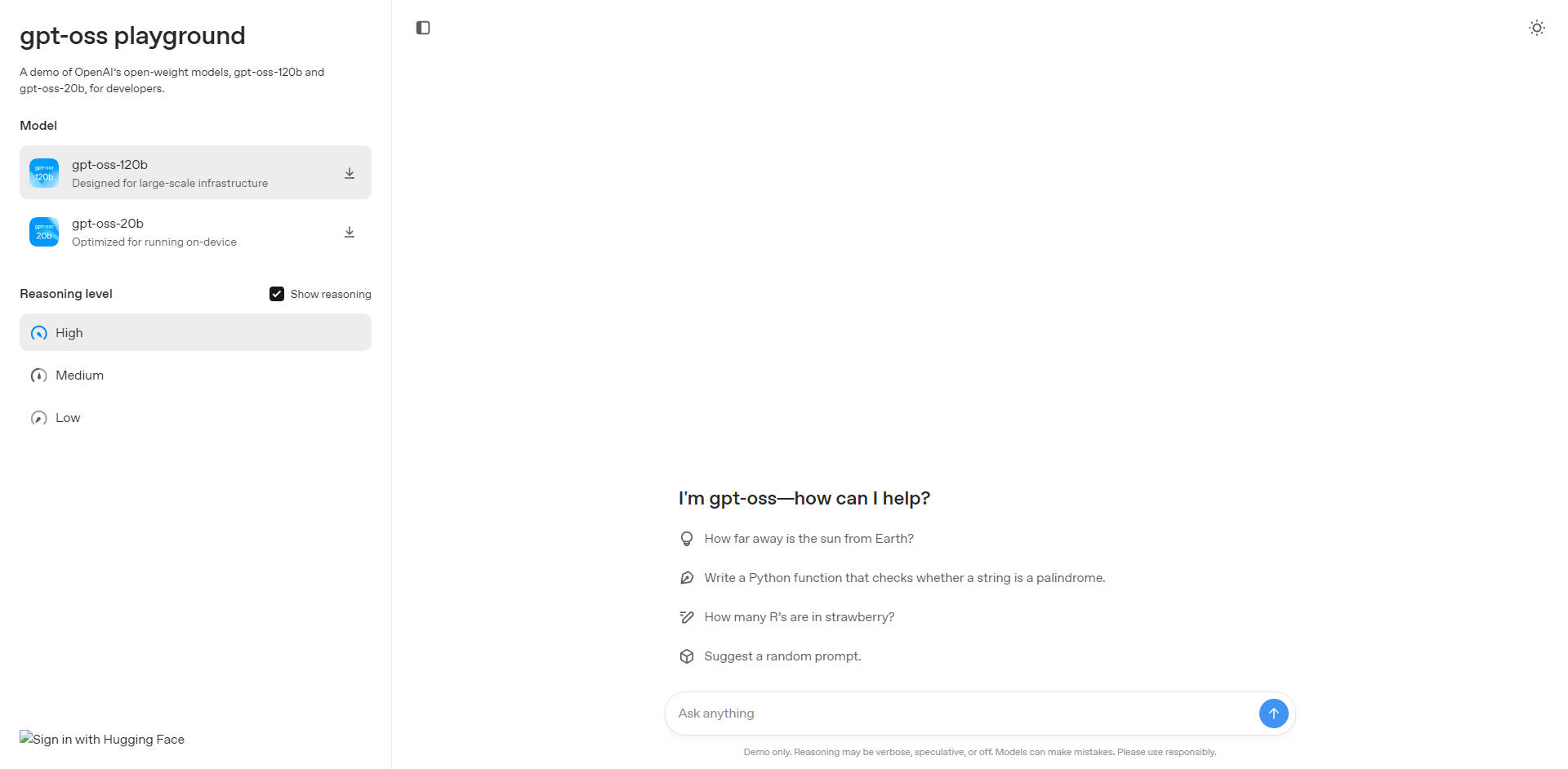

openai 推出 gpt-oss-120b 和 gpt-oss-20b,兩款功能強大且高效的開源語言模型。這些模型專為開發者、研究人員及企業量身打造,旨在解決一個關鍵挑戰:無需受限於專有 API,即可獲取尖端 AI 效能。採用靈活的 Apache 2.0 授權,現在您可以直接在自己的基礎設施上運行、客製化及微調這些模型,無論是高階伺服器還是消費級硬體皆可。

主要功能

🚀 雙模型設計,效能彈性擴展 選擇最符合您需求的模型。 gpt-oss-120b 的推理效能可媲美領先的專有模型,並能高效運行於單一 80GB GPU 上。為了最大限度地提升可用性, gpt-oss-20b 則在邊緣設備和記憶體僅需 16GB 的硬體上展現出卓越能力,非常適合本地和裝置內應用。

🤖 卓越的工具使用與推理能力 這些模型專為複雜的、基於代理(Agent-based)的工作流程而設計。它們擅長遵循指令、使用網路搜尋和執行 Python 程式碼等工具,並運用思維鏈(Chain-of-Thought, CoT)推理來解決問題。這使其成為建構能與外部系統互動以完成任務的精密 AI 代理的堅實基礎。

⚙️ MoE 優化,實現高效能 gpt-oss 模型採用「專家混合(Mixture-of-Experts, MoE)」架構,這是其與傳統密集模型的主要區別。透過針對特定任務僅啟動總參數的一小部分(120b 模型為 5.1B,20b 模型為 3.6B),它們大幅降低了運算成本和記憶體需求,從而實現了卓越的效能硬體比。

🛡️ 內建先進安全標準 安全性是本次發布的核心原則。這些模型經過廣泛的安全訓練,包括資料過濾和對齊技術,以拒絕有害請求。它們遵循與 OpenAI's 最先進專有模型相同的內部安全基準,為您的應用程式提供值得信賴的基礎。

🔧 完全開源且可客製化 憑藉 Apache 2.0 授權,您擁有創新的自由。您可以針對特定任務,使用自己的私有資料集對模型進行微調,並檢視其完整的、未經監督的思維鏈過程。這種透明度對於研究、除錯和監控模型行為具有無價的價值。

獨特優勢

gpt-oss 模型不僅僅是另一個開源發布。它們旨在提供性能、效率和透明度獨特的組合,使其脫穎而出。

效能媲美專有系統: 儘管許多開源模型在功能上有所妥協,但 gpt-oss-120b 的表現與領先的專有模型(例如 OpenAI's o4-mini)不分軒輊,甚至在某些情況下 超越 它們。在針對健康相關查詢(HealthBench)和競賽數學(AIME)的挑戰性基準測試中,gpt-oss 模型甚至優於頂級系統如 o1 和 GPT-4o。

強大效能,前所未有的高效率: 與運算成本高昂的密集模型不同,gpt-oss 利用其 MoE 架構,在可負擔的硬體上提供頂級效能。過去,大多數開發者無法想像在單一 GPU 上運行 1200 億參數級別的模型,或是在筆記型電腦上運行 200 億參數的模型,如今已成為可能。

唯一具備非監督式思維鏈(CoT)的 OpenAI 模型: 儘管我們的 API 模型擁有對齊的推理能力,但 gpt-oss 模型特意以非監督式思維鏈(CoT)的形式發布。這種獨特的方法提供了模型推理過程的未經篩選視圖,為專注於安全性、對齊和可解釋性的研究人員和開發者提供了必不可少的工具。

源自尖端訓練的卓越血統: 這些模型直接受益於用於創建 OpenAI's 最強大專有推理模型的相同先進後訓練和強化學習技術。您將在一個完全開放且可適應的套件中,獲得世界級訓練方法的優勢。

總結:

gpt-oss-120b 和 gpt-oss-20b 模型代表著在普及強大 AI 存取方面邁出了重要一步。它們彌合了開源的靈活性與尖端專有系統的原始能力之間的鴻溝。無論您是使用筆記型電腦進行原型開發的獨立開發者、探索 AI 安全邊界的研究人員,還是部署內部解決方案的企業,這些模型都能提供您所需的力量、效率和控制,以建構下一代 AI 應用程式。

立即探索 gpt-oss 如何加速您的工作!

常見問題

1. gpt-oss-120b 和 gpt-oss-20b 模型之間的主要區別是什麼? 主要區別在於效能與硬體要求之間的權衡。 gpt-oss-120b 是更強大的模型,專為實現最高推理和任務完成能力而設計,並已優化可在單一 80GB GPU 上運行。而 gpt-oss-20b 則專為實現最高效率和可用性而設計,能在記憶體僅需 16GB 的消費級硬體上提供強大效能,使其非常適合裝置內或邊緣運算情境。

2. 這些開源模型與使用 OpenAI's APIs 相比如何? gpt-oss 模型是理想選擇,當您需要完全控制、高度客製化,或為了資料安全需要在本地或私有環境中運行模型時。您可以對其進行廣泛的微調並檢查其內部運作方式。而如果您需要完全託管的服務、多模態能力(例如視覺)、內建工具整合以及無需管理基礎設施的無縫平台更新,我們的 API 模型仍是最佳選擇。

3. 「非監督式思維鏈(CoT)」對開發者而言意味著什麼? 這表示您可以在模型產生最終答案之前,存取其原始的、一步一步的「思考」過程。這對於除錯、理解模型行為和進行安全性研究極具價值。然而,由於它未經篩選,此思維鏈不應展示給最終使用者,因為它可能包含不準確的內容或不符合最終輸出安全標準的資訊。