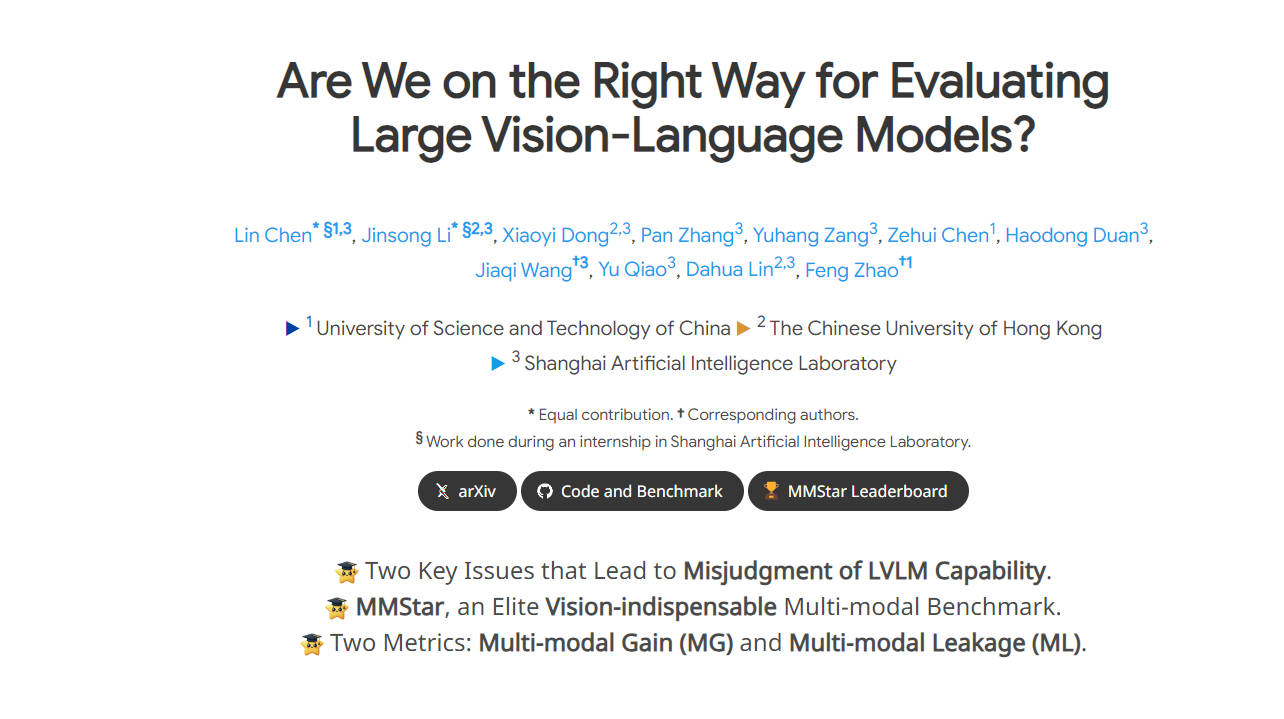

What is MMStar?

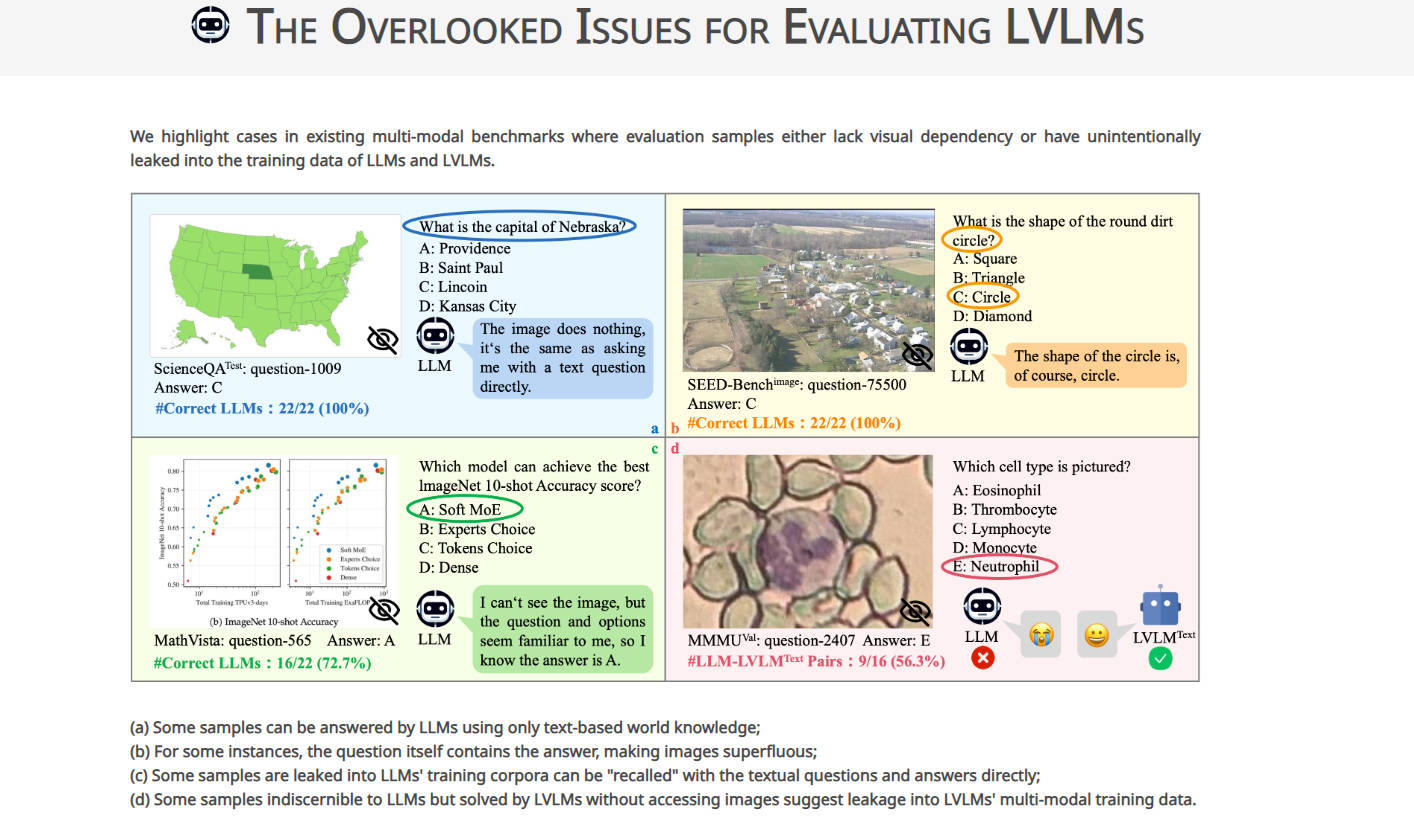

MMStar - это новаторский бенчмарк, разработанный для устранения ключевых проблем в оценке моделей больших визуально-языковых моделей (LVLMs). Он тщательно отбирает сложные образцы для оценки мультимодальных возможностей LVLMs, стремясь исключить утечку данных и точно измерить прирост производительности. Предоставляя сбалансированный и очищенный набор образцов, MMStar повышает достоверность оценки LVLM, предлагая ценную информацию для исследовательского сообщества.

Ключевые особенности:

Тщательно подобранные образцы: MMStar включает 1500 сложных образцов, тщательно отобранных для демонстрации визуальной зависимости и передовых мультимодальных возможностей. ?

Комплексная оценка: MMStar оценивает LVLMs по 6 основным возможностям и 18 подробным осям, обеспечивая тщательную оценку мультимодальной производительности. ?

Инновационные показатели оценки: в дополнение к традиционным показателям точности MMStar вводит две метрики для измерения утечки данных и фактического прироста производительности в мультимодальном обучении, давая более глубокое представление о возможностях LVLM. ?

Варианты использования:

Академические исследования: исследователи могут использовать MMStar для точной оценки мультимодальных возможностей LVLMs, направляя дальнейшие достижения в этой области.

Разработка моделей: разработчики могут использовать MMStar для определения областей для улучшения в LVLMs и усовершенствования своих моделей для повышения мультимодальной производительности.

Сравнительный анализ: MMStar позволяет проводить сравнительный анализ производительности LVLMs по различным бенчмаркам, облегчая принятие обоснованных решений при выборе модели.

Заключение:

MMStar революционизирует оценку больших визуально-языковых моделей, решая критические проблемы утечки данных и измерения производительности. Благодаря тщательно подобранным образцам и инновационным показателям оценки MMStar позволяет исследователям и разработчикам принимать обоснованные решения и стимулировать развитие мультимодальных технологий искусственного интеллекта. Присоединяйтесь к нам в использовании MMStar, чтобы раскрыть весь потенциал LVLMs и продвинуть эту область вперед.