What is MMStar?

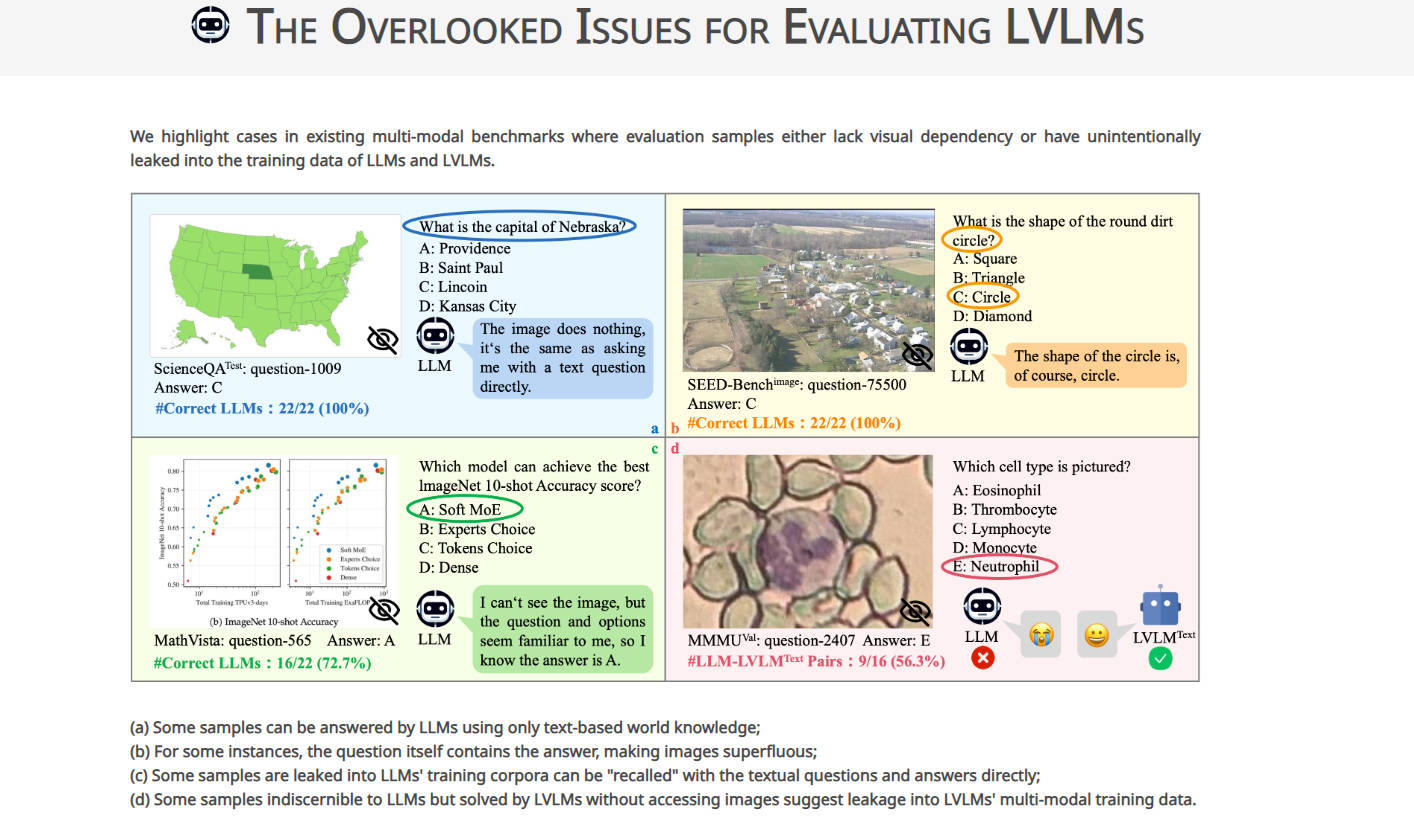

MMStar 是一個突破性的基準,旨在解決評估大型視覺語言模型 (LVLMs) 時的關鍵問題。它仔細挑選挑戰範例,以評估 LVLMs 的多模態能力,目標在消除資料外洩並精準衡量效能提升。透過提供平衡且純化的範例集,MMStar 提升了 LVLM 評估的可信度,為研究社群提供有價值的見解。

主要功能:

-

仔細挑選的範例:MMStar 包含 1,500 個挑戰範例,經過仔細挑選,以展示視覺依賴性和進階的多模態能力。?

-

全面的評估:MMStar 在 6 個核心能力和 18 個詳細軸線上評估 LVLMs,確保徹底評估多模態效能。?

-

創新的評估指標:除了傳統的精準度指標外,MMStar 還引入了兩個指標來衡量資料外洩和多模態訓練中的實際效能提升,提供對 LVLM 能力的更深入見解。?

使用案例:

-

學術研究:研究人員可以使用 MMStar 來精確評估 LVLMs 的多模態能力,引導該領域的進一步進展。

-

模型開發:開發人員可以利用 MMStar 來找出 LVLMs 中需要改進的地方,並優化其模型以增強多模態效能。

-

基準比較:MMStar 可以比較分析 LVLMs 在不同基準中的效能,協助在模型選擇中做出明智的決策。

結論:

MMStar 透過解決資料外洩和效能測量的關鍵問題,徹底革新了大型視覺語言模型的評估。透過其仔細挑選的範例和創新的評估指標,MMStar 讓研究人員和開發人員能夠做出明智的決策,並推動多模態 AI 技術的進步。加入我們,擁抱 MMStar,釋放 LVLMs 的全部潛力,並推進該領域的發展。

More information on MMStar

Launched

Pricing Model

Free

Starting Price

Global Rank

6956225

Follow

Month Visit

<5k

Tech used

Fastly,Font Awesome,Google Fonts,GitHub Pages,jQuery,Gzip,Varnish,HSTS

Top 5 Countries

67.02%

18.25%

14.74%

United States

France

Korea, Republic of

Traffic Sources

56.37%

37.37%

6.26%

Search

Direct

Referrals

Source: Similarweb (Jul 23, 2024)

Related Searches