What is Ollama Docker?

踏入 AI 开发的未来,使用 Ollama Docker,这是一个开创性的容器化环境,旨在简化您的部署并为您提供 GPU 加速功能。Ollama Docker 设计简洁易用,具有多功能的开发功能和直观的 Web UI,可提升您的工作流程,实现更快速、更高效的处理任务,并与您的项目无缝集成。

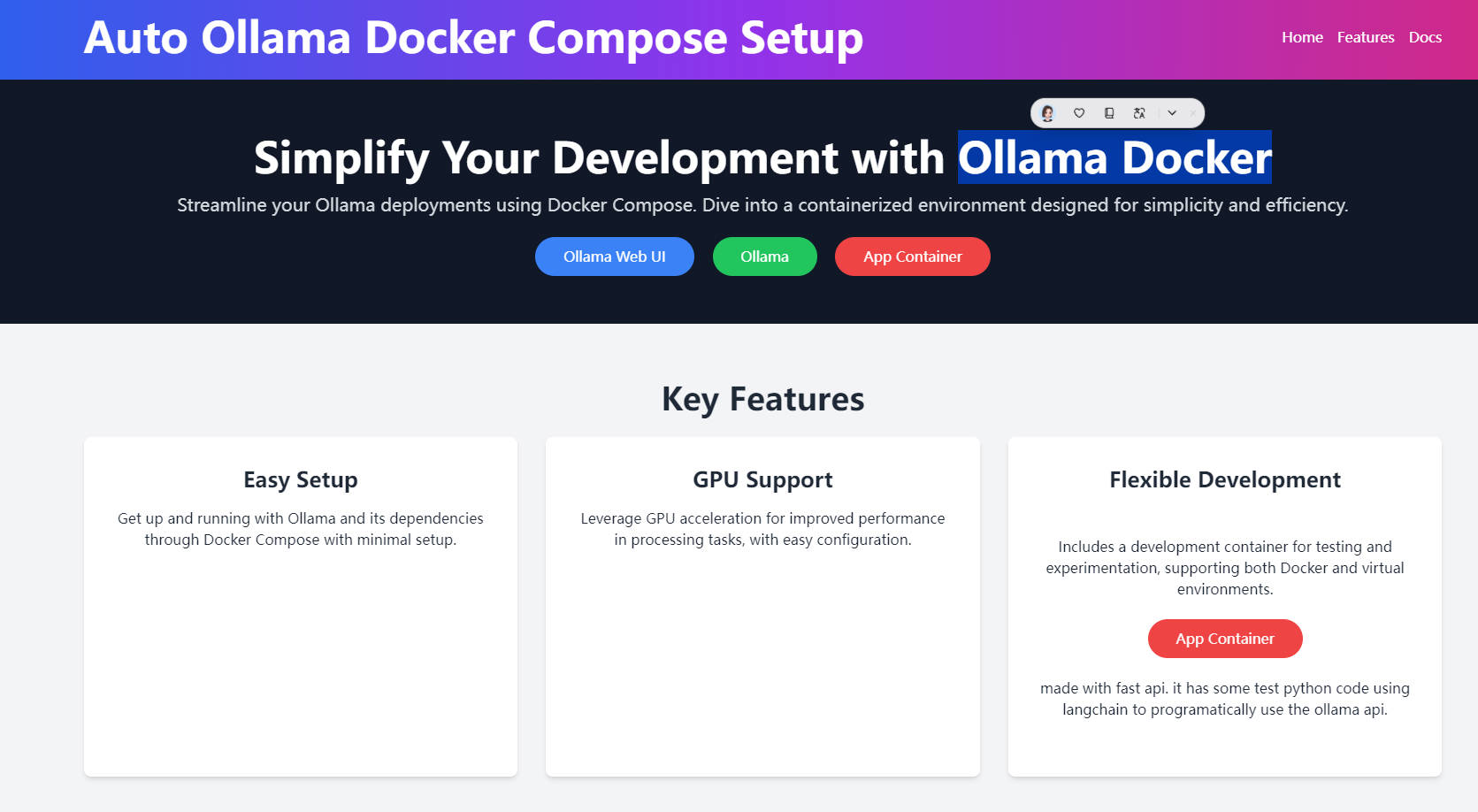

主要功能:

轻松设置:使用 Docker Compose,部署 Ollama 及其依赖项轻而易举,确保您的系统以最小的努力启动并运行。

GPU 支持:通过集成 GPU 加速,体验处理任务的增强性能,可通过 NVIDIA Container Toolkit 无缝配置。

灵活的开发:一个专门的容器支持您的开发需求,提供一个用于测试和实验的环境,无论您偏爱 Docker 还是虚拟环境。

针对 Fast API 优化的应用程序容器:此容器使用 FastAPI 构建,包含使用 Langchain 的测试 Python 代码,用于以编程方式使用 Ollama API,促进快速实验和开发。

使用案例:

快速 AI 应用程序开发:开发人员可以使用 Ollama 的预训练模型快速构建 AI 应用程序原型,从而加速开发周期。

AI 教育研究:大学可以利用 Ollama Docker 为学生提供 GPU 加速的环境,从而增强 AI 学习和研究能力。

基于云的 AI 测试:公司可以使用 Ollama Docker 在云中部署 AI 模型以进行测试和评估,而无需本地 GPU 基础设施。

结论:

Ollama Docker 是高效 AI 开发的基石,提供了一个无缝、GPU 加速且开发友好的环境。无论您是希望加速 AI 应用程序创建的开发人员,还是希望增强 AI 教学大纲的教育工作者,Ollama Docker 都是您开启新可能性的关键。立即开始探索其功能,改变您使用 AI 的方式。

常见问题解答:

问:Ollama Docker 为对 AI 感兴趣的开发人员提供了什么?

答:Ollama Docker 提供了一个可立即使用的 AI 开发环境,具有轻松设置、GPU 支持以及针对测试和实验优化的灵活开发容器,从而加速 AI 开发过程。

问:我可以将 Ollama Docker 用于教育目的吗?

答:当然可以,Ollama Docker 是教育环境的绝佳工具,它提供 GPU 加速的环境,可增强学生和教育工作者在 AI 方面的学习和研究。

问:Ollama Docker 如何支持基于云的 AI 测试?

答:使用 Ollama Docker,您可以在云中部署 AI 模型以进行测试,从而绕过对本地 GPU 基础设施的需求,使其成为希望以可扩展且资源高效的方式评估 AI 模型的公司的理想选择。